-

单目标追踪——【相关滤波】框架

参考论文链接

- Visual Object Tracking with Discriminative Filters and Siamese Networks: A Survey and Outlook

- Recent advances of single-object tracking methods: A brief survey

- 视频单目标跟踪研究进展综述

- 网盘链接(链接 提取码: yg6x)

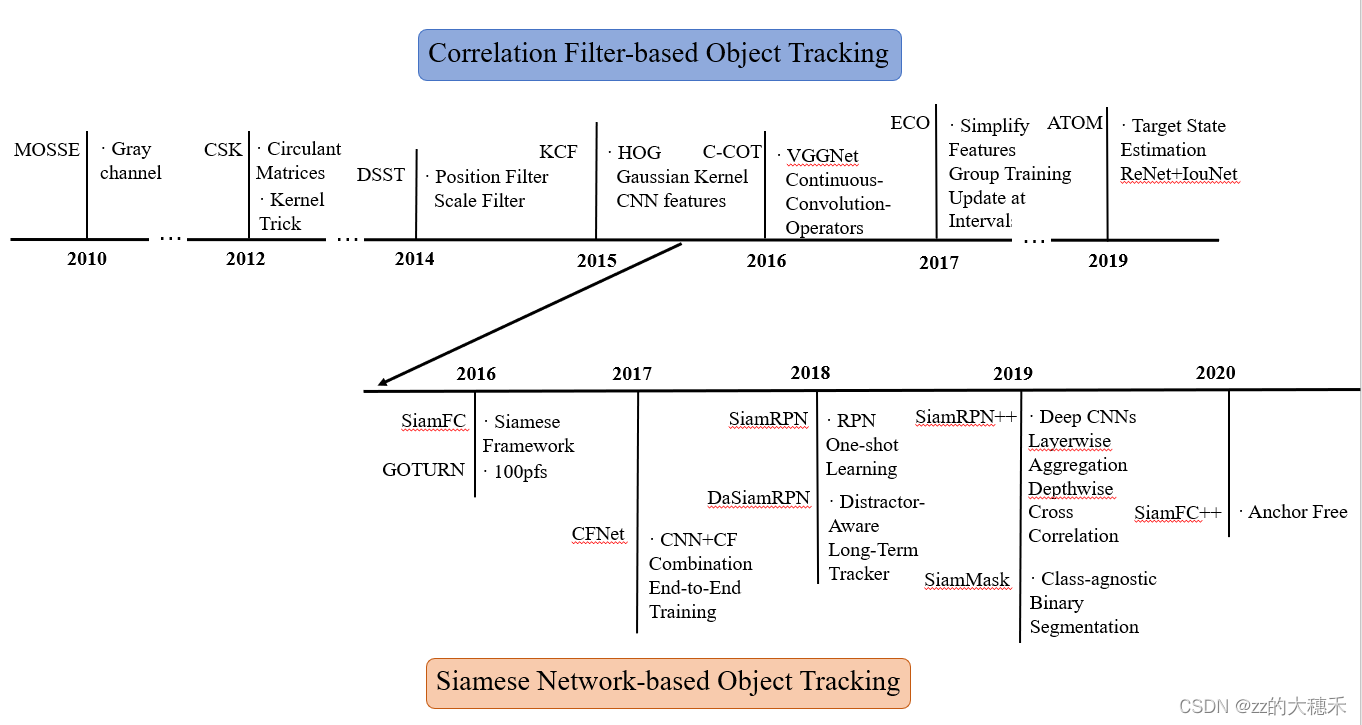

参考以上论文,我主要聚焦单目标追踪的两大框架:相关滤波(Correlation Filter)和孪生网络(Siamese Network),分析比较这两个框架下的经典论文。

首先是一个时间线发展的图:

相关滤波的跟踪框架

目标跟踪算法的输入是一段连续的视频序列,以及视频第一帧指定的跟踪目标(边界框的goundtruth (x, y, w, h) 形式给出),目标跟踪算法的输出是在后续每帧中的目标的位置以及大小,同样以边界框(x, y, w, h)的形式给出。

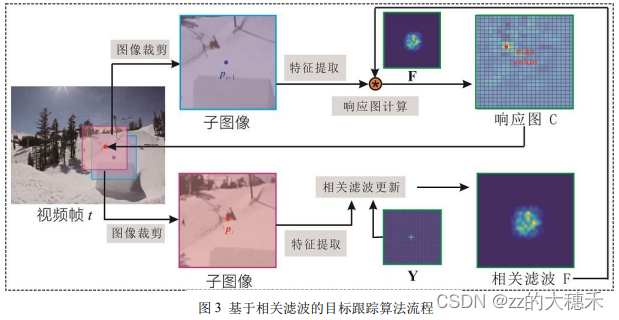

相关滤波目标跟踪算法的主要思想是,在当前帧更新相关滤波器(记作 F F F ),在下一帧利用所得的 F F F 通过循环卷积的操作实现目标中心点定位。- 获取搜索区域:由于相邻两帧目标移动范围有限,利用第 t − 1 t - 1 t−1 帧的跟踪结果 P t − 1 P_{t-1} Pt−1,通过适当扩大 P t − 1 P_{t-1} Pt−1(通常是一个预定义好的区域大小,比如320x320)得到目标的搜索区域(Search Region),并在视频第 t t t帧图像的上述搜索区域内进行目标定位搜索。

- 特征提取:在对步骤一得到的搜索区域进行特征提取,得到特征图 H H H。这里特征提取的方式有很多,目标跟踪的常用特征详见

- 目标定位:相关滤波器 F F F作用于提取的特征图,利用以下公式得到相应图 C C C。 C = H ∗ F C = H * F C=H∗F,式中 ∗ * ∗为循环卷积,计算响应图 C C C的最大值所在位置的坐标,即可得到当前帧图像上的目标中心位置,跟踪结果 P t P_{t} Pt的尺度大小可由上一帧 P t − 1 P_{t-1} Pt−1进行缩放得到(有些算法会新设计一个尺度滤波器专用于检测尺度的变化)。

- 滤波更新:利用当前跟踪结果,如图下半栏所示,以目标为中心点截取子图像,类似步骤 2 提取特征图 X X X,然后通过以下正则化公式求最优的相关过滤器 F F F E ( F ) = ∣ ∣ X ∗ F − Y ∣ ∣ 2 + ∣ ∣ F ∣ ∣ 2 E(F)=||X*F-Y||^2+||F||^2 E(F)=∣∣X∗F−Y∣∣2+∣∣F∣∣2,其中 Y Y Y是以空间点为最高值的2-D高斯分布图(相当于 Y Y Y就是要匹配的目标,我们得训练相关滤波器 F F F,看到特征图 X X X就能找到目标)

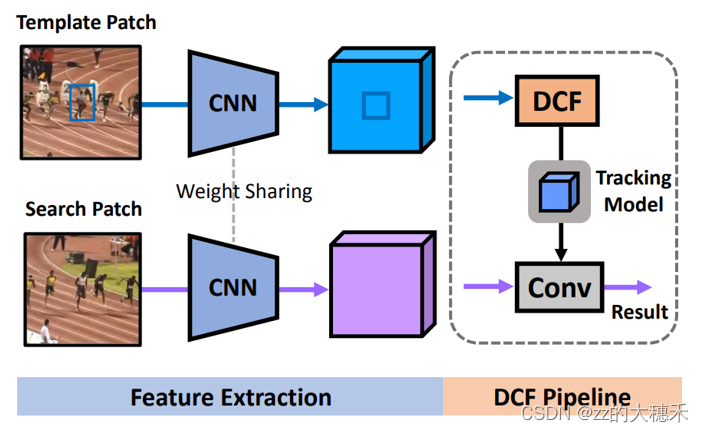

基于深度学习的相关滤波的跟踪框架

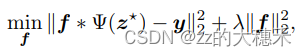

基于深度学习的DCF方法是先利用深度网络先提取图像的深度特征,再学习出一个追踪模型 f f f,去尽可能准确地生成出目标真值的分布。公式表达如下:

其中y就是template高斯型的真值标签。这是一个岭回归问题。传统的DFC方法就是利用傅里叶域求解岭回归的闭式解;基于深度学习的DCF方法利用随机梯度下降/共轭梯度方法求解,这样可以避免边界效应的问题。

下一篇开始论文阅读了,强强快给我打扣~

-

相关阅读:

1-图像读取

C认证笔记 - 计算机通识 - HTTP

【机器学习】消息传递神经网络(MPNN)在分子预测领域的医学应用

1521_AURIX TC275 FPI总线系统寄存器

C++前缀和算法的应用:石头游戏 VIII 原理源码测试用例

[附源码]java毕业设计鑫地酒店酒水库存管理系统论文

JUC高并发容器-CopyOnWriteArrayList

leetcode经典面试150题---5.多数元素

vue2【axios请求】

开发盲盒应该具有哪些特点

- 原文地址:https://blog.csdn.net/qq_42312574/article/details/125156008