-

DeepMind 的新强化学习系统是迈向通用 AI 的一步吗?

作者 | Ben Dickson

来源 | 数据实战派

这篇文章是我们对 AI 研究论文评论的一部分,这是一系列探索人工智能最新发现的文章。

对于已经精通围棋、星际争霸 2 和其他游戏的深度强化学习模型来说,人工智能系统的主要挑战之一是它们无法将其能力泛化到训练领域之外。这种限制使得将这些系统应用到现实世界中变得非常困难,在现实世界中,情况比训练 AI 模型的环境复杂得多且不可预测。

最近,DeepMind 人工智能研究实验室的科学家根据一篇新的“开放式学习”倡议的博客文章中,声称已经采取了“初步来训练一个能够在不需要人类交互数据的情况下,玩许多不同游戏的代理”。他们的新项目包括一个具有真实动态的 3D 环境和可以学习解决各种挑战的深度强化学习代理。

根据 DeepMind 的人工智能研究人员的说法,新系统是“创建更通用的代理迈出的重要一步,该代理具有在不断变化的环境中快速适应的灵活性。”

该论文的发现表明,在将强化学习应用于复杂问题方面取得了一些令人印象深刻的进步。但它们也提醒人们,当前的系统距离实现人工智能社区几十年来直梦寐以求的通用智能能力还有多远。

深度强化学习的脆弱性

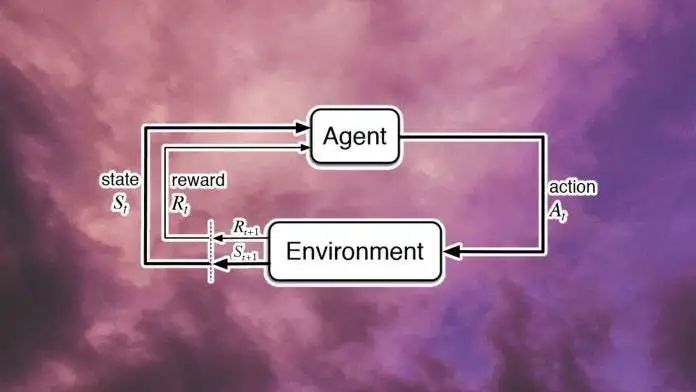

强化学习的主要优势在于可以在执行动作和获得反馈来发展行为的能力,类似于人类和动物通过与环境互动来学习的方式类似。一些科学家将强化学习描述为“首个智能计算理论”。

强化学习和深度神经网络的结合,称为深度强化学习,是包括 DeepMind 著名的 AlphaGo 和 AlphaStar 模型在内的许多强化 AI 的核心。在这两种情况下,人工智能系统都能够在各自的比赛中击败人类世界冠军。

但强化学习系统的灵活性不足也是众所周知的缺陷。例如,可以在专家级别玩星际争霸 2 的强化学习模型将无法在任何能力级别玩具有类似机制的游戏(例如,魔兽争霸 3)。即使对原始游戏稍有改动,也会大大降低 AI 模型的性能。

“这些智能体通常被限制只能玩他们接受过训练的游戏,虽然游戏的布局、初始条件、对手可能会变化,智能体必须满足的目标在训练和测试之间保持不变。偏离这一点可能会导致代理的灾难性失败,”DeepMind 的研究人员在一篇论文中写道,该论文提供了有关其开放式学习的全部细节。另一方面,人类非常擅长跨领域转移知识。

XLand 环境

DeepMind 新项目的目标是创建“一个人工智能,其行为的概括超出了它所训练的游戏集。”

为此,该团队创建了 XLand,这是一个可以生成由静态拓扑和可移动对象组成的 3D 环境的引擎。游戏引擎模拟了刚体物理学,并允许玩家以各种方式使用对象(例如,创建斜坡、块路径等)。

XLand 是一个丰富的环境,可以在其中训练代理执行几乎无限数量的任务。XLand 的主要优势之一是能够使用程序化规则自动生成大量环境和挑战来训练 AI 代理。这解决了机器学习系统的主要挑战之一,该系统通常需要大量手动策划的训练数据。

根据博客文章,研究人员“在 XLand 中创建了数十亿个任务,跨越不同的游戏、世界和玩家。”这些游戏包括非常简单的目标,例如在更复杂的设置中寻找对象,其中 AI 代理会权衡不同奖励的收益和权衡。一些游戏包括涉及多个代理的合作或竞争元素。

深度强化学习

DeepMind 使用深度强化学习和一些聪明的技巧来创建可以在 XLand 环境中茁壮成长的 AI 代理。

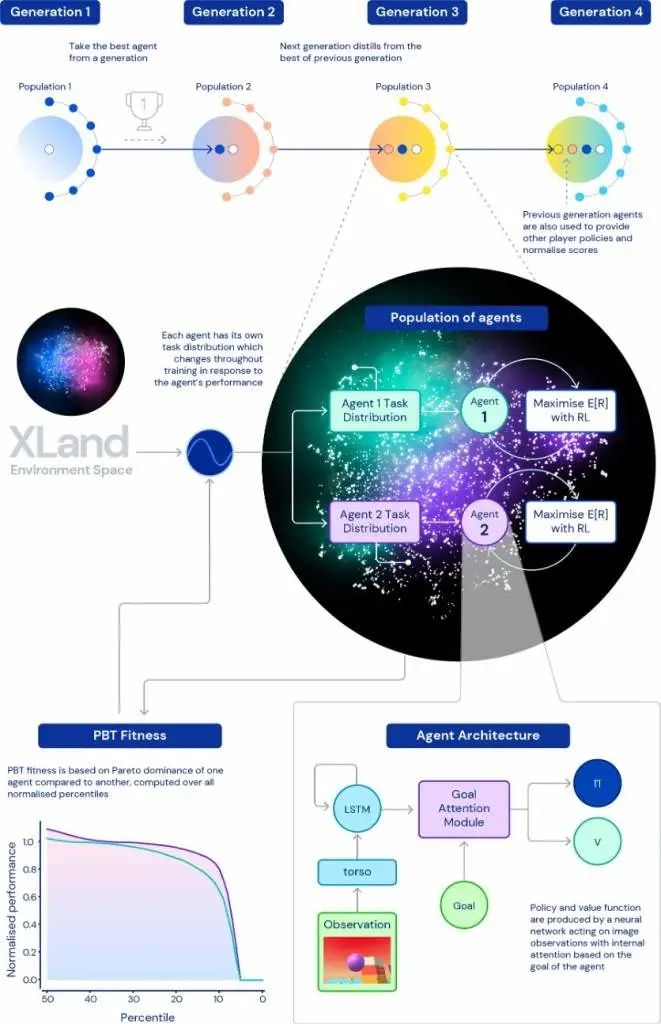

每个代理的强化学习模型接收世界的第一人称视角、代理的物理状态(例如,是否持有对象)及其当前目标。每个代理微调其策略神经网络的参数,以最大限度地提高当前任务的回报。神经网络架构包含一个注意力机制,以确保代理可以平衡完成主要目标所需的子目标的优化。

一旦代理掌握了当前的挑战,计算任务生成器就会为代理创建一个新的挑战。每个新任务都是根据代理的训练历史生成的,并有助于在各种挑战中分配代理的技能。

DeepMind 还使用其庞大的计算资源对大量代理进行并行培训,并在不同的代理之间传输学习参数,以提高强化学习系统的一般能力。

DEEPMind使用多步骤和基于人群的机制来培训许多强化学习代理

强化学习代理的性能是根据它们完成未经训练的各种任务的一般能力来评估的。一些测试任务包括众所周知的挑战,例如“夺旗”和“捉迷藏”。

根据 DeepMind 的说法,每个代理在 XLand 的 4,000 个独特世界中玩了大约 700,000 个独特的游戏,并在 340 万个独特任务中经历了 2000 亿个训练步骤(在论文中,研究人员写道,1 亿个步骤相当于大约 30 分钟的训练) .

AI 研究人员写道:“此时,我们的代理已经能够参与每一个程序生成的评估任务,除了少数甚至对人类来说都是不可能的。” “而且我们看到的结果清楚地展示了整个任务空间的一般零样本行为。”

零样本机器学习模型可以解决训练数据集中不存在的问题。在 XLand 等复杂空间中,零样本学习可能意味着代理已经获得了有关其环境的基本知识,而不是记住特定任务和环境中的图像帧序列。

当研究人员试图为新任务调整它们时,强化学习代理进一步表现出广义学习的迹象。根据他们的发现,对新任务进行 30 分钟的微调,足以在使用新方法训练的强化学习代理中产生令人印象深刻的改进。相比之下,在相同时间内从头开始训练的代理在大多数任务上的性能接近于零。

高级行为

根据 DeepMind 的说法,强化学习代理表现出“启发式行为”的出现,例如工具使用、团队合作和多步计划。如果得到证实,这可能是一个重要的里程碑。深度学习系统经常因学习统计相关性而不是因果关系而受到批评。如果神经网络能够开发出高级概念,例如使用对象来创建斜坡或导致遮挡,它可能会对机器人和自动驾驶汽车等领域产生重大影响,而这些领域目前深度学习正在苦苦挣扎。

但这些都是重要的假设,DeepMind 的研究人员对就他们的发现得出结论持谨慎态度。他们在博文中写道:“鉴于环境的性质,很难确定意图——我们看到的行为经常看起来是偶然的,但我们仍然看到它们始终如一地发生。”

但是他们相信他们的强化学习代理“了解他们身体的基本知识和时间的流逝,并且他们了解他们遇到的游戏的高级结构。”

这种基本的自学技能是人工智能社区备受追捧的另一个目标。

智力理论

DeepMind 的一些顶尖科学家最近发表了一篇论文,其中他们假设单一奖励和强化学习足以最终实现通用人工智能 (AGI)。科学家们认为,一个具有正确激励机制的智能代理可以开发各种能力,例如感知和自然语言理解。

尽管 DeepMind 的新方法仍然需要在多个工程奖励上训练强化学习代理,但这符合他们通过强化学习实现 AGI 的一般观点。

Pathmind 的首席执行官 Chris Nicholson 告诉 TechTalks:“DeepMind 在这篇论文中表明,单个 RL 代理可以开发智能以实现多个目标,而不仅仅是一个目标,” “它在完成一件事时学到的技能可以推广到其他目标。这与人类智能的应用方式非常相似。例如,我们学习抓取和操纵物体,这是实现从敲锤子到铺床的目标的基础。”

Nicholson 还认为,该论文发现的其他方面暗示了通向智能的进展。“家长们会认识到,开放式探索正是他们的孩子学会在世界中穿行的方式。他们从柜子里拿出一些东西,然后把它放回去。他们发明了自己的小目标——这对成年人来说可能毫无意义——然后他们掌握了这些目标,”他说。“DeepMind 正在以编程方式为其代理在这个世界上设定目标,而这些代理正在学习如何一一掌握它们。”

Nicholson 说,强化学习代理也显示出在他们自己的虚拟世界中开发具身智能的迹象,就像人类一样。“这又一次表明,人们学习穿越和操纵的丰富而可塑的环境有利于通用智能的出现,智能的生物学和物理类比可以指导人工智能的进一步工作,”他说。

南加州大学计算机科学副教授 Sathyanaraya Raghavachary 对 DeepMind 论文中的主张持怀疑态度,尤其是关于本体感觉、时间意识以及对目标和环境的高级理解的结论。

“即使我们人类也没有完全意识到我们的身体,更不用说那些 VR 代理了,” Raghavachary 在对 TechTalks 的评论中说,并补充说,对身体的感知需要一个集成的大脑,该大脑被共同设计以实现合适的身体意识和空间位置。“与时间的流逝一样——这也需要一个对过去有记忆的大脑,以及与过去相关的时间感。他们(论文作者)的意思可能与代理跟踪由他们的行为(例如,由于移动紫色金字塔)导致的环境中的渐进变化,底层物理模拟器将产生的状态变化有关。

Raghavachary 还指出,如果代理能够理解他们任务的高层结构,他们就不需要 2000 亿步的模拟训练来达到最佳结果。

“底层架构缺乏实现他们在结论中指出的这三件事(身体意识、时间流逝、理解高级任务结构)所需的东西,”他说。“总的来说,XLand 只是‘大同小异’。”

模拟与现实世界的差距

简而言之,这篇论文证明,如果你能够创建一个足够复杂的环境,设计正确的强化学习架构,并让你的模型获得足够的经验(并且有很多钱可以花在计算资源上),你将能够泛化到同一环境中的各种任务。这基本上就是自然进化赋予人类和动物智能的方式。

事实上,DeepMind 已经对 AlphaZero 做了类似的事情,AlphaZero 是一种强化学习模型,能够掌握多个两人回合制游戏。XLand 实验通过添加零样本学习元素将相同的概念扩展到更高的水平。

但是,虽然我认为 XLand 训练的代理的经验最终会转移到现实世界的应用中,例如机器人和自动驾驶汽车,但我认为这不会是一个突破。您仍然需要做出妥协(例如创建人为限制以降低现实世界的复杂性)或创建人为增强(例如将先验知识或额外传感器注入机器学习模型)。

DeepMind 的强化学习代理可能已经成为虚拟 XLand 的主人。但是他们的模拟世界甚至没有真实世界的一小部分复杂性。在很长一段时间内,这种差距仍将是一个挑战。

参考链接:

https://bdtechtalks.com/2021/08/02/deepmind-xland-deep-reinforcement-learning/

往

期

回

顾

资讯

资讯

资讯

资讯

分享

点收藏

点点赞

点在看

-

相关阅读:

wxFormBuilder + Python 工具开发第三章-日记本工具树节点增、改、删功能

2023-11-7 OpenAI 45 分钟发布会:演示关于 GPT Store 构建 GPT、零代码创建 AI Agent

【MyBatisⅡ】动态 SQL

ubuntu16.04安装PCL

JAVA中的进制与位运算

Centos配置samba文件共享服务器

【NLP学习记录】One-Hot编码

汽车电子——产品标准规范汇总和梳理(UDS诊断)

[Swift]单元测试

Nginx-负载均衡与动静分离

- 原文地址:https://blog.csdn.net/dQCFKyQDXYm3F8rB0/article/details/120714512