-

《机器学习by周志华》学习笔记-线性模型-02

1、对数几率回归

1.1、背景

上一节我们考虑了线性模型的回归学习,但是想要做分类任务就需要用到上文中的广义线性模型。

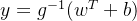

当联系函数

连续且充分光滑,考虑单调可微函数

连续且充分光滑,考虑单调可微函数 ,令:

,令:

1.2、概念

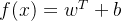

找一个单调可谓函数

,将分类任务的真实标记

,将分类任务的真实标记 与线性回归模型的预测值

与线性回归模型的预测值 联系起来,也叫做「Heaviside函数」。

联系起来,也叫做「Heaviside函数」。在二分类任务中,输出的真实标记

,而线性回归模型产生的预测值

,而线性回归模型产生的预测值 是实数值。于是我们将

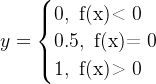

是实数值。于是我们将 转化为0、1值。最理想的情况就是「单位阶跃函数(unit-step function)」,如下所示:

转化为0、1值。最理想的情况就是「单位阶跃函数(unit-step function)」,如下所示:

若

,就判为正例;

,就判为正例;若

,就判为反例;

,就判为反例;若

,则可任意判别;

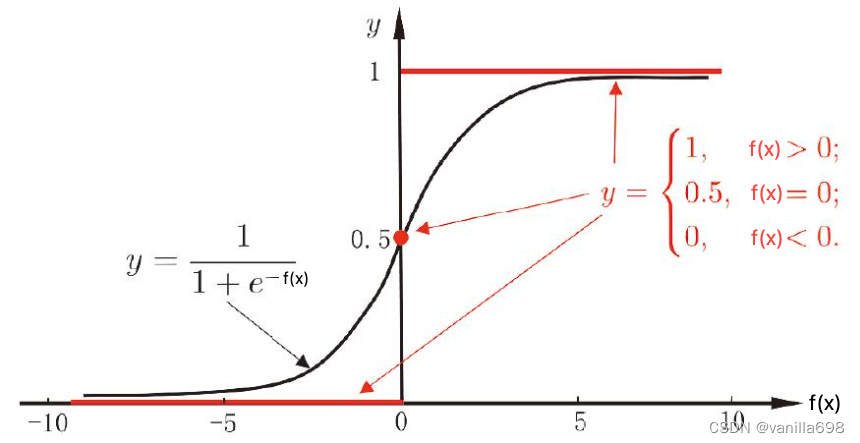

,则可任意判别;如下图所示(红色部分)

黑色部分函数,则称为「对数几率函数」,简称「对率函数」。

从上图可以看出,「单位阶跃函数(unit-step function)」(2条红线+一个点)不连续,因此不能直接用做

,我们可以在上图中,用「单位阶跃函数」的「替代函数」(对率函数)来用作

,我们可以在上图中,用「单位阶跃函数」的「替代函数」(对率函数)来用作 。并且需要该函数单调可微。可得出:

。并且需要该函数单调可微。可得出:

Sigmoid函数:

Sigmoid函数即S形函数。「对率函数」是Sigmoid函数最重要的代表。我们将会在后面「神经网络」将看到他在神经网络中的重要作用。

综上所述,「对率函数」将f(x)转化为一个接近0或1的y值。并且值得范围在f(x)=0附近变化斜率高。

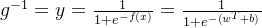

上述式子可以变化为:

将

视作样本x为正例的可能性。则

视作样本x为正例的可能性。则 视作样本x为负例的可能性。两者的比值:

视作样本x为负例的可能性。两者的比值:

称为「几率(odds)」

几率(odds):

Odds=P/(1-P)

Odds(几率)的计算公式为Odds=P/(1-P),这里的P是指某个事件发生的概率。

Odds是用来表示一个事件发生与不发生的比例,当P=0.5时,Odds=1,当P=0,则Odds趋向于无穷大,反之,当P=1,则Odds趋向于0。

对几率(odds)取对数,则得到了「对数几率(log odds)」,也叫做logit。如下表示:

上述式子,有文献译为「逻辑回归」。但中文「逻辑」与logisitic和logit的含义较大,此处作者翻译为「对数几率回归」,简称「对率回归」。

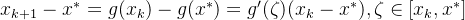

因为

中的

中的 ,故我们可以得出:

,故我们可以得出:该等式左边是:线性回归模型的预测结果

而等式右边是:该模型的真实标记

因此,我们得出的公式结果,实际上就是在用线性回归模型的预测结果,去逼近真实标记

的对数几率。所以其对应的模型称为「对数几率回归」。

的对数几率。所以其对应的模型称为「对数几率回归」。需要注意的是,它的名字中虽然有回归,但实际是却是一种分类学习方法。其优点如下:

- 他是直接对分类可能性进行建模,无需事先假设数据分布,这样就避免分布不准确所带来的问题。

- 它不仅是预测出「类别」,而是可得到近似概率预测,这对许多需利用概率辅助决策的任务很有用。

- 此外,对数函数是任意阶可导的凸函数,有很好的数学性质,现有的许多数值优化算法都可直接用于求取最优解。

1.3、求解

根据1.2的概念,本章主要求解公式中的w和b。如果我们将上述式子中的

视为「后验概率」估计

视为「后验概率」估计 ,,则上述式子可以重写为:

,,则上述式子可以重写为: -

相关阅读:

逻辑运算介绍

基于Matlab在以地球为中心的场景中模拟和跟踪航路飞机仿真(附源码)

嵌入式图像处理机器视觉库YMCV使用

茂莱光学科创板上市:拟募资4亿 范一与范浩兄弟为实控人

【总结】两个独立同分布的随机变量相加还是原来的分布吗?

全面解读 AWS Private 5G 的革新理念

翻转单词序列、按之字形顺序打印二叉树、二叉搜索树的第k个节点

NISP-SO安全运维工程师需要掌握的核心能力

将文件名称中空格以左的部分全部删除重命名

小望电商通:无代码开发,轻松实现电商平台、客服系统和用户运营的集成

- 原文地址:https://blog.csdn.net/vanilla698/article/details/137687190