-

MySQL之MHA高可用配置及故障切换实例

1、MHA概述

1.1MHA 是什么

- MHA(MasterHigh Availability)是一套优秀的MySQL高可用环境下故障切换和主从复制的软件。

- MHA 的出现就是解决MySQL 单点的问题。

- MySQL故障切换过程中,MHA能做到0-30秒内自动完成故障切换操作。

- MHA能在故障切换的过程中最大程度上保证数据的一致性,以达到真正意义上的高可用。

1.2、MHA 的组成

- MHA Node(数据节点)

MHA Node 运行在每台 MySQL 服务器上。 - MHA Manager(管理节点)

MHA Manager 可以单独部署在一台独立的机器上,管理多个 master-slave 集群;也可以部署在一台 slave 节点上。

MHA Manager 会定时探测集群中的 master 节点。当 master 出现故障时,它可以自动将最新数据的 slave 提升为新的 master, 然后将所有其他的 slave 重新指向新的 master。整个故障转移过程对应用程序完全透明。

1.3MHA 的特点

- 自动故障切换过程中,MHA试图从宕机的主服务器上保存二进制日志,最大程度的保证数据不丢失

- 使用半同步复制,可以大大降低数据丢失的风险,如果只有一个slave已经收到了最新的二进制日志,MHA可以将最新的二进制日志应用于其他所有的slave服务器上,因此可以保证所有节点的数据一致性

- 目前MHA支持一主多从架构,最少三台服务,即一主两从

2、MHA搭建准备

2.1实验思路

1.MHA架构 ①数据库安装 ②一主两从 ③MHA搭建

2.故障模拟 ①主库失效 ②备选主库成为主库 ③原故障主库恢复重新加入到MHA成为从库2.2实验准备

manager节点:192.168.190.120

master节点 :192.168.190.130

slave1节点 :192.168.190.140

slave2节点 :192.168.190.1703、MHA搭建的步骤

3.1配置主从复制

初始化环境

#在四台服务器上初始化环境 systemctl stop firewalld setenforce 0- 1

- 2

- 3

修改 Master、Slave1、Slave2 节点的主机名

//在Master上 hostnamectl set-hostname Mysql1 su //在Slave1 hostnamectl set-hostname Mysql2 su //在Slave2 hostnamectl set-hostname Mysql3 su- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

在Master、Slave1、Slave2添加域名解析

vim /etc/hosts 192.168.190.130 Mysql1 192.168.190.140 Mysql2 192.168.190.170 Mysql3- 1

- 2

- 3

- 4

在master上

在slave1上

在slave2上

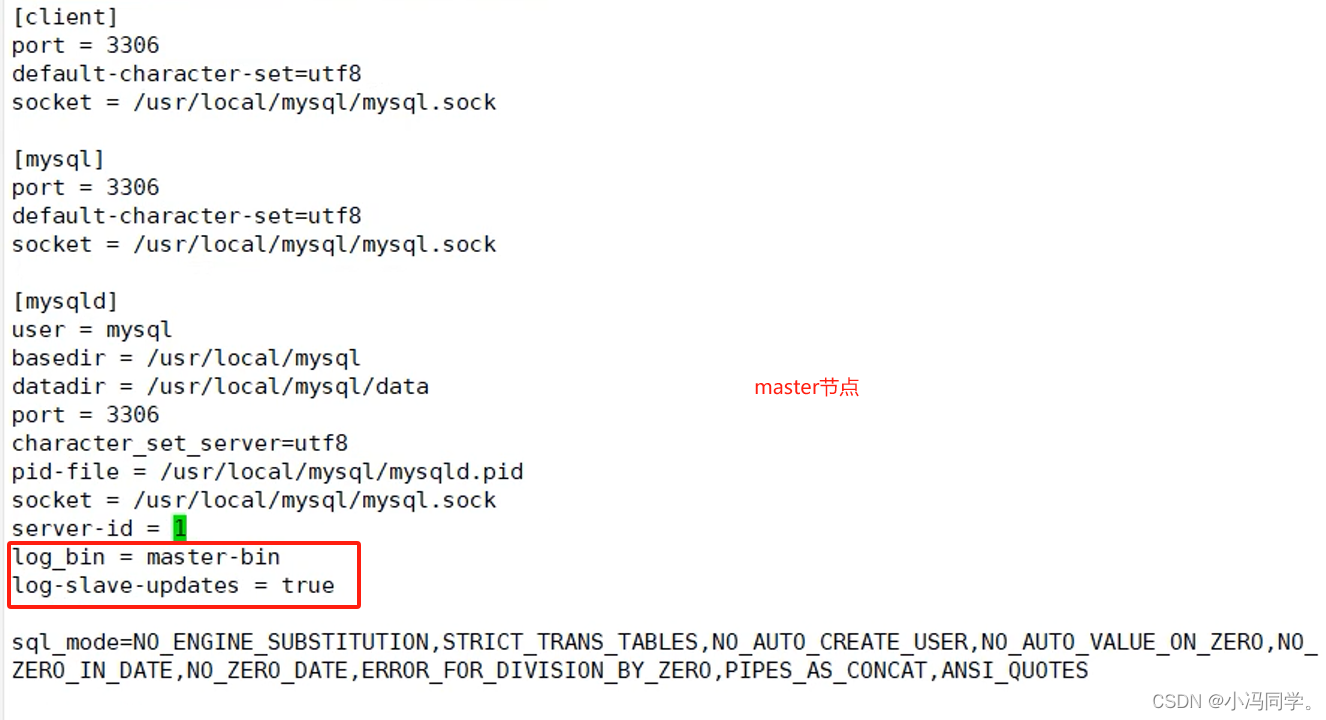

配置主从同步//修改 Master、Slave1、Slave2 节点的 Mysql主配置文件/etc/my.cnf //Master 节点// vim /etc/my.cnf [mysqld] server-id = 1 log_bin = master-bin log-slave-updates = true systemctl restart mysqld //Slave1 节点// vim /etc/my.cnf server-id = 2 //三台服务器的 server-id 不能一样 log_bin = master-bin relay-log = relay-log-bin relay-log-index = slave-relay-bin.index systemctl restart mysqld //Slave2 节点// vim /etc/my.cnf server-id = 3 log_bin = master-bin relay-log = relay-log-bin relay-log-index = slave-relay-bin.index systemctl restart mysqld- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

- 20

- 21

- 22

- 23

- 24

- 25

- 26

- 27

Master 节点

Slave1 节点

Slave2 节点

Master、Slave1、Slave2 节点上都创建两个软链接

ln -s /usr/local/mysql/bin/mysql /usr/sbin/ ln -s /usr/local/mysql/bin/mysqlbinlog /usr/sbin/ ls /usr/sbin/mysql*- 1

- 2

- 3

登录数据库主从配置授权

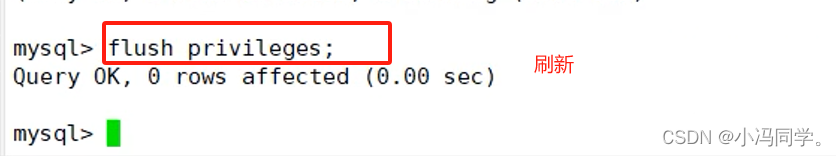

//Master、Slave1、Slave2 节点上都授权// grant replication slave on *.* to 'myslave'@'192.168.59.%' identified by '123123'; //授权主从用户 grant all privileges on *.* to 'mha'@'192.168.190.%' identified by 'manager'; grant all privileges on *.* to 'mha'@'Mysql1' identified by 'manager'; grant all privileges on *.* to 'mha'@'Mysql2' identified by 'manager'; grant all privileges on *.* to 'mha'@'Mysql3' identified by 'manager'; //刷新库 flush privileges;- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

在master节点上

在slave1节点上

在slave2节点上

Master 节点查看二进制文件和同步点 、在 Slave1、Slave2 节点执行同步操作

//在master上// show master status; //在slave1、slave2节点执行同步操作// change master to master_host='192.168.59.118',master_user='myslave',master_password='123123',master_log_file='master-bin.000002',master_log_pos=1745; start slave; show slave status\G;- 1

- 2

- 3

- 4

- 5

- 6

- 7

在master上

在slave1上

在slave2上

设置两个从节点 只读模式

set global read_only=1;- 1

验证主从同步

在主master上创建库、表并插入数据

create database test1; use test1; insert into info values('小明'); select * from test1.info; //在slave1、slave2上验证// select * from test1.info;- 1

- 2

- 3

- 4

- 5

- 6

- 7

在slave1、slave2上验证

3.2安装 MHA 软件

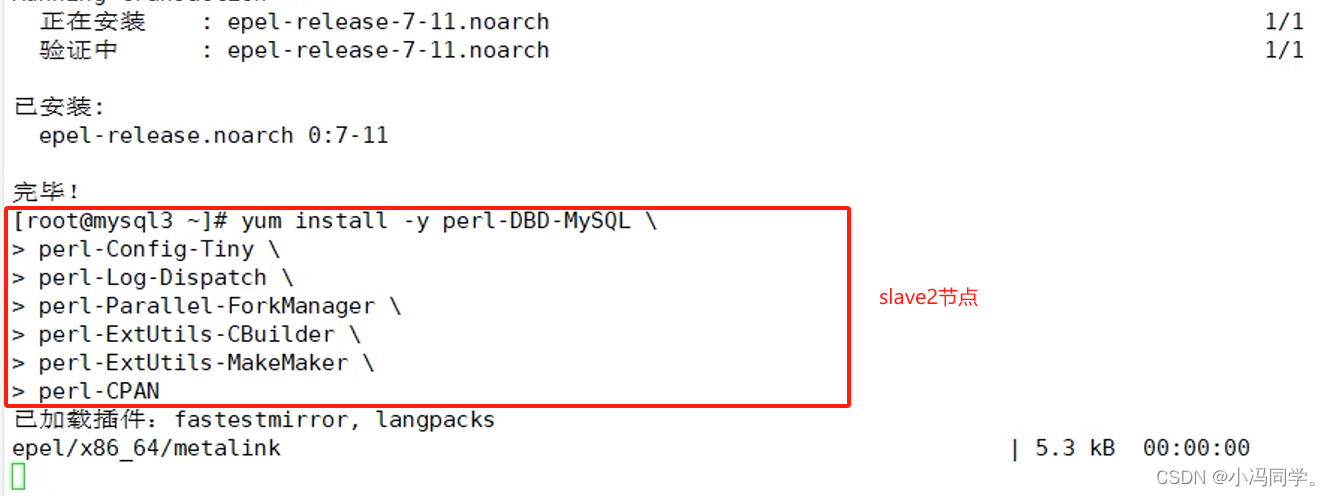

所有服务器上都安装 MHA 依赖的环境,首先安装 epel 源

yum install epel-release --nogpgcheck -y yum install -y perl-DBD-MySQL \ perl-Config-Tiny \ perl-Log-Dispatch \ perl-Parallel-ForkManager \ perl-ExtUtils-CBuilder \ perl-ExtUtils-MakeMaker \ perl-CPAN- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

安装 MHA 软件包,先在所有服务器上必须先安装 node 组件

- 对于每个操作系统版本不一样,这里 CentOS7.4 必须选择 0.57 版本。

- 在所有服务器上必须先安装 node 组件,最后在 MHA-manager 节点上安装 manager 组件,因为 manager 依赖 node 组件。

//将需要的包下载到/opt下 //每台服务器上解压安装node组件// cd /opt tar zxf mha4mysql-node-0.57.tar.gz cd mha4mysql-node-0.57 perl Makefile.PL make && make install- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

将需要的包下载到/opt下

在 MHA-manager 节点上安装 manager 组件

tar zxf mha4mysql-manager-0.57.tar.gz cd mha4mysql-manager-0.57/ perl Makefile.PL make && make install- 1

- 2

- 3

- 4

cd /usr/local/bin/ #manager 组件安装后在/usr/local/bin 下面会生成几个工具,主要包括以下几个: masterha_check_ssh 检查 MHA 的 SSH 配置状况 masterha_check_repl 检查 MySQL 复制状况 masterha_manger 启动 manager的脚本 masterha_check_status 检测当前 MHA 运行状态 masterha_master_monitor 检测 master 是否宕机 masterha_master_switch 控制故障转移(自动或者 手动) masterha_conf_host 添加或删除配置的 server 信息 masterha_stop 关闭manager #node 组件安装后也会在/usr/local/bin 下面会生成几个脚本(这些工具通常由 MHAManager 的脚本触发,无需人为操作)主要如下: save_binary_logs 保存和复制 master 的二进制日志 apply_diff_relay_logs 识别差异的中继日志事件并将其差异的事件应用于其他的 slave filter_mysqlbinlog 去除不必要的 ROLLBACK 事件(MHA 已不再使用这个工具) purge_relay_logs 清除中继日志(不会阻塞 SQL 线程)- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

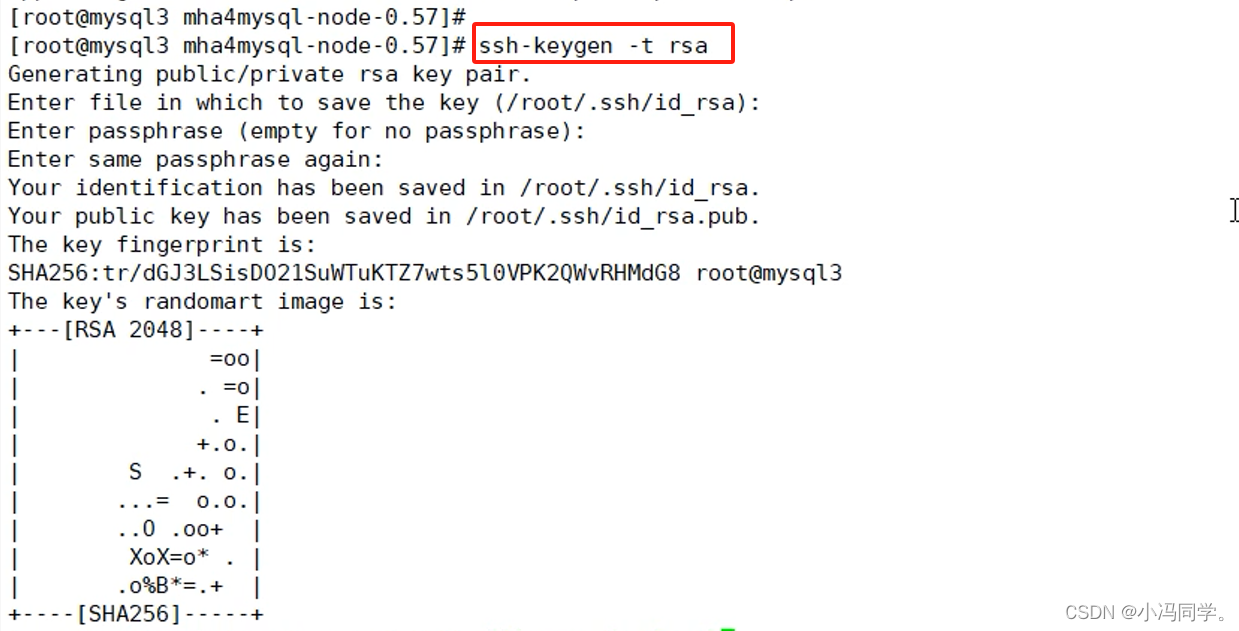

在所有服务器上配置无密码认证

//在 manager 节点上配置到所有数据库节点的无密码认证 ssh-keygen -t rsa //一路按回车键 ssh-copy-id 192.168.190.130 ssh-copy-id 192.168.190.140 ssh-copy-id 192.168.190.170 ////数据库服务器之间互相导入即可//// //在master上 ssh-keygen -t rsa //一路按回车键 ssh-copy-id 192.168.190.140 ssh-copy-id 192.168.190.170 //在slave1上 ssh-keygen -t rsa //一路按回车键 ssh-copy-id 192.168.190.130 ssh-copy-id 192.168.190.170 //在slave2上 ssh-keygen -t rsa //一路按回车键 ssh-copy-id 192.168.190.130 ssh-copy-id 192.168.190.140- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

- 20

- 21

manager节点

master节点

slave1

slave2

在manager节点上ssh免密登录测试以下

在manager节点上操作

cp -rp /opt/mha4mysql-manager-0.57/samples/scripts /usr/local/bin //在 manager 节点上复制相关脚本到/usr/local/bin 目录- 1

- 2

拷贝后会有四个执行文件

ll /usr/local/bin/scripts/ master_ip_failover //自动切换时 VIP 管理的脚本 master_ip_online_change //在线切换时 VIP 的管理 power_manager //故障发生后关闭主机的脚本 send_report //因故障切换后发送报警的脚本- 1

- 2

- 3

- 4

- 5

- 6

- 7

复制上述的自动切换时 VIP 管理的脚本到 /usr/local/bin 目录,这里使用master_ip_failover脚本来管理 VIP 和故障切换

cp /usr/local/bin/scripts/master_ip_failover /usr/local/bin- 1

修改内容如下:(删除原有内容,直接复制并修改vip相关参数。可在拷贝前输入 :set paste 解决vim粘贴乱序问题)

vim /usr/local/bin/master_ip_failover #!/usr/bin/env perl use strict; use warnings FATAL => 'all'; use Getopt::Long; my ( $command, $ssh_user, $orig_master_host, $orig_master_ip, $orig_master_port, $new_master_host, $new_master_ip, $new_master_port ); #############################添加内容部分######################################### my $vip = '192.168.190.200'; #指定vip的地址 my $brdc = '192.168.190.255'; #指定vip的广播地址 my $ifdev = 'ens33'; #指定vip绑定的网卡 my $key = '1'; #指定vip绑定的虚拟网卡序列号 my $ssh_start_vip = "/sbin/ifconfig ens33:$key $vip"; #代表此变量值为ifconfig ens33:1 192.168.80.200 my $ssh_stop_vip = "/sbin/ifconfig ens33:$key down"; #代表此变量值为ifconfig ens33:1 192.168.80.200 down my $exit_code = 0; #指定退出状态码为0 #my $ssh_start_vip = "/usr/sbin/ip addr add $vip/24 brd $brdc dev $ifdev label $ifdev:$key;/usr/sbin/arping -q -A -c 1 -I $ifdev $vip;iptables -F;"; #my $ssh_stop_vip = "/usr/sbin/ip addr del $vip/24 dev $ifdev label $ifdev:$key"; ################################################################################## GetOptions( 'command=s' => \$command, 'ssh_user=s' => \$ssh_user, 'orig_master_host=s' => \$orig_master_host, 'orig_master_ip=s' => \$orig_master_ip, 'orig_master_port=i' => \$orig_master_port, 'new_master_host=s' => \$new_master_host, 'new_master_ip=s' => \$new_master_ip, 'new_master_port=i' => \$new_master_port, ); exit &main(); sub main { print "\n\nIN SCRIPT TEST====$ssh_stop_vip==$ssh_start_vip===\n\n"; if ( $command eq "stop" || $command eq "stopssh" ) { my $exit_code = 1; eval { print "Disabling the VIP on old master: $orig_master_host \n"; &stop_vip(); $exit_code = 0; }; if ($@) { warn "Got Error: $@\n"; exit $exit_code; } exit $exit_code; } elsif ( $command eq "start" ) { my $exit_code = 10; eval { print "Enabling the VIP - $vip on the new master - $new_master_host \n"; &start_vip(); $exit_code = 0; }; if ($@) { warn $@; exit $exit_code; } exit $exit_code; } elsif ( $command eq "status" ) { print "Checking the Status of the script.. OK \n"; exit 0; } else { &usage(); exit 1; } } sub start_vip() { ssh $ssh_user\@$new_master_host \" $ssh_start_vip \"; } A simple system call that disable the VIP on the old_master sub stop_vip() { ssh $ssh_user\@$orig_master_host \" $ssh_stop_vip \"; } sub usage { print "Usage: master_ip_failover --command=start|stop|stopssh|status --orig_master_host=host --orig_master_ip=ip --orig_master_port=port --new_master_host=host --new_master_ip=ip --new_master_port=port\n"; }- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

- 20

- 21

- 22

- 23

- 24

- 25

- 26

- 27

- 28

- 29

- 30

- 31

- 32

- 33

- 34

- 35

- 36

- 37

- 38

- 39

- 40

- 41

- 42

- 43

- 44

- 45

- 46

- 47

- 48

- 49

- 50

- 51

- 52

- 53

- 54

- 55

- 56

- 57

- 58

- 59

- 60

- 61

- 62

- 63

- 64

- 65

- 66

- 67

- 68

- 69

- 70

- 71

- 72

- 73

- 74

- 75

- 76

- 77

- 78

- 79

- 80

- 81

- 82

- 83

- 84

- 85

- 86

- 87

创建 MHA 软件目录并拷贝配置文件,这里使用app1.cnf配置文件来管理 mysql 节点服务器 #创建相关目录

manager节点

配置文件解释如下:[server default] manager_log=/var/log/masterha/app1/manager.log #manager日志 manager_workdir=/var/log/masterha/app1 #manager工作目录 master_binlog_dir=/usr/local/mysql/data/ #master保存binlog的位置,这里的路径要与master里配置的binlog的路径一致,以便MHA能找到 master_ip_failover_script=/usr/local/bin/master_ip_failover #设置自动failover时候的切换脚本,也就是上面的那个脚本 master_ip_online_change_script=/usr/local/bin/master_ip_online_change #设置手动切换时候的切换脚本 password=manager #设置mysql中root用户的密码,这个密码是前文中创建监控用户的那个密码 ping_interval=1 #设置监控主库,发送ping包的时间间隔,默认是3秒,尝试三次没有回应的时候自动进行failover remote_workdir=/tmp #设置远端mysql在发生切换时binlog的保存位置 repl_password=123123 #设置复制用户的密码 repl_user=myslave #设置复制用户的用户 report_script=/usr/local/send_report #设置发生切换后发送的报警的脚本 secondary_check_script=/usr/local/bin/masterha_secondary_check -s 192.168.190.140 -s 192.168.190.170 #指定检查的从服务器IP地址 shutdown_script="" #设置故障发生后关闭故障主机脚本(该脚本的主要作用是关闭主机防止发生脑裂,这里没有使用) ssh_user=root #设置ssh的登录用户名 user=mha #设置监控用户root [server1] hostname=192.168.190.130 port=3306 [server2] hostname=192.168.190.140 port=3306 candidate_master=1 #设置为候选master,设置该参数以后,发生主从切换以后将会将此从库提升为主库,即使这个从库不是集群中最新的slave check_repl_delay=0 #默认情况下如果一个slave落后master 超过100M的 relay logs的话,MHA将不会选择该slave作为一个新的master, 因为对于这个slave的恢复需要花费很长时间;通过设置check_repl_delay=0,MHA触发切换在选择一个新的master的时候将会忽略复制延时,这个参数对于设置了candidate_master=1的主机非常有用,因为这个候选主在切换的过程中一定是新的master [server3] hostname=192.168.190.170 port=3306- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

- 20

- 21

- 22

- 23

- 24

- 25

- 26

- 27

- 28

- 29

- 30

- 31

- 32

- 33

在主节点开启虚拟IP

在 manager 节点上测试 ssh 无密码认证,如果正常最后会输出 successfully。如下所示

masterha_check_ssh -conf=/opt/mysql-mha/mysql_mha.cnf- 1

在 manager 节点上测试 mysql 主从连接情况,最后出现 MySQL Replication Health is OK字样说明正常。如下所示。

masterha_check_ssh -conf=/opt/mysql-mha/mysql_mha.cnf- 1

在 manager 节点上启动 MHA

nohup masterha_manager \ --conf=/opt/mysql-mha/mysql_mha.cnf \ --remove_dead_master_conf \ --ignore_last_failover < /dev/null > /var/log/mha_manager.log 2>&1 &- 1

- 2

- 3

- 4

查看 MHA 状态,可以看到当前的 master 是 Mysql1 节点。

masterha_check_status --conf=/opt/mysql-mha/mysql_mha.cnf- 1

查看 MHA 日志,也以看到当前的 master 是 192.168.59.118,如下所示。

cat /opt/mysql-mha/manager.log | grep "current master"- 1

3.3故障模拟

//在 manager 节点上监控观察日志记录 tail -f /var/log/masterha/app1/manager.log //在 Master 节点 Mysql1 上停止mysql服务 systemctl stop mysqld 或 pkill -9 mysql #在slave1,slave2上查看,正常自动切换一次后,MHA 进程会退出。HMA 会自动修改 app1.cnf 文件内容,将宕机的 mysql1 节点删除。查看 mysql2 是否接管 VIP ifconfig 故障切换备选主库的算法: 1.一般判断从库的是从(position/GTID)判断优劣,数据有差异,最接近于master的slave,成为备选主。 2.数据一致的情况下,按照配置文件顺序,选择备选主库。 3.设定有权重(candidate_master=1),按照权重强制指定备选主。 (1)默认情况下如果一个slave落后master 100M的relay logs的话,即使有权重,也会失效。 (2)如果check_repl_delay=0的话,即使落后很多日志,也强制选择其为备选主。- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

在 manager 节点上监控观察日志记录

tail -f /opt/mysql-mha/manager.log- 1

在 Master 节点 Mysql1 上停止mysql服务

systemctl stop mysqld- 1

manager 节点上监控观察日志记录发生改变

-

相关阅读:

麒麟信安的2023世界计算大会时刻

GraphQL 进阶——DataLoader

git工作流(待续)

寄存器、CPU缓存、内存。以及他们之间的关系

零基础学Java第六节(面向对象二)

2022杭电多校七 1007-Weighted Beautiful Tree(树形DP)

【LeetCode】54. 螺旋矩阵

【STM32】PWM输出

Zookeeper(一)- Zookeeper介绍与集群部署

Soft Actor-Critic Algorithms and Applications

- 原文地址:https://blog.csdn.net/m0_62231324/article/details/133679119