-

神经网络 05(损失函数)

一、损失函数

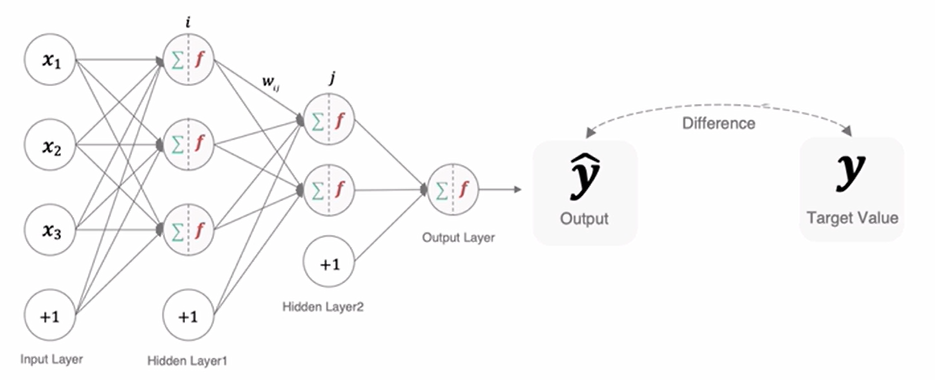

在深度学习中, 损失函数是用来衡量模型参数的质量的函数, 衡量的方式是比较网络输出和真实输出的差异,损失函数在不同的文献中名称是不一样的,主要有以下几种命名方式:

损失函数 (loss function)

代价函数(cost function)

目标函数(objective function)

误差函数(error function)

二、分类任务

在深度学习的分类任务中使用最多的是 交叉熵损失函数

2.1 多分类任务

在多分类任务通常使用softmax将logits转换为概率的形式,所以多分类的交叉熵损失也叫做softmax损失,它的计算方法是:

其中,y 是样本 x 属于某一个类别的真实概率(onehot编码,0或者1),而 f(x) 是样本属于某一类别的预测分数,S 是 softmax 函数,L 用来衡量 p,q 之间差异性的损失结果。

举例:

从概率角度理解,我们的目的是最小化正确类别所对应的预测概率的对数的负值,如下图所示:

在tf.keras中使用CategoricalCrossentropy实现,如下所示:

- # 导入相应的包

- import tensorflow as tf

- # 设置真实值和预测值

- y_true = [[0, 1, 0], [0, 0, 1]]

- y_pred = [[0.05, 0.95, 0], [0.1, 0.8, 0.1]]# 两个交叉熵求平均值

- # 实例化交叉熵损失

- cce = tf.keras.losses.CategoricalCrossentropy()

- # 计算损失结果

- print(cce(y_true, y_pred).numpy()) # 1.176939

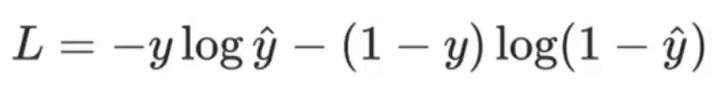

2.2 二分类任务

在处理二分类任务时,我们不再使用 softmax 激活函数,而是使用 sigmoid 激活函数,那损失函数也相应的进行调整,使用二分类的交叉熵损失函数:

跟逻辑回归的损失函数是一样的

其中,y是样本x属于某一个类别的真实概率,而y^是样本属于某一类别的预测概率,L用来衡量真实值与预测值之间差异性的损失结果。

在 tf.keras 中实现时使用 BinaryCrossentropy(),如下所示:

- # 导入相应的包

- import tensorflow as tf

- # 设置真实值和预测值

- y_true = [[0], [1]]

- y_pred = [[0.4], [0.6]]

- # 实例化二分类交叉熵损失

- bce = tf.keras.losses.BinaryCrossentropy() # 两个交叉熵求平均值

- # 计算损失结果

- print(bce(y_true, y_pred).numpy()) # 0.5108254

三、回归任务

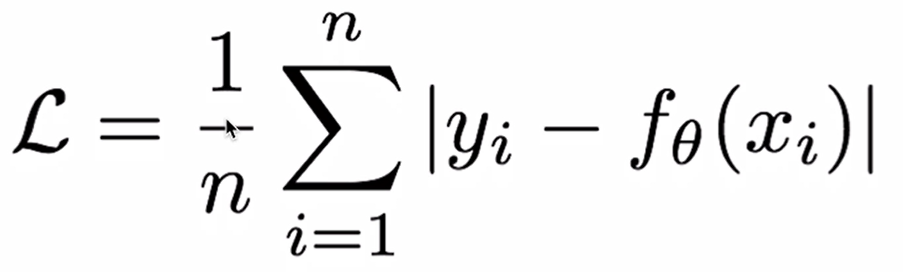

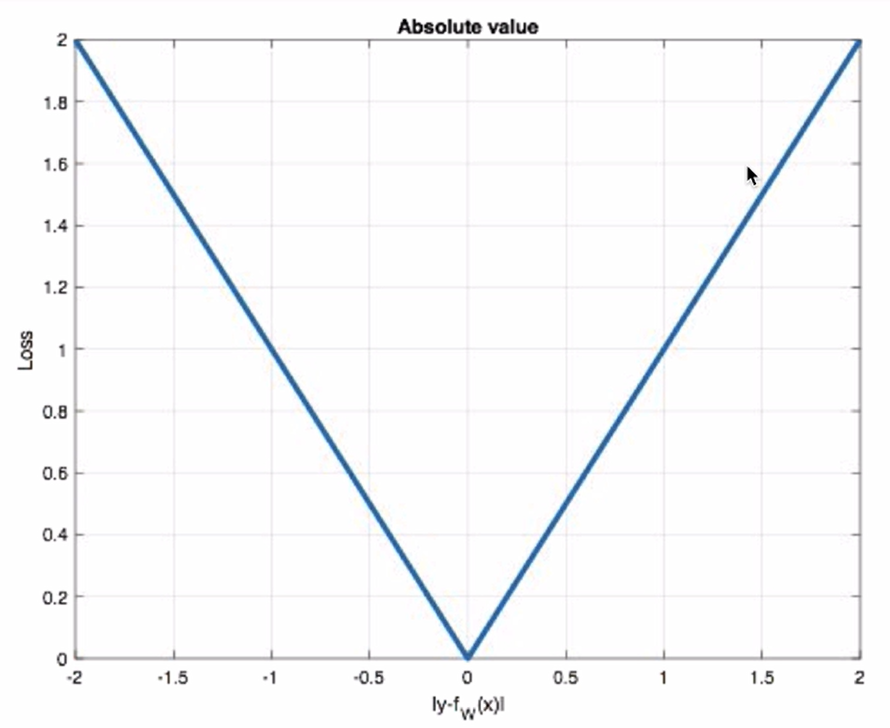

3.1 MAE损失

Mean absolute loss(MAE)也被称为 L1 Loss,是以绝对误差作为距离:

特点是:

由于 L1 loss 具有稀疏性,为了惩罚较大的值,因此常常 将其作为正则项添加到其他 loss中作为约束。

L1 loss 的最大问题是梯度在零点不平滑(不可导),导致会跳过极小值。

在 tf.keras 中使用MeanAbsoluteError 实现,如下所示:

- # 导入相应的包

- import tensorflow as tf

- # 设置真实值和预测值

- y_true = [[0.], [0.]]

- y_pred = [[1.], [1.]]

- # 实例化MAE损失

- mae = tf.keras.losses.MeanAbsoluteError()

- # 计算损失结果

- print(mae(y_true, y_pred).numpy()) # 1.0

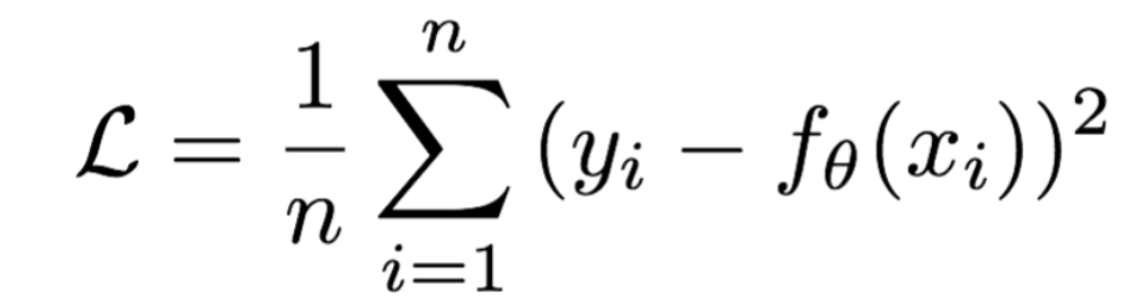

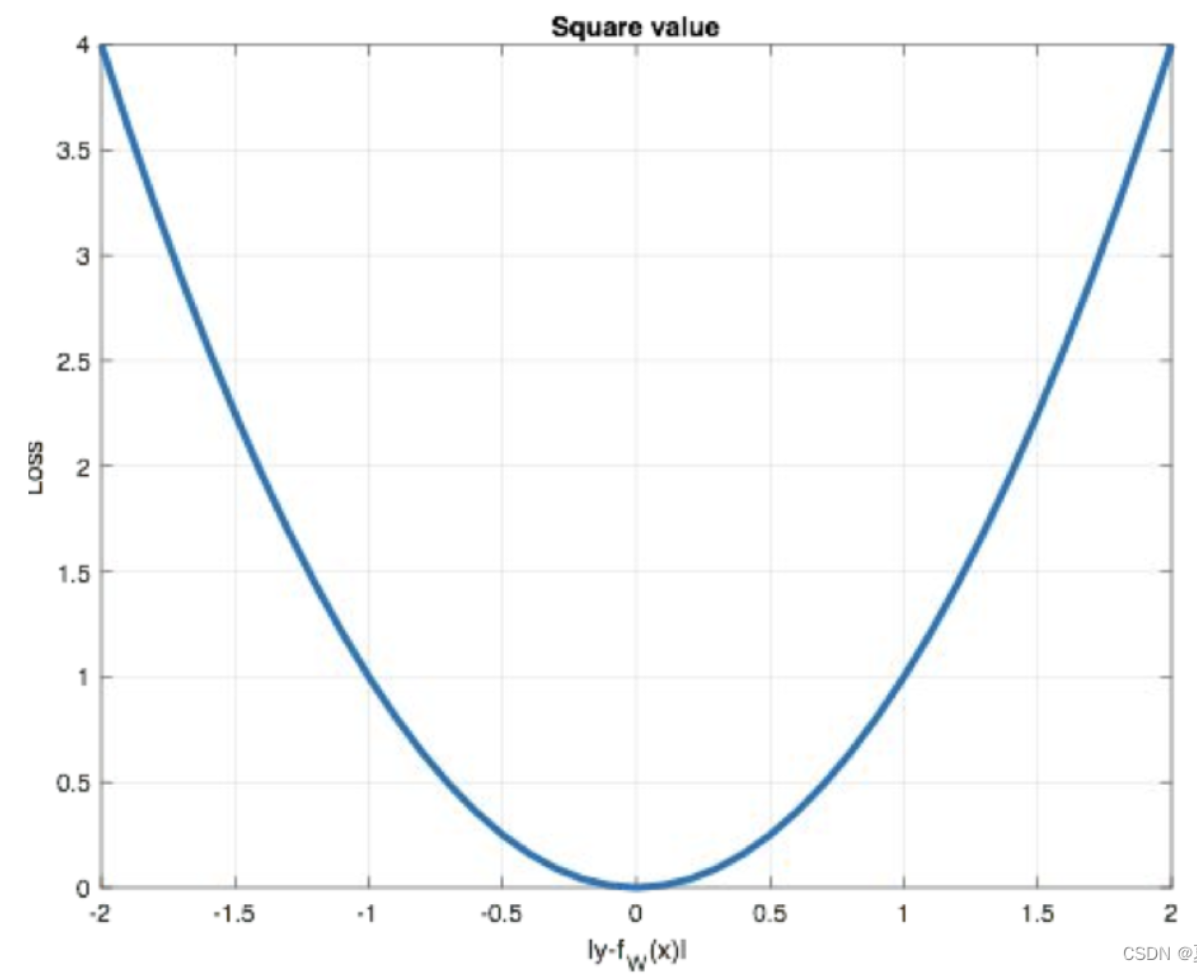

3.2 MSE损失

Mean Squared Loss/ Quadratic Loss(MSE loss) 也被称为 L2 loss,或欧氏距离,它以误差的平方和作为距离

特点是:L2 loss 也常常作为正则项。当预测值与目标值相差很大时, 梯度容易爆炸。

在 tf.keras 中通过 MeanSquaredError 实现:

- # 导入相应的包

- import tensorflow as tf

- # 设置真实值和预测值

- y_true = [[0.], [1.]]

- y_pred = [[1.], [1.]]

- # 实例化MSE损失

- mse = tf.keras.losses.MeanSquaredError()

- # 计算损失结果

- print(mse(y_true, y_pred).numpy()) # 0.5

3.3 smooth L1 损失

其中:𝑥=f(x)−y 为真实值和预测值的差值

从上图中可以看出,该函数实际上就是一个分段函数,在[-1,1]之间实际上就是L2损失,这样解决了L1的不光滑问题,在[-1,1]区间外,实际上就是L1损失,这样就解决了离群点梯度爆炸的问题。通常在目标检测中使用该损失函数。

在 tf.keras 中使用 Huber 计算该损失,如下所示:

- # 导入相应的包

- import tensorflow as tf

- # 设置真实值和预测值

- y_true = [[0], [1]]

- y_pred = [[0.6], [0.4]]

- # 实例化smooth L1损失

- h = tf.keras.losses.Huber()

- # 计算损失结果

- h(y_true, y_pred).numpy() # 0.18

-

相关阅读:

【老生谈算法】matlab实现离散系统的时域分析算法源码——离散系统的时域分析

1.Zookeeper理论基础

ubuntu 18 断网/网络不通,利用 ifconfig -a查看只有lo

Go中的channel

6、STL、迭代器、容器

Linux——命令(基本操作命令)(day14)

基础语言-第18天-csv、Excel文件操作

mysql 启动 报socket ‘/tmp/mysql.sock‘错误

PG14合并库

并发编程 --- 信号量线程同步

- 原文地址:https://blog.csdn.net/peng_258/article/details/132834863