-

9李沐动手学深度学习v2/逻辑回归(softmax回归(分类))简洁实现

import torch from torch import nn from d2l import torch as d2l # 超参数 batch_size = 256 # 数据 train_iter, test_iter = d2l.load_data_fashion_mnist(batch_size)- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

# 模型 # pytorch不会调整input的形状 # 定义展平层(flatten)保留第0维,展开其他维度为1个向量,保留样本数,展开28*28=784,先展平再输入 net = nn.Sequential(nn.Flatten(), nn.Linear(784, 10)) # 初始化参数 def init_weights(m): if type(m) == nn.Linear: nn.init.normal_(m.weight, std=0.01) # 应用到net中 net.apply(init_weights)- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

Sequential( (0): Flatten(start_dim=1, end_dim=-1) (1): Linear(in_features=784, out_features=10, bias=True) )- 1

- 2

- 3

- 4

# 损失函数 loss = nn.CrossEntropyLoss()- 1

- 2

# 优化算法 以一定的学习率去学习 更新参数 trainer = torch.optim.SGD(net.parameters(), lr=0.1)- 1

- 2

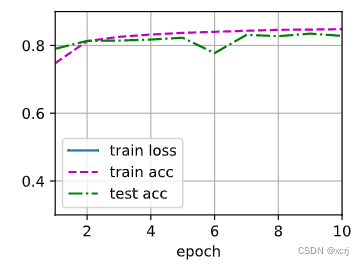

# 开始训练 num_epochs = 10 # todo(训练的结果曲线没有 train loss) d2l.train_ch3(net, train_iter, test_iter, loss, num_epochs, trainer)- 1

- 2

- 3

- 4

query

softmax中含有指数exp

- 答:exp指数难以逼近0或1

softlabel应用于为了解决softmax的问题

- 答:将正确类别记为0.9(原来认为是1),错误类别记为0.1/n(原来认为是0)。最后使用softmax可以完全拟合。在图片分类任务中默认会使用的trick

- 答:二分类问题,其实只对正1代表类别做预测或负1代表类别做预测

交叉熵,相对熵

- 答:相对熵,不好算

类别不平衡

- 答:关心每个类别的数据量更有效,数据量都足够就行了

似然函数,最大似然估计?todo

- 答:最小化损失=最大化似然函数(最相似)

- 答:数据和模型给定的情况下,调整模型参数,使得模型与数据最贴合,最相似

排序回归(ranking)可以使用softmax吗

- 答:可以,效果不会差,关键是数据

方差参数初始化

- 答:方差在深度神经网络中是有讲究的

batch_size

- 答:不同大小在,在CPU上没有大的区别,在GPU上有大区别,GPU的核心数多

net.eval():模型设置为评估模式

- 答:提高模型评估时的性能

测试精度先上升再下降是过拟合?

- 答:很可能是过拟合了

-

相关阅读:

5.HTML结构及标签结构介绍

(续)SSM整合之SSM整合笔记(ContextLoaderListener)(P179-188)

Git(11)——Git相关问题解答以及常用命令总结

单片非晶磁性测量系统典型磁参数的不确定度与重复性

如何使用Java对doc文档拆分,但无法获取表格位置,只能统一获取表格?

OpenCV图像处理学习十六,解析图像卷积运算原理并应用Sobel算子,Scharr算子和拉普拉斯算子(Laplance)的应用

2022最全Java后端面试真题、两万字1000+道堪称史上最强的面试题不接受任何反驳

leetcode92-Reverse Linked List II

OD【1】:自定义Dataset

向openssl中添加一个最简单的算法

- 原文地址:https://blog.csdn.net/baidu_35805755/article/details/126610040