-

只需这个下毒小工具,让Stable Diffusion彻底崩溃!狗变猫,车变牛,AI侵权打响反击战

作者 | 谢年年

文生图模型如DALL-E、Midjourney和Stable Diffusion等越来越火热,只需要一句话几秒钟就可以生成质量不逊艺术家辛辛苦苦创作数月的图片。

艺术家们表示很气但又无能为力。

大模型研究测试传送门

GPT-4传送门(免墙,可直接测试,遇浏览器警告点高级/继续访问即可):

http://hujiaoai.cn这些模型如此强大离不开全网爬取收集的训练数据。那如果在这些训练图片中加一点“毒药”,能不能使模型中毒,扰乱模型的生成?

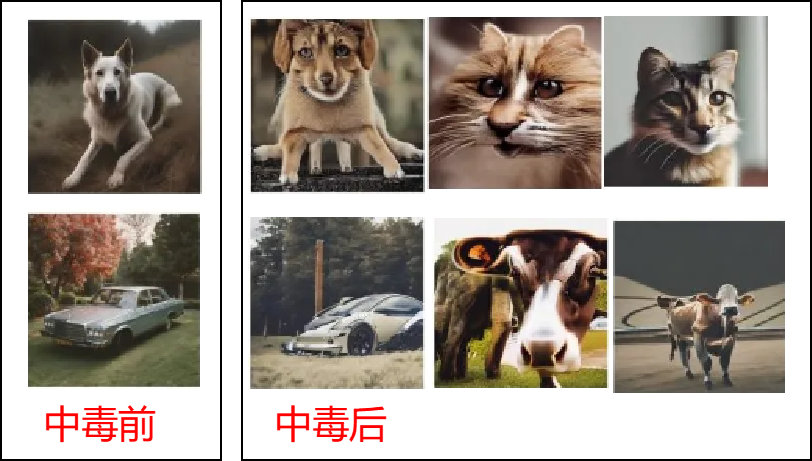

比如,明明让模型生成一只狗却生成了猫!

让模型生成车最后却生成了一只牛!

手提包变成面包,帽子变成蛋糕?!

并且这中毒症状随着中毒样本增多愈发明显。

这是由芝加哥大学团队打造的新工具Nightshade实现的,可以让艺术家在将他们的作品上传至网络之前,对像素进行隐形修改,得到一张与原始图像几乎无差别的新图像。

左图是原图,右图是修改后的,好家伙。即使模型会过滤训练数据,这也扛不住这波无色无味无形的毒药啊!

毒药的威力有多强大呢?

研究人员对Stable Diffusion的最新模型以及他们自己从头开始训练的一个AI模型进行了攻击测试。结果表明,仅需50个被污染的图像,输出结果就会开始变得奇怪,而增加到300个被污染的样本,模型就会生成牛头不对马嘴的其他生物,甚至还可以彻底改变图像的风格。

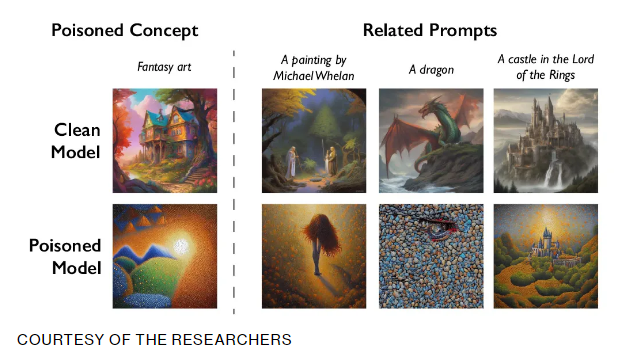

除此之外,由于生成式AI模型非常容易在词语之间建立联系,导致这种“毒”的传染力也很强。

团队发现,一旦Nightshade感染了"狗"这个词,其他所有类似的概念比如“小狗”、“哈士奇”、“狼”也会中招。

有间接联系的概念也同样会受影响,标为“奇幻艺术”的有毒图像,也会影响“龙”、“《指环王》中的城堡”等的生成。

除了易感染、传染力度强,“解毒”也需要耗费不少时间,因为这些被污染的数据非常难以移除,需要技术公司耗费大量时间逐个查找并删除每个受损样本。

这时,人们又免不了担心,这样强的污染技术被恶意滥用,恶意攻击怎么办?

团队leader赵教授表示,攻击者需要成千上万个被污染的样本才能对更大、更强大的模型造成实质性的损害,对目前市面上基于数十亿个数据样本进行训练的模型暂时影响不大。

所以Nightshade的目标是为了创建一个强有力的威慑力量,防止侵犯艺术家的版权和知识产权。

从技术上给艺术家们撑腰!

让一些AI公司警惕并重视侵权问题,如果一些AI公司还是肆意使用未经艺术家授权的作品训练模型的话,这些被“污染”的数据,就会导致文生图模型出现混乱且不可预测的故障。

该团队还计划将Nightshade开源,这将允许其他人对其进行调整并创建自己的版本。赵教授表示,使用和创建自己版本的人越多,这个工具的威力就越大。大型AI模型的数据集可能包含数十亿张图像,因此将更多的污染图像纳入模型,这种技术将会造成更大的破坏。

据MIT科技评论消息,Nightshade的研究已向网络安全顶会Usenix提交同行评审。

强强联合,Glaze同样破坏文生图模型

在Nightshade之前,研究团队还开发了一款名为Glaze的工具,它允许艺术家"掩盖"自己的个人风格,以防止被人工智能公司擅自使用。它的工作方式与Nightshade类似:通过微妙地改变图像的像素,扰乱原图的风格,这种变化对人眼来说是不可见的,但却可以破坏文生图模型。

该工作已经发表在USENIX(信息安全领域四大顶级学术会议之一)会议上,并获得杰出论文奖。

论文标题:

Glaze: Protecting Artists from Style Mimicry by Text-to-Image Models论文链接:

https://arxiv.org/pdf/2302.04222.pdf官网:

https://glaze.cs.uchicago.edu/让我们来看看具体是怎么做的。

▲整体框架图

简单来说,作者从风格迁移的思路扰乱图像的像素,流程如下:

-

给定一幅艺术作品 ,选定与原风格尽可能不同的目标风格T

-

进行风格迁移得到。

-

计算一个扰动δ,使得扰动后的图像δ 尽可能相似,同时最小化视觉影响。

-

最后上传优化后的图片x+δ_x

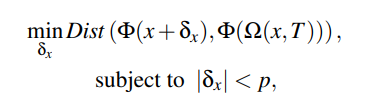

具体优化目标如下公式所示,

其中Φ是一个通用的图像特征提取器,通常用于文本到图像的生成任务,Dist(.)计算两个特征表示的距离,|δx|测量感知扰动,p是感知扰动预算。

此时如果将经过扰动的图像拿去训练模型,就无法生成具有原图画风的图片了,以此保护了艺术家们的风格不被剽窃。

最终的效果,也挺不错:

-

1-2栏为艺术家原创作品;

-

第3栏为未使用保护的仿制品(不得不说模仿到了精髓);

-

第4栏:用于风格转移作品和目标风格名称;

-

第5-6列:Glaze处理后模仿艺术品。

该团队打算将Nightshade整合到Glaze中,强强联合,双管其下,艺术家可以自己选择是否要下毒。

引发热议

这个工具不仅引起了艺术家和专家学者的广泛讨论。

滑铁卢大学研究数据隐私和人工智能模型稳健性的助理教授Gautam Kamath认为这项工作“非常棒”,并表示:

对于这些新模型,漏洞并不会神奇地消失,实际上只会变得更加严重。随着这些模型的不断增强和人们对其的信任不断加深,情况变得尤为明显,因为随着时间的推移,所面临的风险只会不断上升。

研究深度学习系统安全性的哥伦比亚大学计算机科学教授(Junfeng Yang)表示:

如果Nightshade能让人工智能公司更加尊重艺术家的权利,比如更愿意支付版税,那么它可能会产生重大影响。

插画家兼艺术家伊娃·图伦特(Eva Toorenent)使用过Glaze,并希望Nightshade能改变现状。

这会让(AI公司)三思而后行,因为它们有可能在未经我们同意的情况下拿走我们的工作,从而毁掉自己的整个模式。”

另一位艺术家秋·贝弗利(Autumn Beverly)表示像Nightshade和Glaze这样的工具给了她再次在网上发布作品的信心。在发现照片在未经她同意的情况下被抓取到流行的LAION图像数据库后,她将其从网上删除。她说,

我真的很感激,我们有一个工具,可以帮助艺术家们把权力交还给他们自己。

而康奈尔大学的教授Vitaly Shmatikov从模型防御的角度发表了看法:

我们还不知道如何对抗这些攻击。我们还没有在现实环境中看到对模型的毒化攻击,但这只是时间问题, 现在是研究防御措施的时候了。

最后,屏幕前的小伙伴们,你们觉得应该给图片"下毒"吗?

参考资料

[1]https://www.technologyreview.com/2023/10/23/1082189/data-poisoning-artists-fight-generative-ai/

[2]https://venturebeat.com/ai/meet-nightshade-the-new-tool-allowing-artists-to-poison-ai-models-with-corrupted-training-data/ -

-

相关阅读:

噪音人声识别接口

CentOS7 Hive2.3.8安装

HJ17 坐标移动----牛客刷题

自动驾驶-BEV感知综述

[go 反射] 函数

Excel数据处理:动态数据分析报表、单元格数字格式、使用排序工具

Oracle 数据库集群常用巡检命令

实现线程安全的常见手段

Redis集群选举原理与脑裂问题

[Servlet/Tomcat] HttpServletRequest#getHeader(headerNameWithIgnoreCase)(获取header时不区分大小写)

- 原文地址:https://blog.csdn.net/xixiaoyaoww/article/details/134067498