-

深度学习第三章

变量左上角的圆括号表示第几个样本,方括号代表变量所在的层级。

上图的每一层对应两个运算,即计算z和计算a。

隐藏层表示在训练集中看不到它们的数值。

输入层不计算层数,为第0层。除了输入层其他层都带有参数w和b。

当有一个隐层数为1的网络时,需要进行下图的左侧四个运算。

下图中Z矩阵横向指标对应了不同的训练样本, 竖向指标对应了神经网络中的不同节点。

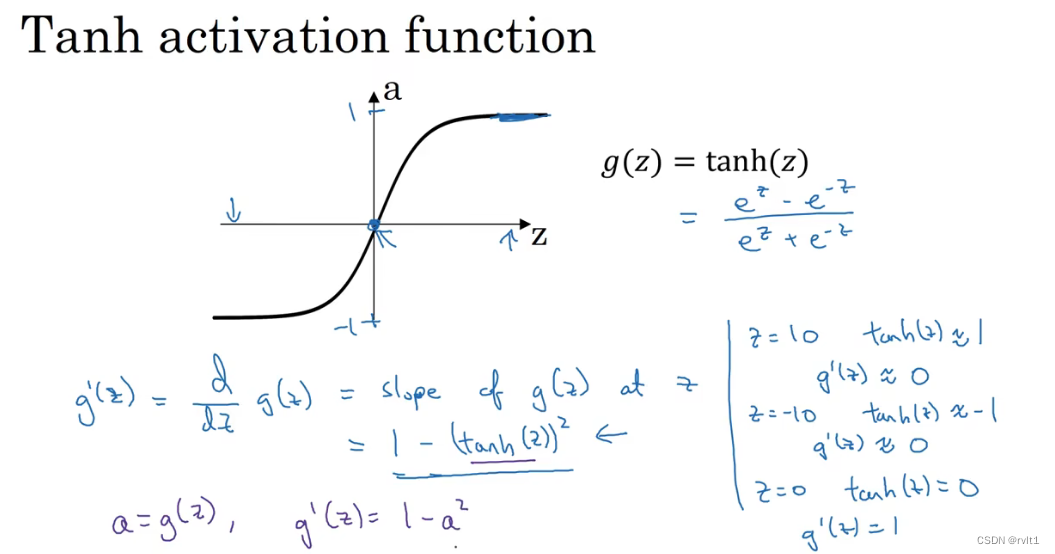

sigmod就是激活函数,但是还多很多其他的激活函数。如tanh函数总比sigmod函数的效果更好。不同层的激活函数可以不一样。激活函数右上角方括号表示所在层数。

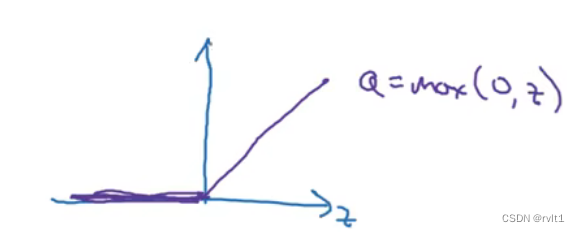

修正线性单元reLU:

选择激活函数的一些经验:

1.如果输出值是0和1,即二值分类,那么sigmod函数很适合作为输出层的激活函数,然后所有单元都用reLU。如果不确定激活函数的选择,reLU是很好的选择。激活函数的利弊:

1.sigmod函数除非用在二元分类的输出层,不然绝对不要用。tanh几乎在所有场景都优于sigmod函数。

2.reLU是不确定时最优选择的函数,有时也可以尝试leaky reLU。

各个激活函数的求导:

前向和后向传播的过程

W参数需要随机化,b不需要。

-

相关阅读:

git基本命令

算法金 | 只需十四步:从零开始掌握Python机器学习(附资源)

Linux 安装 + 常用命令 + 项目部署

vue2项目从0搭建(二):配置代理,登录功能和菜单权限

洛谷P1223 排队接水

如何实现企业软件的“超级 App 化”?

企业IP地址管理(IPAM)

网页翻译软件-网页自动采集翻译软件免费

猿创征文|在第一轮复习中,考研路上的成长历程

【Java刷题系列】03构造类

- 原文地址:https://blog.csdn.net/skykone1/article/details/126087659