-

Python:使用PyAV提取视频关键帧

1.软件环境⚙️

Windows10教育版64位

Python3.6.3

PyAV8.0.32.问题描述🔍

在提取视频文件的关键内容时,手动查看会非常耗时。即使你快进视频,一个小时的视频也需要超过

10分钟;通常,一秒钟的视频包含24帧图像。如果你能捕获视频中的关键帧(key frame,你可以把它理解成论文里面的摘要,看完关键帧就知道这个视频主要在讲什么了),尤其是在长时间拍摄类似镜头的场景中,对图像进行重复数据消除将有助于过滤掉大多数噪声帧,并最大程度地提取视频的核心内容。随着短视频越来越流行,视频的内容分析与文本的内容分析一样重要。然而,如果每个分析师都想看每一段视频,那就需要太多时间。即使使用快进功能,节省的时间仍然不够。此外,由于人为疏忽,内容分析会出现错误和遗漏。相较于基于文本的内容分析,会发现一个主要的区别:查看文本内容可以一目十行,并且没有强制的前后时间线。相反,观看流媒体必须消耗流媒体的长度。然后我们会有一个问题:我们能一目了然地看到流媒体吗?事实上,视频流中的大量信息是冗余的,并且信息量非常低。信息量仅集中在一个关键帧(也称为

信息帧或I帧)图片中。如果你把这些图片一张一张地放在面前,你也可以做到像文本内容一样一目十行,减少人为疏忽。关于视频的相关概念可以看一下这个博客:

音视频pts、dts基本概念及理解那么有没有什么方法能够高效的提取视频的关键帧呢?

3.解决方法🐡

当然有啦,这就是我们今天的主角——

PyAV:

PyAV是FFmpeg的Pythonic绑定,其目标是提供FFmpeg底层库的所有功能。PyAV通过容器、流、数据包、编解码器和帧直接和精确地访问视频媒体。同时,它能够方便的和其他库进行对接,并帮助您从其他包(例如Numpy和Pillow)获取和修改数据,提取视频关键帧就更不在话下了!

不废话了,直接上代码:''' =========================================== @author: jayce @file: extract_video_keyframes_av.py @time: 2022/4/11 21:42 =========================================== ''' import av import os import shutil path_to_video = r'E:\Code\Python\extract_video_keyframes\test video.mp4' output_dir = r'E:\Code\Python\extract_video_keyframes\pyav' # # 提取全部帧 # container = av.open(path_to_video) # # for frame in container.decode(video=0): # frame.to_image().save(r'E:\Code\Python\比例尺鉴定\20220410比例尺鉴定\extract_video_keyframes\pyav\frame-%04d.png' % frame.index) def extract_video_keyframes(path_to_video, output_dir): try: os.makedirs(output_dir, exist_ok=True) # 提取关键帧 with av.open(path_to_video) as container: # 表示我们只想查看关键帧 stream = container.streams.video[0] stream.codec_context.skip_frame = 'NONKEY' for frame in container.decode(stream): print(frame) # 使用frame.pts的原因是frame.index对skip_frame没有意义,因为关键帧是从所有的帧中抽取中独立的图像,而pts显示的就是这些独立图像的index; # DTS(Decoding Time Stamp):即解码时间戳,这个时间戳的意义在于告诉播放器该在什么时候解码这一帧的数据。 # PTS(Presentation Time Stamp):即显示时间戳,这个时间戳用来告诉播放器该在什么时候显示这一帧的数据。 frame.to_image().save(os.path.join(output_dir, 'temporary-image-{:04d}.png'.format(frame.pts))) except Exception as e: print('Program error occurred:{}'.format(repr(e))) if __name__ == "__main__": extract_video_keyframes(path_to_video, output_dir) # shutil.rmtree(output_dir)- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

- 20

- 21

- 22

- 23

- 24

- 25

- 26

- 27

- 28

- 29

- 30

- 31

- 32

- 33

- 34

- 35

- 36

- 37

- 38

- 39

- 40

- 41

- 42

- 43

- 44

- 45

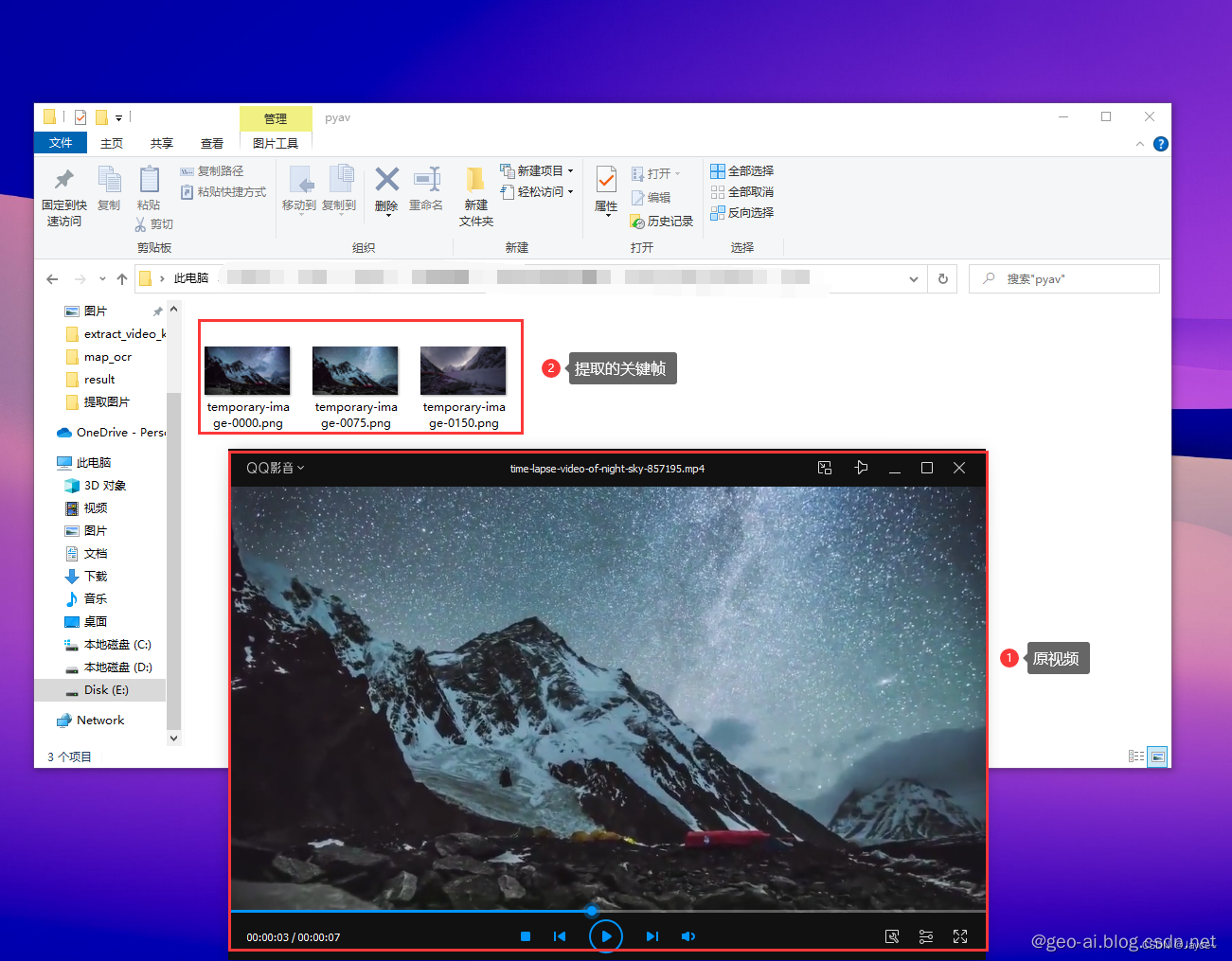

4.结果预览🤔

渣男!都看到这里了,还不赶紧点赞,评论,收藏走一波? -

相关阅读:

ubuntu 20.04 SD 卡分区类型 msdos 改为 GPT 的方法

haproxy详解

ERROR 2006 (HY000): MySQL server has gone away

【java学习—八】==操作符与equals方法(2)

Linux网络编程(一)

大龄程序员三战考研变身考研战神

ES6知识点总结——学习网站及环境搭建

自用函数(持续更新)

Python——多线程编程

Infuse Mac视频播放器 中文

- 原文地址:https://blog.csdn.net/qq_15969343/article/details/126077566