-

G-DetKD

G-DetKD

参考文献:

具有前景注意力机制的特征图模型方法:

对比蒸馏:

基于掩码的蒸馏方法:

基于对比和语义引导模仿的目标检测器通用蒸馏框架

摘要

以前的缺点:以往的特征模仿通过mask来区分前背景,这导致不能充分利用FPN中所有层次的语义信息,导致基 于FPN的检测器之间的知识蒸馏效率地下。

方法:1)在所有FPN层上自动执行特征之间的软匹配,为学生提供最优指导;

2)为了进一步推动边界,引入对比蒸馏有效地捕获编码在不同特征区域之间关系中的信息

优点:1)在框架中的组件分别使用和结合;

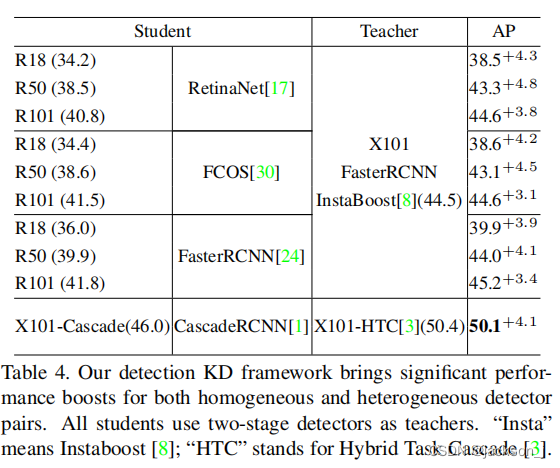

2)可以应用在同构和异构的学生-教师对中;

3)效果更好;

Introduction

基于掩膜的方法问题:1)在所有层次上不加区别地应用相同地掩膜可能会引入来自无响应特征层的噪声;2)基于掩膜的方法不能扩展到异构检测器,因为他们的特征级别可能不是严格对齐的,例如,FasterRCNN从P2到P6构建特征金字塔,而RetinaNet使用P3到P7。

最适合模仿的特征可能来自不同的金字塔层次;

相邻特征层有相似的语义,因此其他具有相似语义的层次的学生特征也可以模仿;

不同区域的信息也可以帮助学生学习,利用师生对产生的proposal区域构建正负比较对,然后采用InfoNCE损失来最小化正对之间的距离,同时推开负对。

贡献:

1)提出了一种基于语义感知软匹配机制的语义引导特征模仿方法(SGFI);

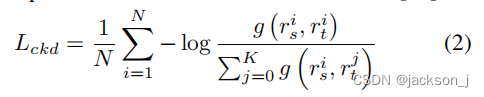

2)我们提出对比知识蒸馏(CKD)来捕获编码在教师不同特征区域之间关系中的信息;

3)我们首次尝试构建一个通用KD框架(G-DetKD),该框架能够提取同构和异构检测器对的知识。我们进行了全面的实验,以证明我们的方法带来的显著性能提升;

Prelimianry

认为FPN的直接适应是次优的原因:

1)一般来说,在FPN的设计范式中,每个特征层负责检测不同尺度的对象。因此,在所有层上不加区别地应用相同的掩模会引入来自无响应特征层的噪声;

2)基于掩码的方法不能扩展到异构检测器对,因为它们的特征金字塔级别可能不是严格对齐的

Methods

4.1. Semantic-Guided Feature Imitation (SGFI)

ROI提取操作不是在所有特征层上统一地模仿前景区域,而是基于object proposal进行细粒度的选择前景特征,并根据尺度自动匹配对应层次的特征;

在模仿的过程中,还应考虑到其他层次的学生特征,这些特征具有相似的语义,以充分发挥教师表示权的潜力

4.2. Exploiting Region Relationship with Contrastive KD (CKD)

对同一盒子的表征构成正对,对不同盒子的表征构成负对

4.3. General Detection KD Framework (G-DetKD)

对于同构教师学生网络:

L = L g t + L f e a t + L c k d + L c l s + L r e g L = L_{gt} +L_{feat}+L_{ckd}+L_{cls}+L_{reg} L=Lgt+Lfeat+Lckd+Lcls+Lreg

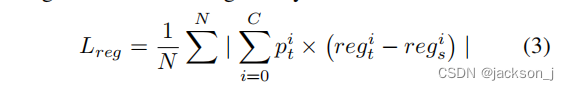

其中, L g t L_{gt} Lgt是ground truth损失, L f e a t L_{feat} Lfeat、 L c k d L_{ckd} Lckd、 L r e g L_{reg} Lreg是公式1,2, L c l s = − 1 N ∑ N P t l o g P s L_{cls} = -\frac{1}{N}\sum_{}{N}P_tlogP_s Lcls=−N1∑NPtlogPs,

对于异构教师学生网络:

L = L g t + L f e a t + L c k d L = L_{gt} +L_{feat}+L_{ckd} L=Lgt+Lfeat+Lckd

Experimes

-

相关阅读:

计算机毕业设计Java无人值守台球厅智能管理监控系统(源码+系统+mysql数据库+Lw文档)

【Python】爬虫代理IP的使用+建立代理IP池

交叉编译嵌入式openssl,关键是在config中指定编译器前缀

Mongo聚合分析命令浅析

有可以在家做的赚钱兼职吗?

软件测试项目实战案例分解,跟着我一步一步操作【人力资源管理系统】

大数据开发(Hadoop面试真题-卷二)

vue基础复习

Python datetime,try-except-else-finally

什么是泛型,泛型的具体使用?

- 原文地址:https://blog.csdn.net/jackson_j/article/details/125635133