-

Haproxy

haproxy的性能

-

可靠性和稳定性非常好,可以与硬件级的F5负载均衡设备相媲美;

-

最高可以同时维护40000-50000个并发连接,单位时间内处理的最大请求数为20000个,最大处理能力可达10Git/s;

-

支持多达8种负载均衡算法,同时也支持会话保持;

-

支持虚拟机主机功能,从而实现web负载均衡更加灵活;

-

支持连接拒绝、全透明代理等独特的功能;

-

拥有强大的ACL支持,用于访问控制; sendfile

-

其独特的弹性二x树数据结构,使数据结构的复杂性上升到了0(1),即数据的查寻速度不会随着数据条日的增加而速度有所下降;·支持客户端的keepalive功能,减少客户端与haproxy的多次三次握手导致资源浪费,让多个请求在一个tcp连接中完成;

-

支持TCP加速,零复制功能,类似于mmap机制;

-

支持响应池(response buffering) ;

-

支持RDP协议;

-

基于源的粘性,类似nginx的ip hash功能,把来自同一客户端的请求在一定时间内始终调度到上游的同一服务器;·更好统计数据接口,其web接口显示后端集群中各个服务器的接收、发送、拒绝、错误等数据的统计信息;

-

详细的健康状态检测,web接口中有关于对上游服务器的健康检测状态,并提供了一定的管理功能;

-

基于流量的健康评估机制;

-

基于http认证;

-

基于命令行的管理接口;

-

日志分析器,可对日志进行分析

haproxy的负载均衡

(1) roundrobin,表示简单的轮询 rr

(2) static-rr,表示根据权重

(3) leastconn,表示最少连接者先处理

( 4) source,表示根据请求源IP

(5) uri,表示根据请求的URI,做cdn需使用;

(6) url param,表示根据请求的URl参数' balance url param’requires an URL parameter name

(7) hdr(name),表示根据HTTP请求头来锁定每一次HTTP请求;

(8) rdp-cookie (name),表示根据据cookie(name)来锁定并哈希每一次TCP请求。

LVS nginx haproxy的区别

-

IVS基于Linux操作系统实现软负载均衡,而HAProxy和Nginx是基于第三方应用实现的软负载均衡;

-

LVS是可实现4层的IP负载均衡技术,无法实现基于目录、URL的转发。而HAProxy和Nginx都可以实现4层和7层技术,HAProxy可提供TCP和HTTP应用的负载均衡综合解决方案;

-

LVs因为工作在TCP模型的第四层,其状态监测功能单一,而HAProxy在状态监测方面功能更丰富、强大,可支持端口、URI等多种状态检测方式;

-

HAProxy功能强大,但整体性能低于4层模式的IVS负载均衡。

-

Ngrinx主要用于web服务器或缓存服务器。Nginx的upstream模块虽然也支持群集功能,但是对群集节点健康检查功能不强,性能没有Haproxy好。

第三方yum仓库安装haproxy

- yum install centos-release-scl-rh

- yum install rh-haproxy18-haproxy

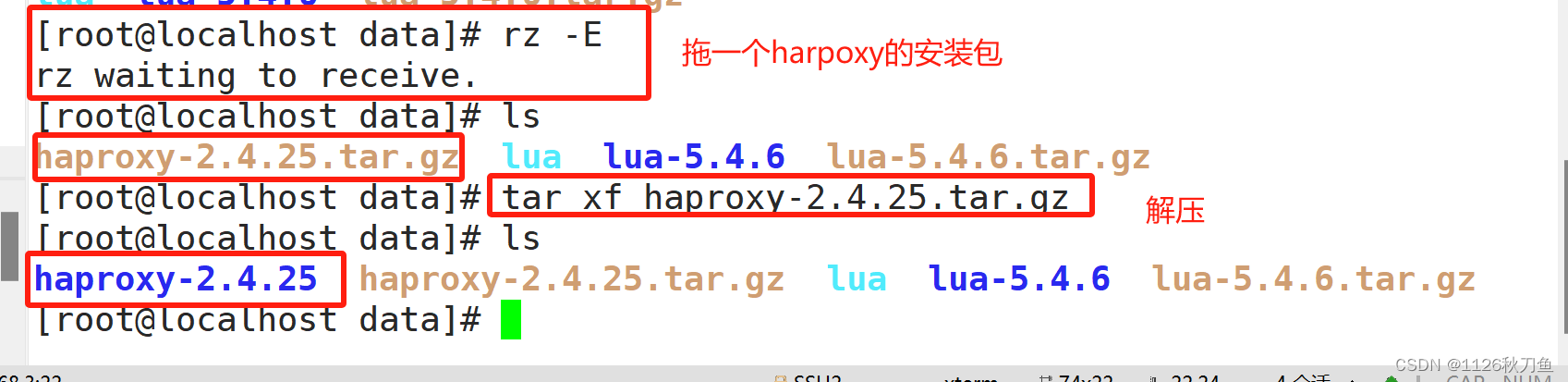

编译安装haproxy

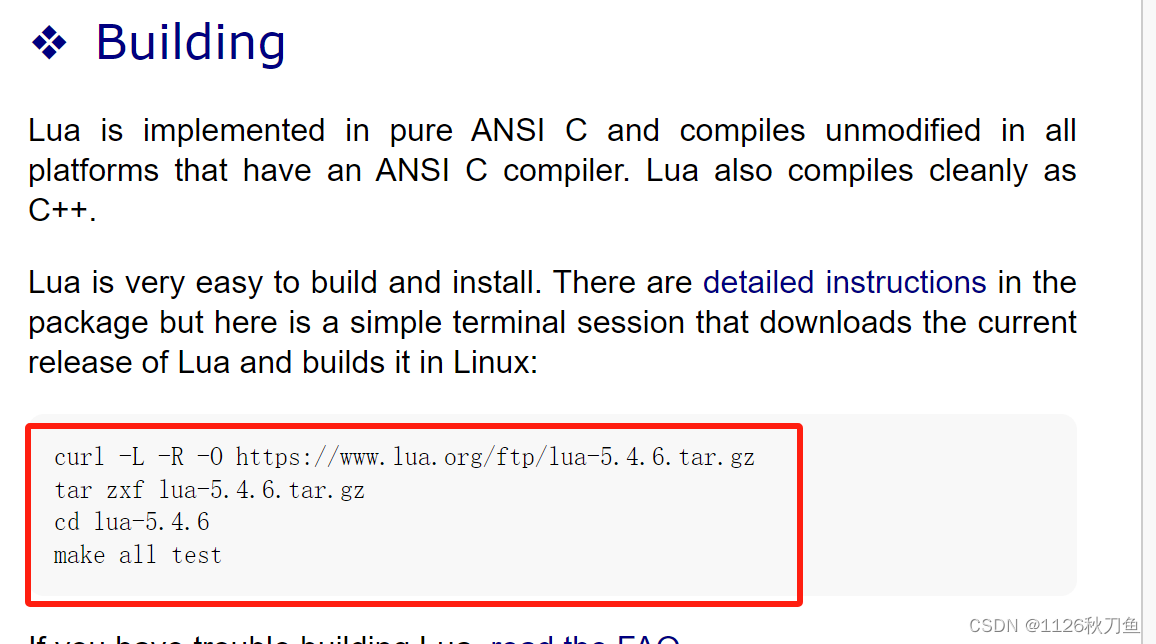

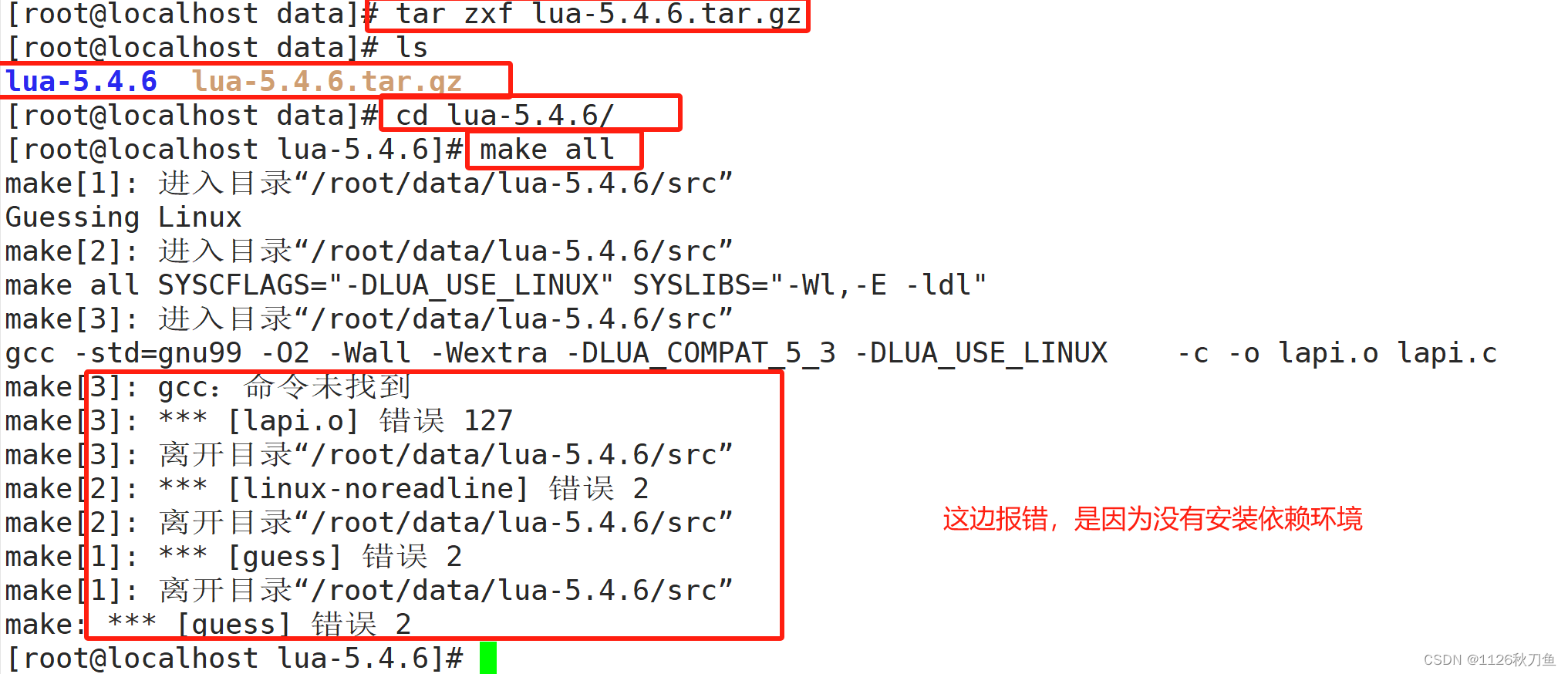

第一步,要先解决lua版本的问题

由于CentOS7 之前版本自带的lua版本比较低并不符合HAProxy要求的lua最低版本(5.3)的要求,因此需要编译安装较新版本的lua环境,然后才能编译安装HAProxy,

进入lua的官网,下载包

- curl -L -R -O https://www.lua.org/ftp/lua-5.4.6.tar.gz

- tar zxf lua-5.4.6.tar.gz

- cd lua-5.4.6

- make all test

因此,要在lua里面安装依赖环境

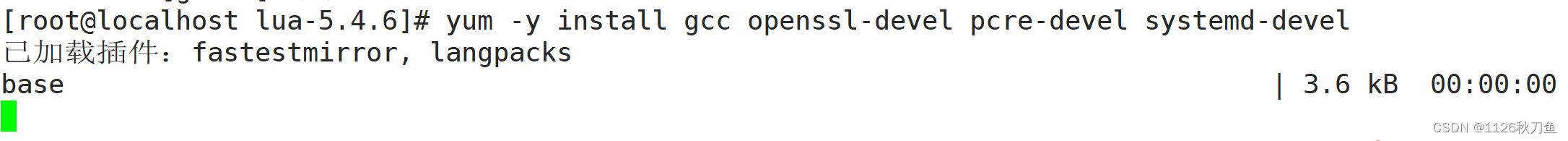

因此,要在lua里面安装依赖环境yum -y install gcc openssl-devel pcre-devel systemd-devel

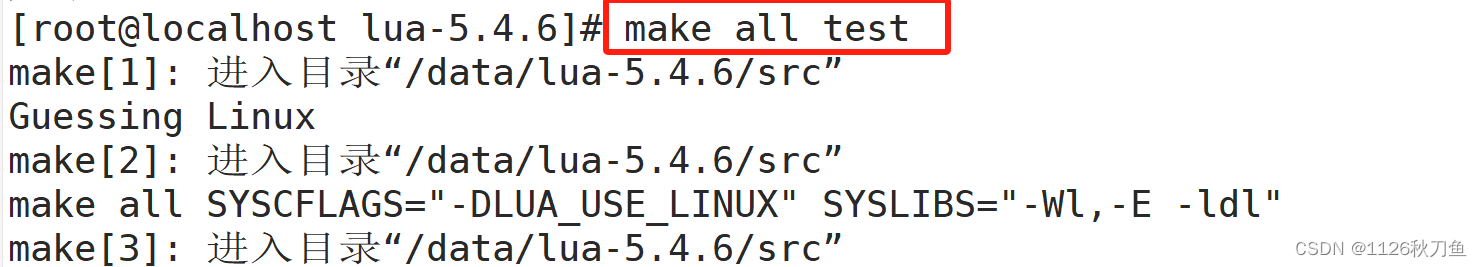

安装过依赖环境,再去make all test

然后给lua-5.4.6做一个软连接

随后安装haproxy

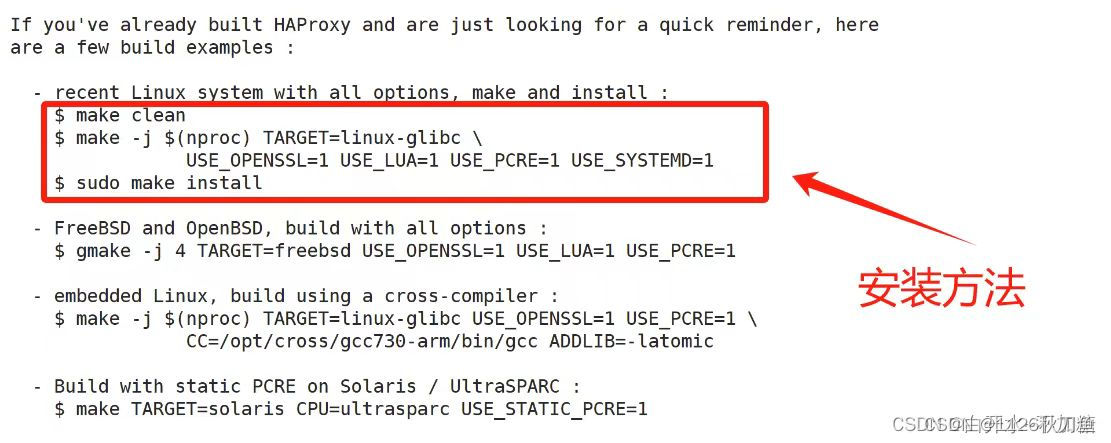

haproxy的安装路径不是./configure 可以切换到haproxy里面的说明进行查看

haproxy的安装路径不是./configure 可以切换到haproxy里面的说明进行查看

- make clean

- #清除之前编译过程中产生的目标文件和临时文件,确保从一个干净的状态开始新的编译过程。

- make -j $(nproc) TARGET=linux-glibc USE_OPENSSL=1 USE_LUA=1 USE_PCRE=1 USE_SYSTEMD=1

- -j $(nproc)

- #使用系统的逻辑处理器数量同时进行编译,以加快编译速度。

- TARGET=linux-glibc

- #指定目标平台为基于glibc的Linux系统。

- USE_OPENSSL=1

- #启用OpenSSL库支持,使得软件可以利用OpenSSL提供的加密和安全功能。

- USE_LUA=1

- #启用Lua脚本语言支持,允许在软件中编写和运行Lua脚本来扩展功能。

- USE_PCRE=1

- #启用PCRE(Perl Compatible Regular Expressions)库支持,提供强大的正则表达式处理能力。

- USE_SYSTEMD=1

- #启用Systemd支持,使软件能够更好地与Systemd初始化系统集成,例如注册systemd服务等。

- sudo make install

- #完成编译后,使用管理员权限执行此命令将编译好的软件安装到系统预设的安装路径下。

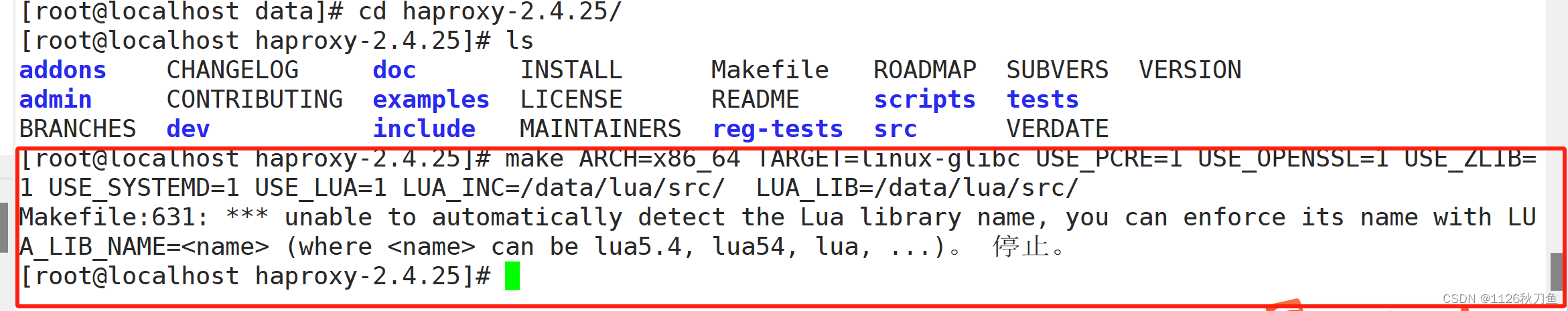

然后安装指定路径

make ARCH=x86_64 TARGET=linux-glibc USE_PCRE=1 USE_OPENSSL=1 USE_ZLIB=1 USE_SYSTEMD=1 USE_LUA=1 LUA_INC=/data/lua/src/ LUA_LIB=/data/lua/src/- make ARCH=x86_64

- #指定要构建的目标处理器架构为x86_64,即适用于64位Intel/AMD处理器的版本。

- TARGET=linux-glibc

- #设置目标平台为基于glibc的Linux系统,glibc是Linux系统中最常用的C语言标准库实现。

- USE_PCRE=1

- #启用PCRE支持,这将允许软件使用复杂的正则表达式进行匹配和处理。

- USE_OPENSSL=1

- #启用OpenSSL支持,提供加密算法、SSL/TLS协议等功能。

- USE_ZLIB=1

- #启用Zlib支持,用于数据压缩和解压缩功能。

- USE_SYSTEMD=1

- #启用Systemd支持

- USE_LUA=1

- #启用Lua脚本语言支持,允许在软件中编写和运行Lua脚本来扩展功能。

- LUA_INC=/usr/local/lua/src/

- #指定Lua头文件目录,编译时需要用到这些头文件来链接到Lua库。

- LUA_LIB=/usr/local/lua/src/

- #指定Lua库文件目录,编译时会链接到这个目录下的库文件以支持Lua功能

可以看见在haproxy安装路径出错,那就现在lua下面安装路径

在lua下面下载完环境包,再切换到haproxy下载环境包

如果是报错的情况下,就先切换到lua里面下载环境包

补充

如果还是报错,停止,可以如下操作:

mkdir /usr/local/lua

cp -r src/ /usr/local/lua/make ARCH=x86_64 TARGET=linux-glibc USE_PCRE=1 USE_OPENSSL=1 USE_ZLIB=1 USE_SYSTEMD=1 USE_LUA=1 LUA_INC=/usr/local/lua/src/ LUA_LIB=/usr/local/lua/src/

然后继续后需操作就可以了

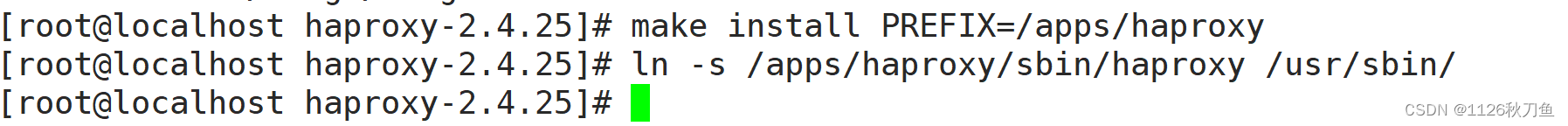

指明安装路径,做软连接,随后补全

随后,看一下版本 haproxy -v

交给systemd管理

- Description=HAProxy Load Balancer

- #这一行定义了服务的简要描述,说明该服务是用于提供负载均衡功能的HAProxy

- After=syslog.target network.target

- #表示此服务在syslog日志系统和网络服务完全启动之后开始启动。

- [Service] #服务部分包含了与服务运行相关的各种设置。

- ExecStartPre=/usr/sbin/haproxy -f /etc/haproxy/haproxy.cfg -c -q

- #指定服务启动前执行haproxy命令。表示启动HAProxy前检查配置文件/etc/haproxy/haproxy.cfg

- #是否有效,-c表示仅检查配置文件,-q表示静默模式,不输出多余信息。

- #该文件需要手动建立并配置信息。

- '具体信息在下一目录介绍'

- ExecStart=/usr/sbin/haproxy -Ws -f /etc/haproxy/haproxy.cfg -p /var/lib/haproxy/haproxy.pid

- #执行haproxy命令,并指定配置文件路径为 /etc/haproxy/haproxy.cfg,

- #-Ws:表示以守护进程模式运行并打开Unix套接字以便进行管理操作,

- #同时将PID写到/var/lib/haproxy/haproxy.pid 文件中。该文件也需要手动创建

- ExecReload=/bin/kill -USR2 $MAINPID

- #设置当服务收到reload信号时需要执行的操作,这里是发送USR2信号给主进程($MAINPID),

- #使得haproxy能够平滑重载配置文件而无需停止服务。

- LimitNOFILE=100000

- #服务的最大打开文件数量限制为100000

- [Install]

- #安装部分定义了如何将此服务与系统的启动目标关联

- WantedBy=multi-user.target

- #表明该服务应随多用户目标启动,即在系统进入多用户模式时自动启动haproxy服

因为没有配置文件跟目录,所以haproxy根本起不来

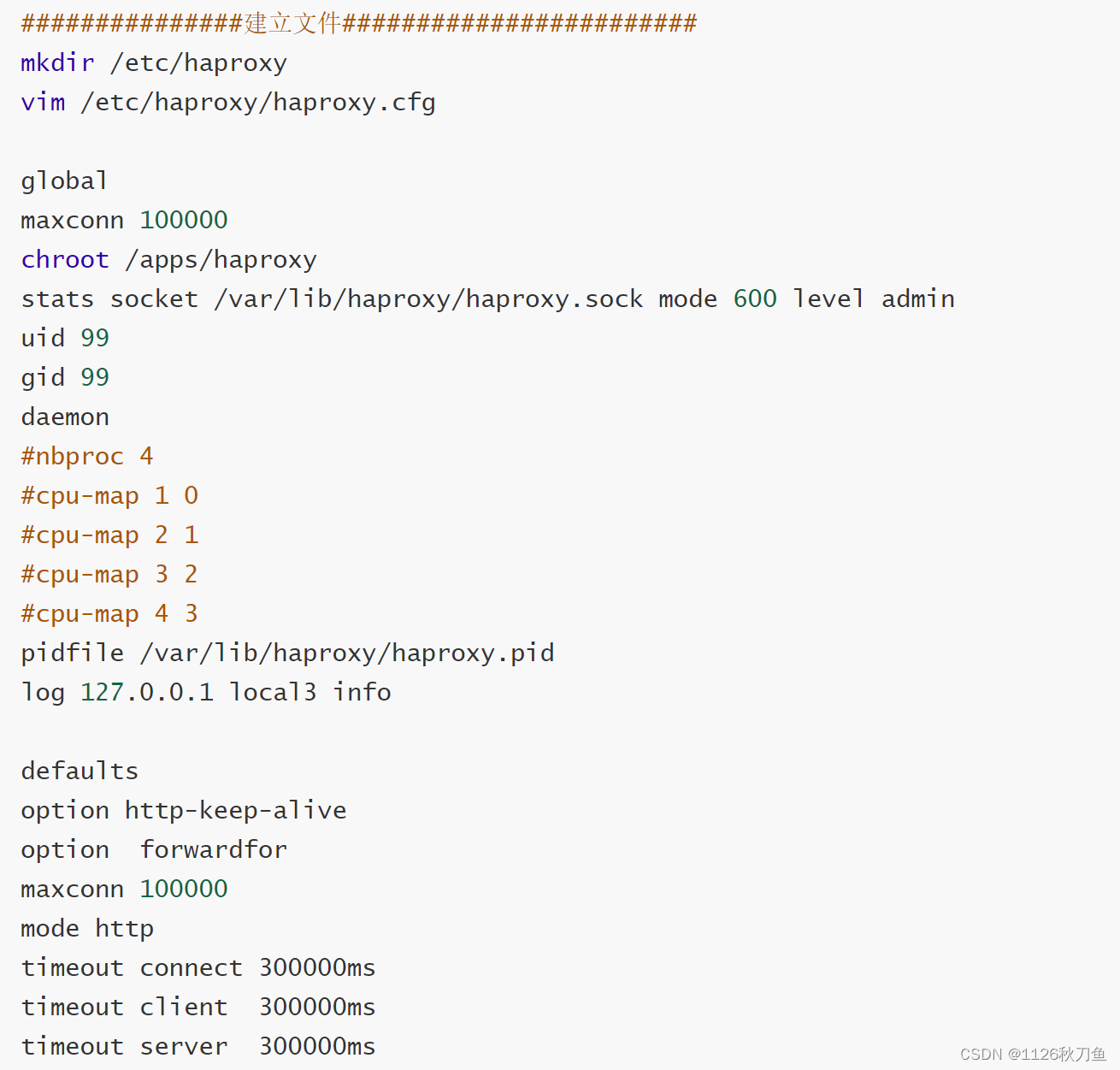

所以要去创建配置文件,创建检测目录/etc/haproxy

创建pid号存放目录,/var/lib/haproxy/启动服务后会自动生成haproxy.pid文件

建立检测文件,并配置服务相关信息最后开启haproxy进程

haproxy.cfg的配置文件内容

- global

- maxconn 100000

- chroot /apps/haproxy

- stats socket /var/lib/haproxy/haproxy.sock mode 600 level admin

- uid 99

- gid 99

- daemon

- #nbproc 4

- #cpu-map 1 0

- #cpu-map 2 1

- #cpu-map 3 2

- #cpu-map 4 3

- pidfile /var/lib/haproxy/haproxy.pid

- log 127.0.0.1 local3 info

- defaults

- option http-keep-alive

- option forwardfor

- maxconn 100000

- mode http

- timeout connect 300000ms

- timeout client 300000ms

- timeout server 300000ms

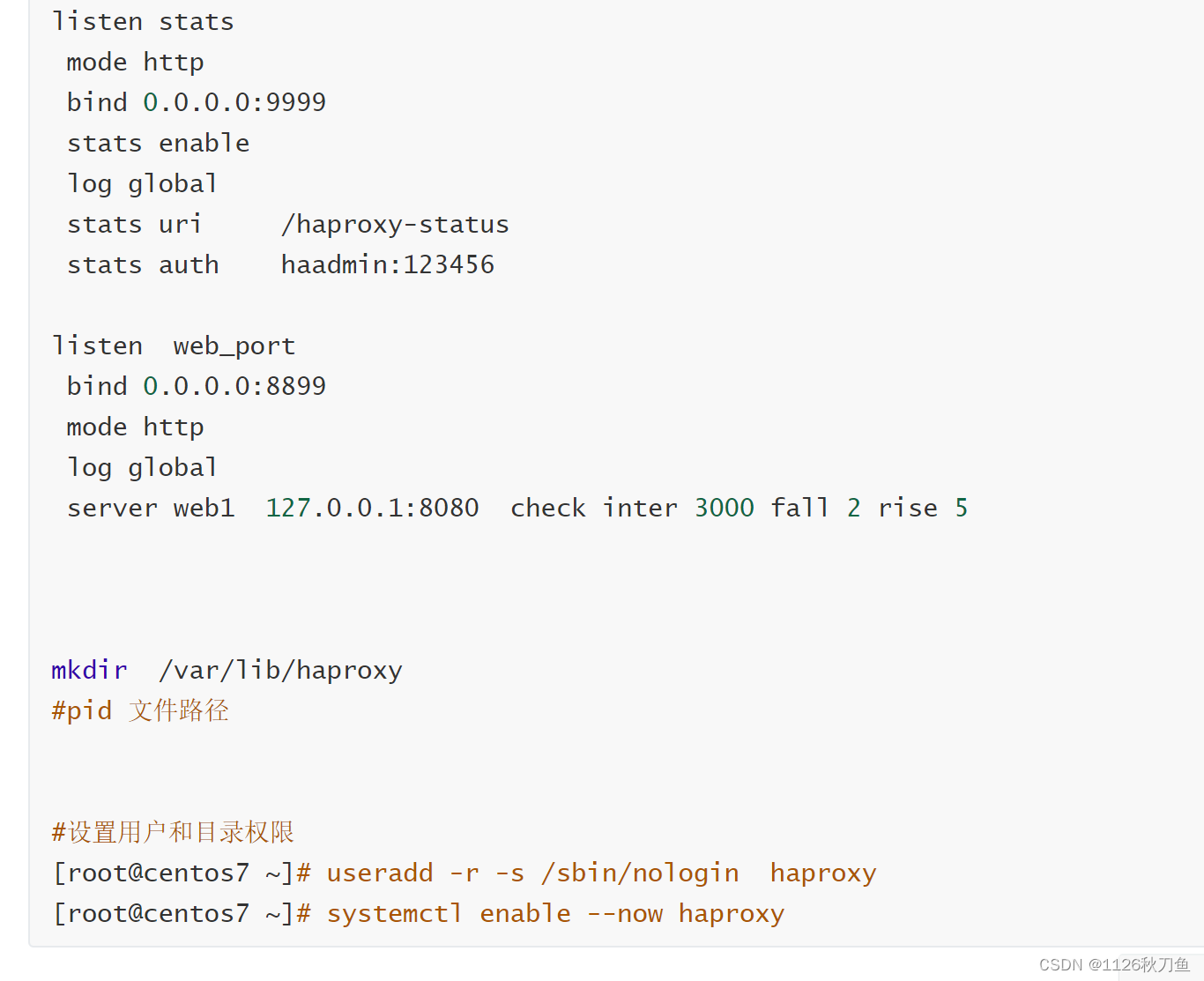

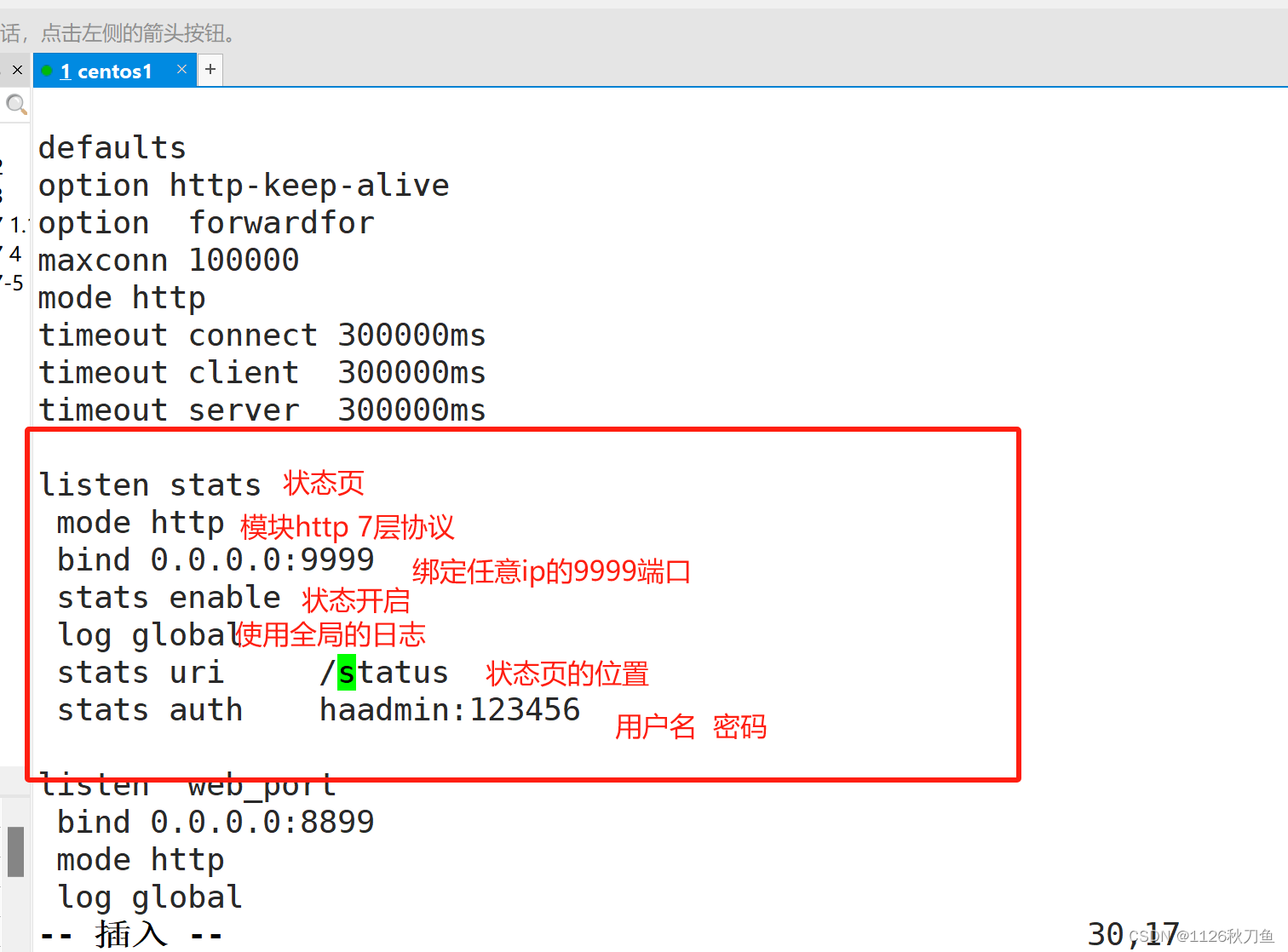

- listen stats

- mode http

- bind 0.0.0.0:9999

- stats enable

- log global

- stats uri /haproxy-status

- stats auth haadmin:123456

- listen web_port

- bind 0.0.0.0:8899

- mode http

- log global

- server web1 127.0.0.1:8080 check inter 3000 fall 2 rise 5

配置文件详解

官方地址配置文件官方帮助文档

http://cbonte.github.io/haproxy-dconv/

http://cbonte.github.io/haproxy-dconv/2.4/configuration.html

https://www.haproxy.org/download/2.5/doc/configuration.txtHAProxy 的配置文件haproxy.cfg由两大部分组成,分别是global和proxies部分

①global:全局配置段 进程及安全配置相关的参数、性能调整相关参数、Debug参数

②proxies:代理配置段

defaults:为frontend, backend, listen提供默认配置

frontend:前端,相当于nginx中的server {} 类似于虚拟机

backend:后端,相当于nginx中的upstream {} 类似于真机

listen:同时拥有前端和后端配置,配置简单,生产推荐使用global全局模块:

global

#全局配置

maxconn 100000

#最大连接数

chroot /apps/haproxy

#锁定运行目录,类似于ftp中的禁锢

stats socket /var/lib/haproxy/haproxy.sock mode 600 level admin

#Socket文件 进程间通信

uid 99

#运行haproxy用户身份

gid 99

#运行haproxy用户身份

daemon

#后台运行

#nbproc 4

#开启的haproxy work 进程数,默认进程数是一个

#nbthread 1 #和多进程 nbproc配置互斥(版本有关,CentOS8的haproxy1.8无此问题),指定每个haproxy进程开启的线程数,默认为每个进程一个线程

#如果同时启用nbproc和nbthread 会出现以下日志的错误,无法启动服务Apr 714:46:23 haproxy haproxy: [ALERT] 097/144623 (1454) : config : cannot enable multiple processes if multiple threads are configured. Please use either nbproc or nbthread but not both.

#cpu-map 1 0

#绑定haproxy worker 进程至指定CPU,将第1个work进程绑定至0号CPU

#cpu-map 2 1

##绑定haproxy worker 进程至指定CPU,将第2个work进程绑定至1号CPU

#cpu-map 3 2

#cpu-map 4 3

#CPU的亲缘性 绑定cpu 可以通过ps axo pid,cmd,psr,pid |grep haproxy查看cpu亲缘性状态

#maxsslconn n

#每个haproxy进程ssl最大连接数,用于haproxy配置了证书的场景下

#maxconnrate n

#每个进程每秒创建的最大连接数量

#spread-checks n

#后端server状态check随机提前或延迟百分比时间,建议2-5(20%-50%)之间,默认值0

pidfile /var/lib/haproxy/haproxy.pid

#pid运行路径

log 127.0.0.1 local3 info

#日志级别进程跟多线程有冲突:

原始可以pstree看一下haproxy的进程与线程,服务启动以后,可以看到默认开启一个主进程,带一个工作进程以及三个线程

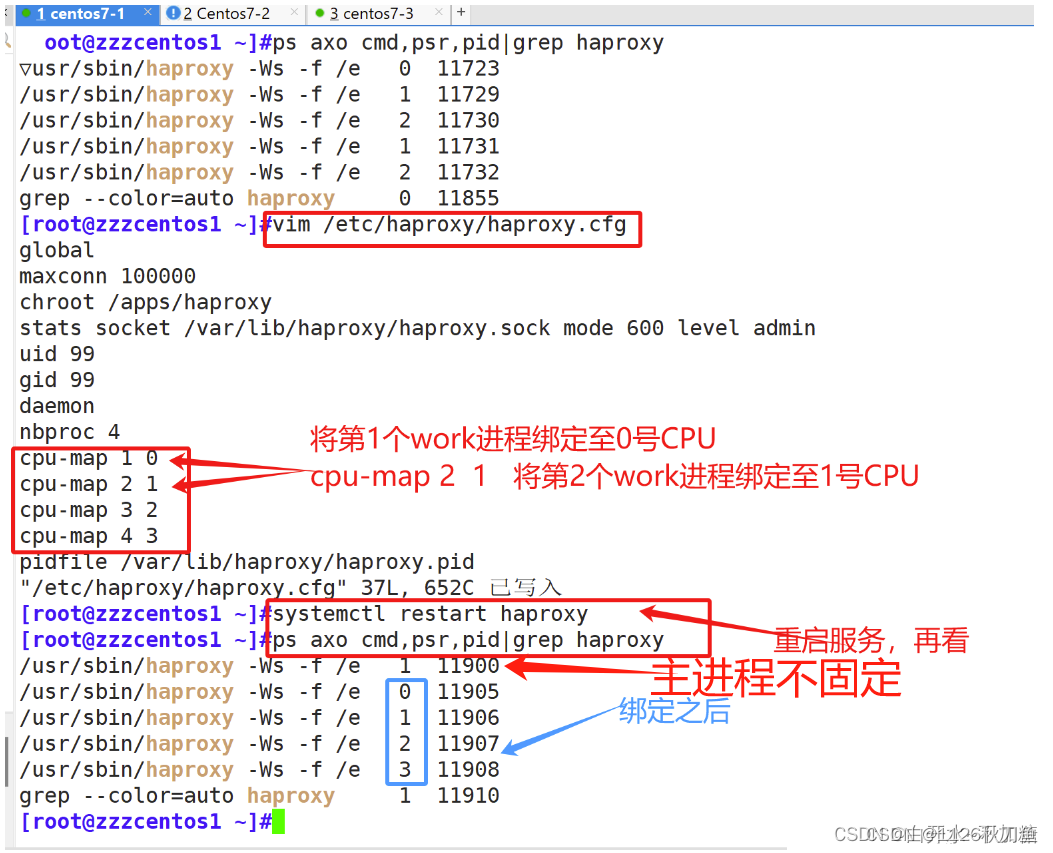

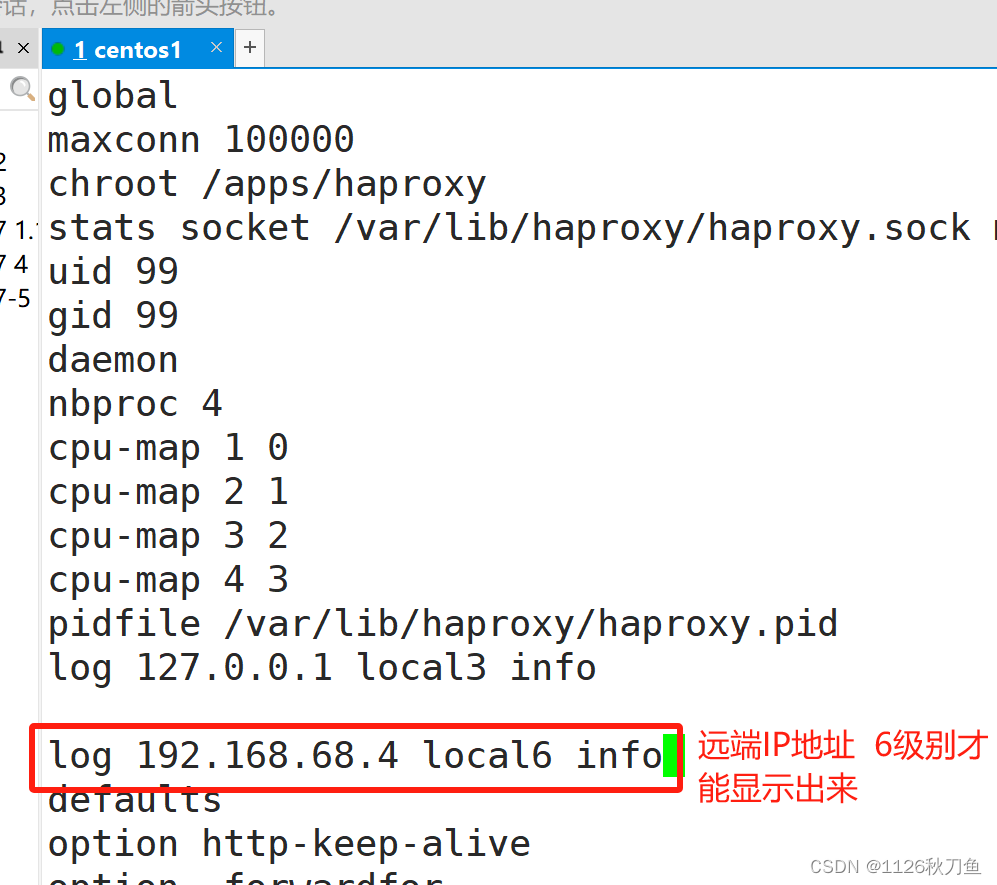

可以根据cpu个数来决定开机时启动的work进程数量:在全局配置中添加nbproc参数

服务启动以后,可以看到默认开启一个主进程,带一个工作进程以及三个线程

自定义,指定进程与线程的个数,原本默认1个,现在我们把进程改为4个

然后重启haproxy的服务,查看pstree

此时,只有4个进程,而线程没有了

此时,只有4个进程,而线程没有了cpu的亲缘性

CPU亲缘性(CPU Affinity)是指将进程或线程绑定到特定的CPU核心上运行的技术。通过设置CPU亲缘性,可以避免进程在不同核心之间频繁迁移,从而减少缓存失效,提高系统的整体性能和效率

- cpu-map 1 0 #绑定haproxy worker 进程至指定CPU,将第1个work进程绑定至0号CPU

- cpu-map 2 1 #绑定haproxy worker 进程至指定CPU,将第2个work进程绑定至1 号CPU

-

cpu-map 1 0 将第一个进程绑定在第一个cpu -

cpu-map 2 1 第二个进程绑定在第二个cpu -

cpu-map 3 2 第三个进程绑定在第三个cpu -

cpu-map 4 3 第四个cpu绑定在第四个cpu

没修改之前,是没有固定绑在哪个cpu上面的

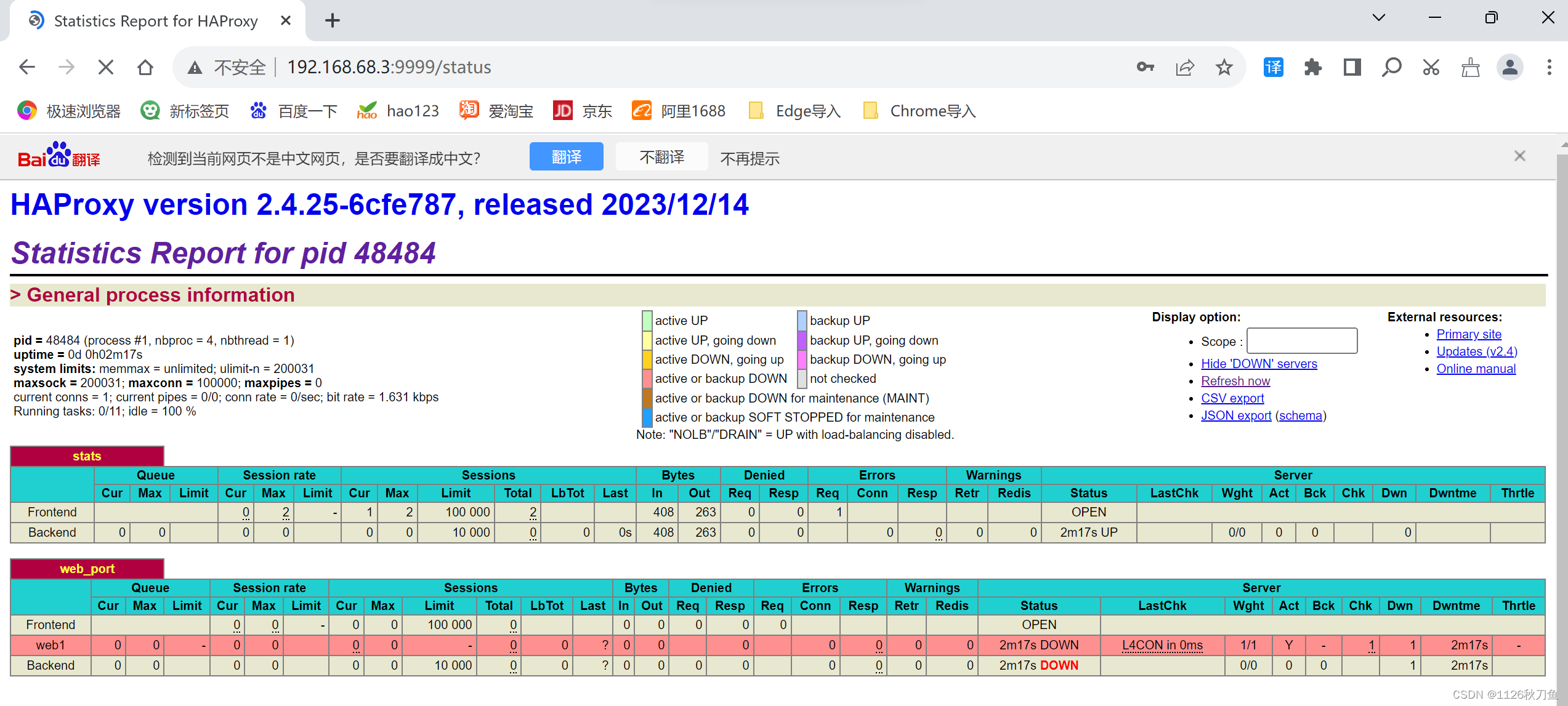

状态页

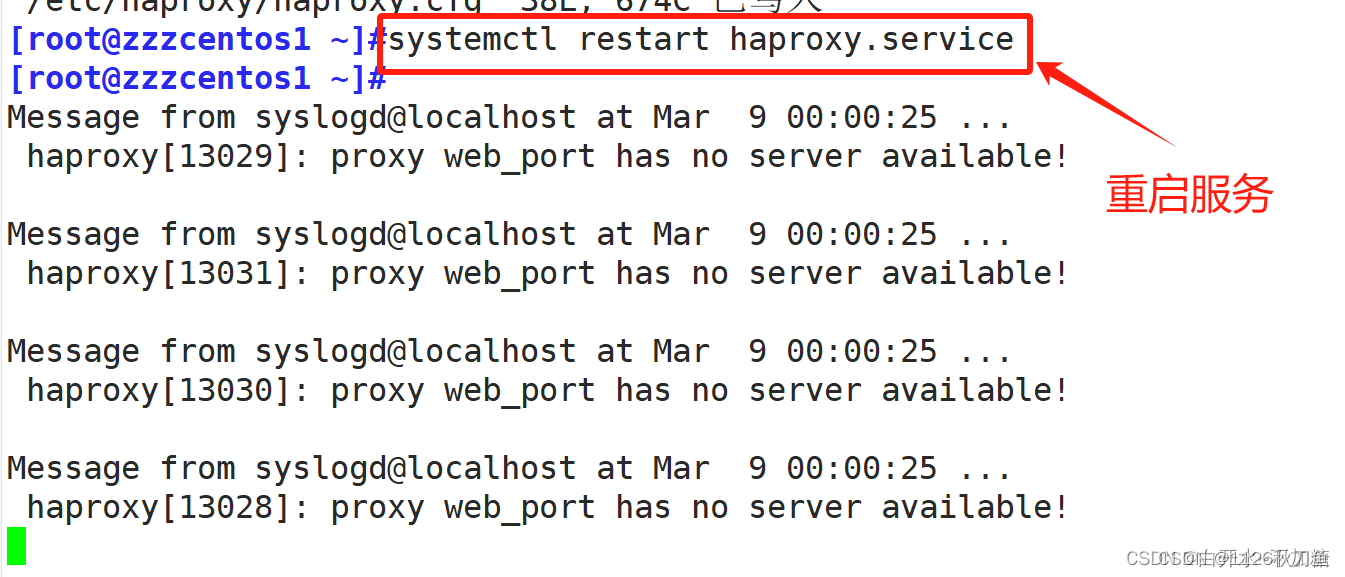

重启 systemctl restart haproxy,因为状态页的位置修改过,随后用网页访问

可以看到状态页

多进程和多线程(同时开启会报错)

日志

HAproxy本身不记录客户端的访问日志,haproxy服务没有单独的日志管理文件,它的默认日志文件位置在/var/log/messages,此外为减少服务器负载,一般生产中HAProxy不记录日志.也可以配置HAProxy利用rsyslog服务记录日志到指定日志文件中。

haproxy原本的日志在/var/log/message

第一步,修改日志的配置文件

解释:

$ModLoad imudp: 这是在rsyslog配置文件中加载UDP模块的命令。imudp表示输入模块(Input Module)用于处理UDP协议的数据。通过此命令,系统将能够监听并接收通过UDP端口发送过来的日志消息。

$UDPServerRun 514: 这个指令告诉rsyslog服务在指定的UDP端口(这里为514)上启动一个UDP服务器以监听日志事件。默认情况下,许多网络设备和服务会使用514端口通过UDP协议发送syslog日志信息给日志收集服务器

然后自定义haproxy的日志位置

随后,退出保存,重启

检测一下

一般情况下,不建议把日志放在本端,而是放在远端

把haproxy日志放在远端服务器

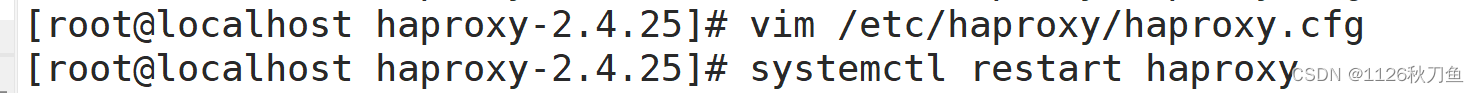

第一步:现在本机haproxy的配置文件中修改

远端服务器设置(192.168.68.4)

去修改日志的配置文件

把udp里面的注释删除,然后添加级别6的路径

然后再去浏览页访问,随后查看日志

然后再去浏览页访问,随后查看日志

proxies配置

proxies配置- defaults [<name>] #默认配置项,针对以下的frontend、backend和listen生效,可以多个name也可以没有name

- frontend <name> #前端servername,类似于Nginx的一个虚拟主机 server和LVS服务集群。

- backend <name> #后端服务器组,等于nginx的upstream和LVS中的RS服务器

- listen <name> #将frontend和backend合并在一起配置,相对于frontend和backend配置更简洁,生产常用

注意:name字段只能使用大小写字母,数字,‘-’(dash),'_‘(underscore),'.' (dot)和 ':'(colon),并且严格区分大小

Proxies配置-defaults

- option redispatch #当server Id对应的服务器挂掉后,强制定向到其他健康的服务器,重新派发

- option abortonclose #当服务器负载很高时,自动结束掉当前队列处理比较久的连接,针对业务情况选择开启

- option http-keep-alive #开启与客户端的会话保持

- option forwardfor #透传客户端真实IP至后端web服务器

- mode http|tcp #设置默认工作类型,使用TCP服务器性能更好,减少压力

- timeout http-keep-alive 120s #session 会话保持超时时间,此时间段内会转发到相同的后端服务器

- timeout connect 120s #客户端请求从haproxy到后端server最长连接等待时间(TCP连接之前),默认单位ms

- timeout server 600s #客户端请求从haproxy到后端服务端的请求处理超时时长(TCP连接之后),默认单位ms,如果超时,会出现502错误,此值建议设置较大些,访止502错误

- timeout client 600s #设置haproxy与客户端的最长非活动时间,默认单位ms,建议和timeout server相同

- timeout check 5s #对后端服务器的默认检测超时时间

- default-server inter 1000 weight 3 #指定后端服务器的默认设置

Proxies配置-listen 简化配置

使用listen替换 frontend和backend的配置方式,可以简化设置,通常只用于TCP协议的应用

#官网业务访问入口

listen WEB_PORT_80 #业务名称

bind 10.0.0.7:80 #ip加端口

mode http #默认 可以不写

option forwardfor #透传客户端真实IP至后端web服务器

server web1 10.0.0.17:8080 check inter 3000 fall 3 rise 5

server web2 10.0.0.27:8080 check inter 3000 fall 3 rise 5Proxies配置-frontend

定义一组后端服务器,backend服务器将被frontend进行调用。

注意: backend 的名称必须唯一,并且必须在listen或frontend中事先定义才可以使用,否则服务无法启动

mode http|tcp #指定负载协议类型,和对应的frontend必须一致

option #配置选项

server #定义后端real server,必须指定IP和端口server 配置

- #针对一个server配置

- check #对指定real进行健康状态检查,如果不加此设置,默认不开启检查,只有check后面没

- 有其它配置也可以启用检查功能

- #默认对相应的后端服务器IP和端口,利用TCP连接进行周期性健康性检查,注意必须指定

- 端口才能实现健康性检查

- addr <IP> #可指定的健康状态监测IP,可以是专门的数据网段,减少业务网络的流量

- port <num> #指定的健康状态监测端口

- inter <num> #健康状态检查间隔时间,默认2000 ms

- fall <num> #后端服务器从线上转为线下的检查的连续失效次数,默认为3

- rise <num> #后端服务器从下线恢复上线的检查的连续有效次数,默认为2

- weight <weight> #默认为1,最大值为256,0(状态为蓝色)表示不参与负载均衡,但仍接受持久连

- 接

- backup #将后端服务器标记为备份状态,只在所有非备份主机down机时提供服务,类似

- Sorry Server

- disabled #将后端服务器标记为不可用状态,即维护状态,除了持久模式,将不再接受连接,

- 状态为深黄色,优雅下线,不再接受新用户的请求

- redirect prefix http://www.baidu.com/ #将请求临时(302)重定向至其它URL,只适用于

- http模式

- redir http://www.baidu.com #将请求临时(302)重定向至其它URL,只适用于

- http模式

- maxconn <maxconn> #当前后端server的最大并发连接数

实验:haproxy

Centos7-1作为haproxy服务器;

Centos7-2作为提供Web服务器的后端真实服务器1

Centos7-3作为提供Web服务的后端真实服务器2

Centos7-4作为客户端

7-1proxy服务器配置

随后,重启

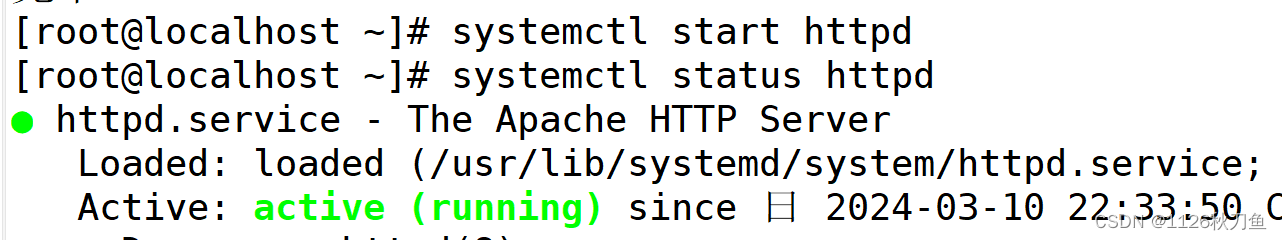

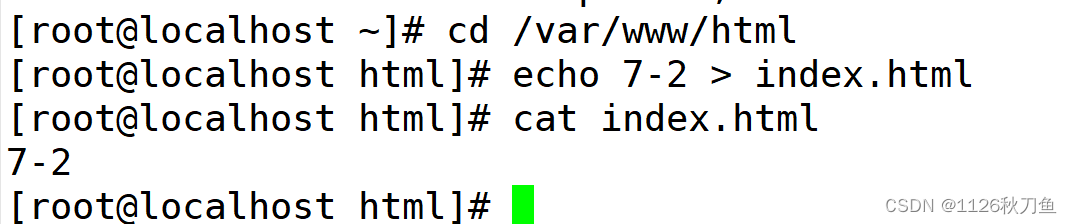

7-2真是服务器配置

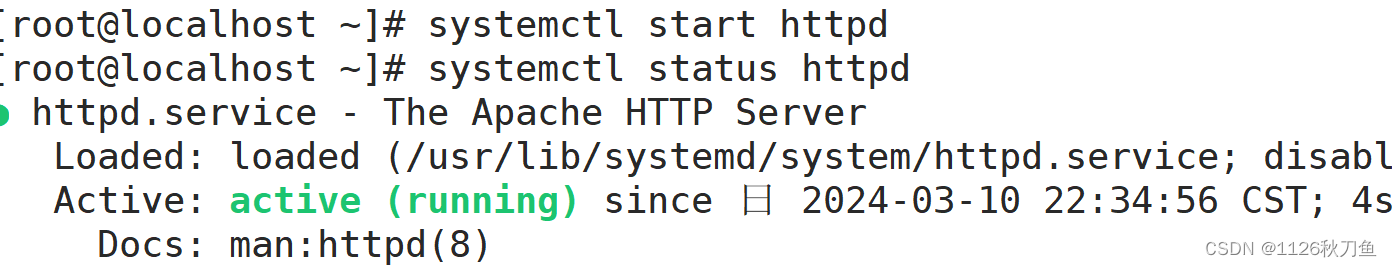

7-3真实服务器配置

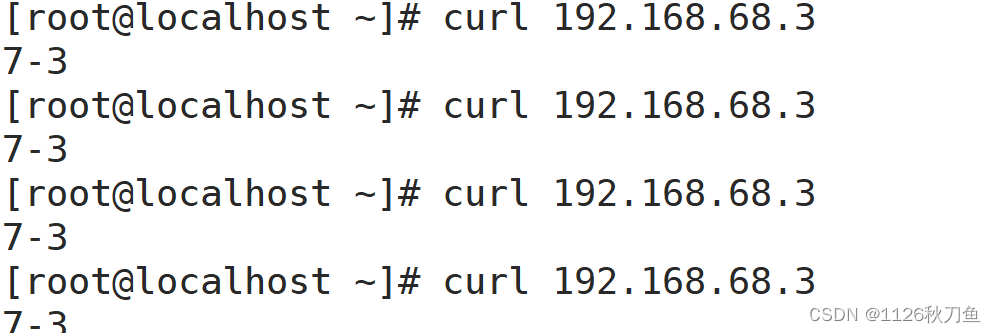

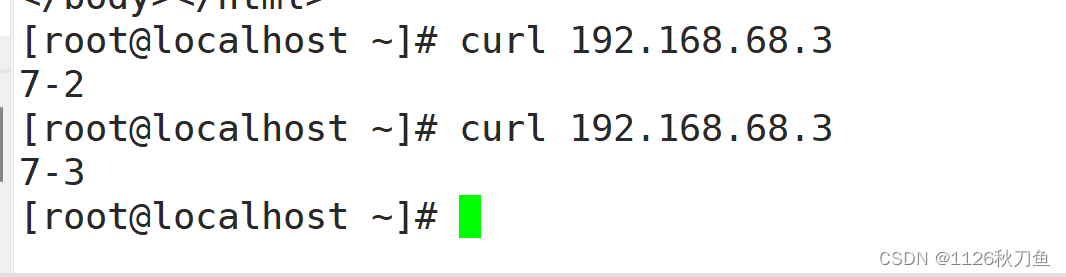

随后,在客户端访问haproxy调度器

开启健康性检测

先关闭centos2 真是服务器

随后,去客户端访问,可以看出没有后端性检查

添加后端性检测,在haproxy调度器上添加check 添加端口号

添加后端性检测,在haproxy调度器上添加check 添加端口号

随后,再去客户机访问,此时就有后端性检查的功能了,不去7-2故障机上了

原理:通过抓包看到实际上是haproxy三次握手没有成功,来进行的健康检查

实验2 前后端写法

随后,再去客户服务端访问

-

-

相关阅读:

设计模式学习(二十四):Spring 中使用到的设计模式

计算机保研-上岸华中科技大学(武汉光电国家研究中心)

李宏毅2022机器学习HW4 Speaker Identification上(Dataset &Self-Attention)

java毕业设计家政管理系统(附源码、数据库)

一款免费无广、简单易用的安全软件:火绒安全软件

【计算机视觉 | 目标检测】目标检测常用数据集及其介绍(十二)

【Python机器学习】零基础掌握LinearDiscriminantAnalysis判别分析

【乳腺癌诊断】基于聚类和遗传模糊算法乳腺癌(诊断)分析(Matlab代码实现)

Bootloader概述和Uboot

【Matlab 六自由度机器人】Fixed Angles(固定角度) 和 Euler Angles(欧拉角) 之间的区别

- 原文地址:https://blog.csdn.net/2301_81307988/article/details/136593041