-

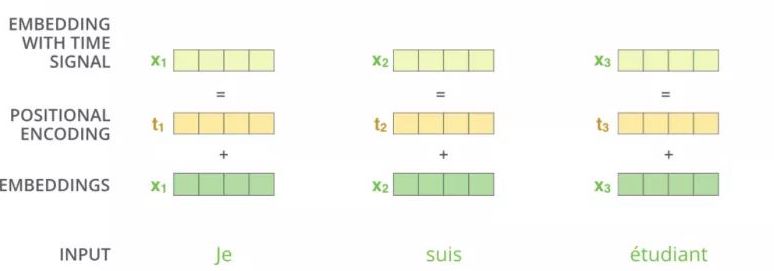

1401 位置编码公式详细理解补充

-

相关阅读:

CSS核心知识点

Harris/Shi-Tomasi角点检测

算法----删掉一个元素以后全为 1 的最长子数组

DTSE Tech Talk | 第9期:EiPaaS驱动企业数字化转型

vue3动态引入图片(:src)

精华回顾:Web3 前沿创新者在 DESTINATION MOON 共话未来

电脑监控软件内网版和外网版哪个好?

Httpd(一)

linux部署jar包脚本和注册开机启动

LeetCode中等题之二叉树的层序遍历

- 原文地址:https://blog.csdn.net/linjie_830914/article/details/134047291