-

【数之道 05】走进神经网络模型、机器学习的世界

神经网络(ANN)

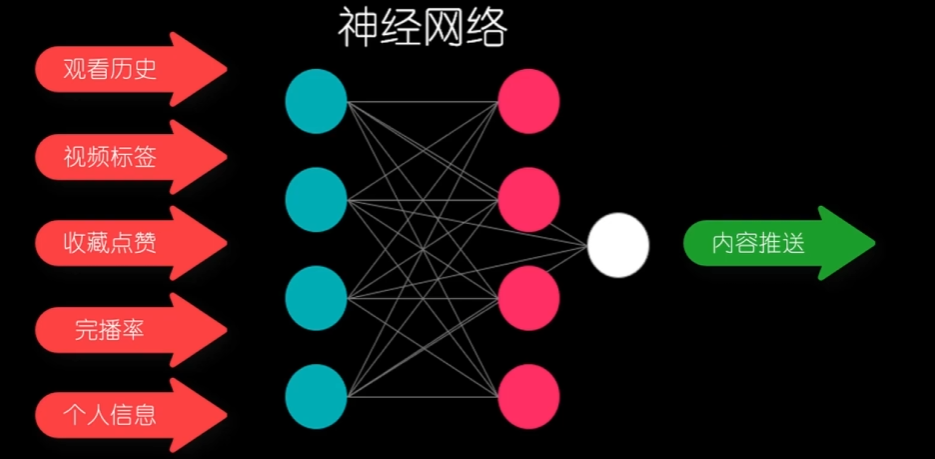

最简单的例子,视频的推送,就是神经网络作用的结果

神经网络基础

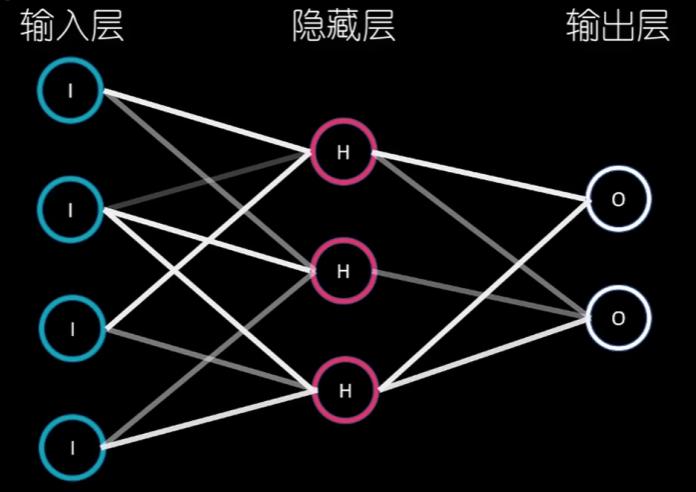

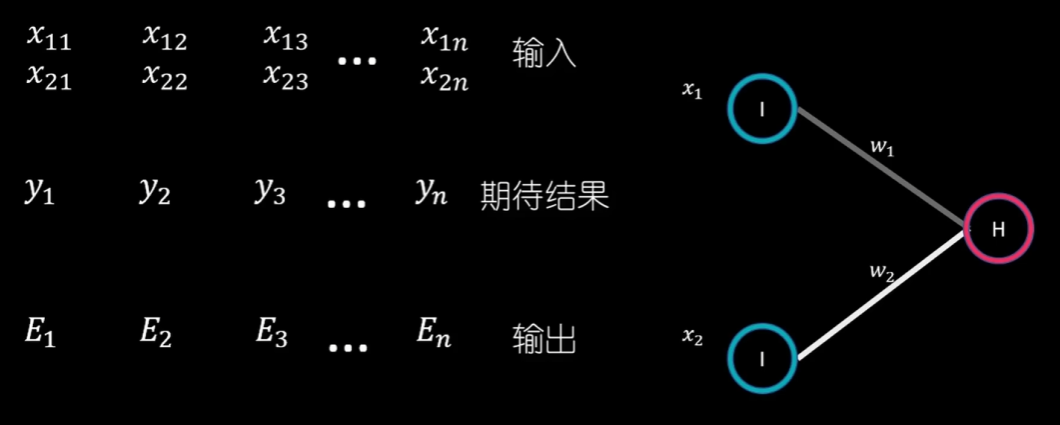

人造神经元是整个网络系统的最小单位,不同神经元按照权重不同连接

输入层:起到传递数据的作用

隐藏层:部分神经元被激活,这里涉及到激活函数,根据相应权重流入输出层

输出层:神经元根据激活函数产生最终的输出值

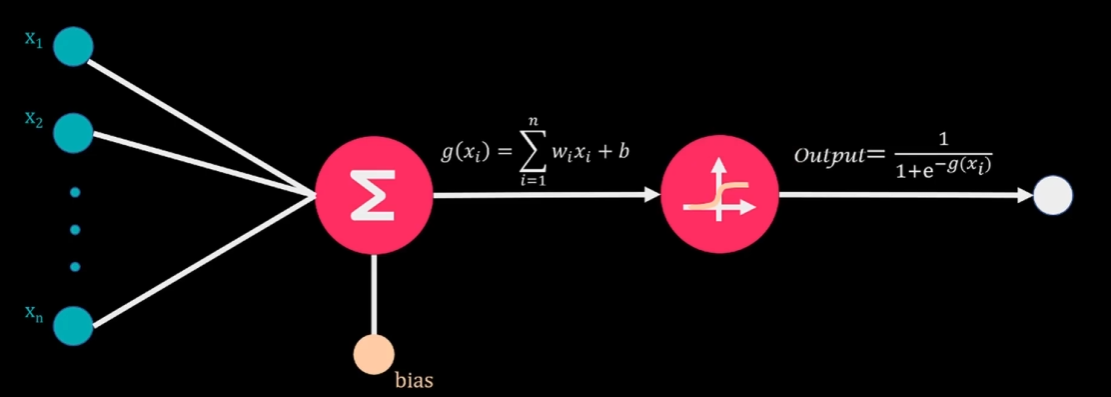

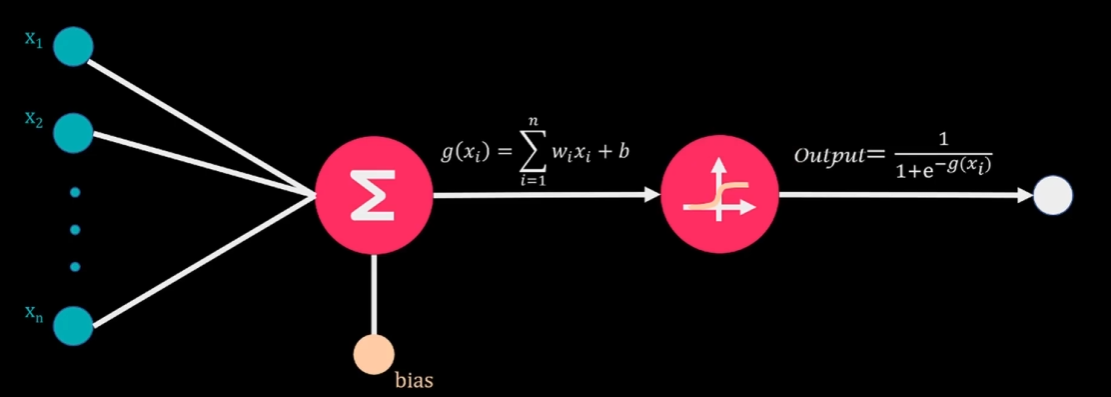

激活函数

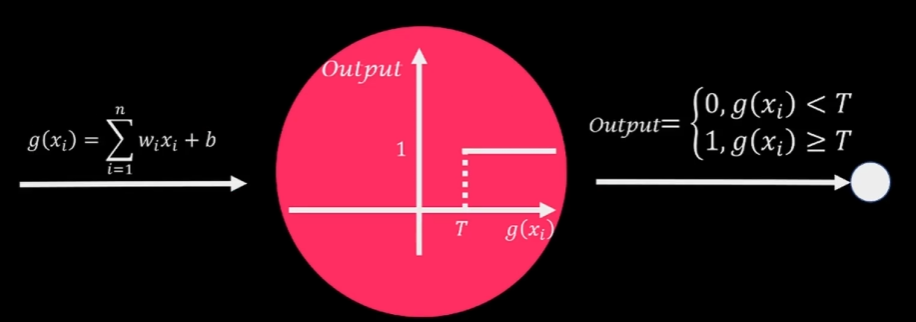

拿其中一个神经元来说,信号强度是由之前的加权和决定,激活函数将输入信号转换成该神经元的输出值

这里如果激活函数为分段函数,输出值会产生突变 0突变为1

为了平滑神经元输出值,选择不同的激活函数神经网络如何通过训练提高预测准确度

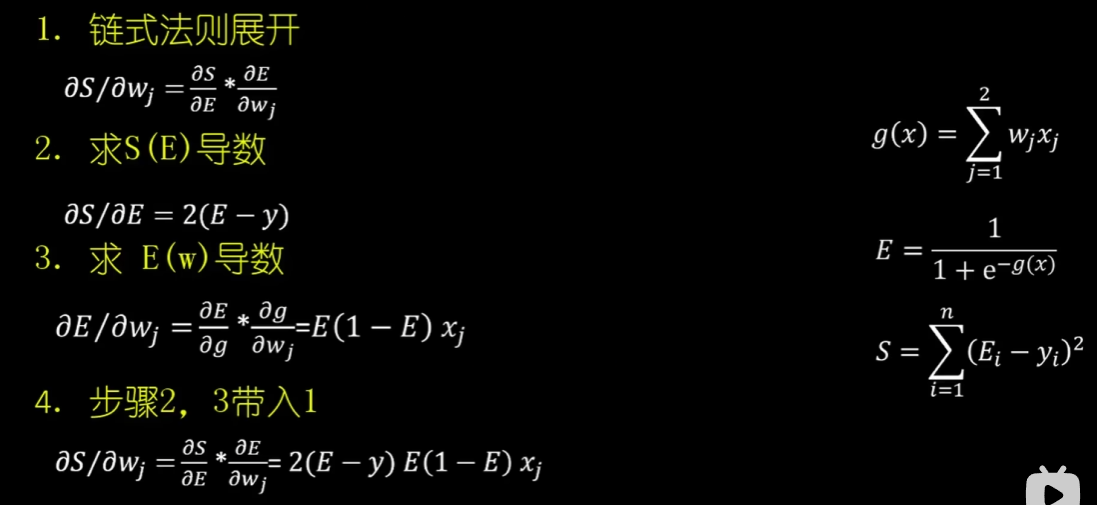

逆向参数调整法 (BackPropagation)

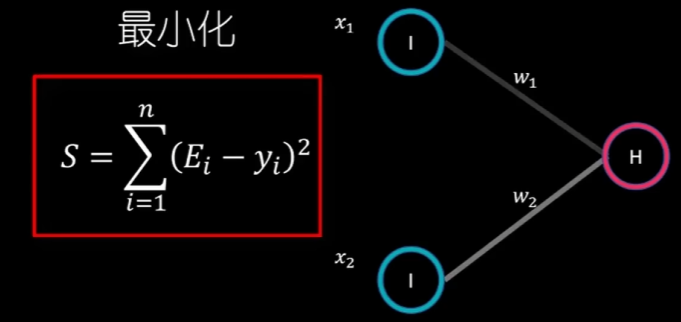

训练的结果是不断调整w1,w2,让Y,E集合的误差平方和最小

具体调整过程中需要借助- 梯度下降法

- 链式法则

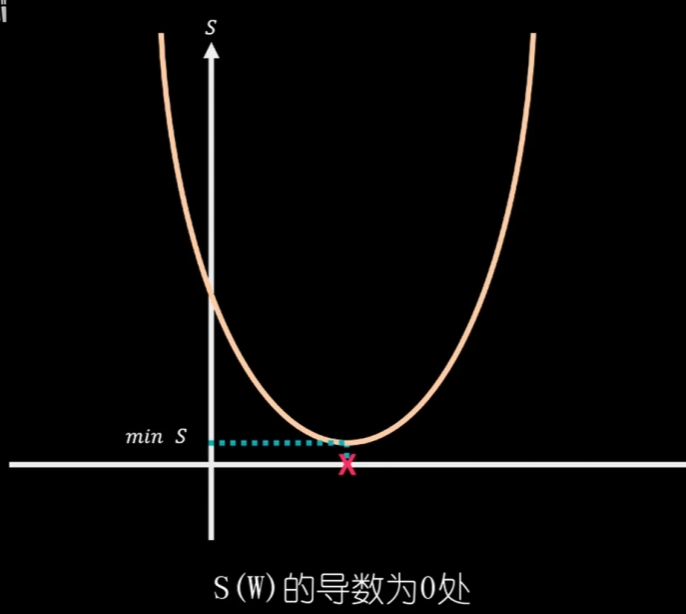

梯度下降法

核心:

为了求得误差平方和的最小值,将w从初始值逐渐移动到s(w)导数为0处

每次移动的幅度由s,w的导数和学习系数常数值eta决定

这里导数为正时,步幅为负

这里学习系数太小了学习速度慢,太大了可能会跳过极值点

链式法则

这里对s,w的求导过程中需要使用链式法则

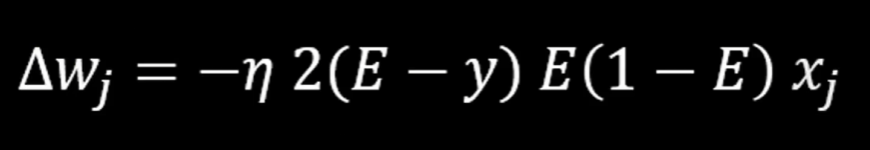

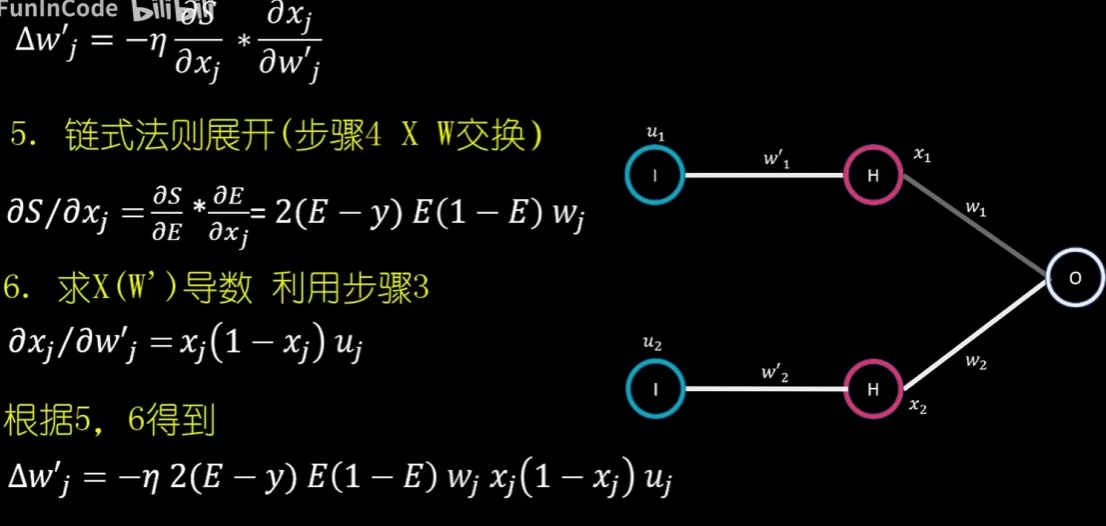

增加一层

依然可以套用之前的结果

-

相关阅读:

我的创作纪念日--码农阿豪

r3live 使用前提 雷达-相机外参标定 livox_camera_lidar_calibration

【Python数据库】MongoDB

记一次艰难的上班历程

vue中ref的用法

如何避免由 Web 字体引起的布局偏移

16 拉格朗日定理和函数的单调性

CTO(技术总监)平时都在做些什么?

CISA 彻底改变了恶意软件信息共享:网络安全的突破

kubernetes(k8s)PVC

- 原文地址:https://blog.csdn.net/weixin_46050242/article/details/133907375