-

LLM基础

LLM:

AGI 通用人工智能

计算不可约性原理

监督微调、奖励建模

饶毅关于gpt https://mp.weixin.qq.com/s/Govj_KD_afL_nK9T16nE0w

gpt2 windows :https://matters.town/@tianci/63096-%E6%95%99%E4%BD%A0%E5%A6%82%E4%BD%95%E5%9C%A8%E8%87%AA%E5%B7%B1%E7%9A%84%E7%94%B5%E8%84%91%E4%B8%8A%E8%BF%90%E8%A1%8C%E4%BD%BF%E7%94%A8gpt-2-2020-07-bafyreihimyaazpasxf6m5nb2f52pkvvv7rkz3eb6uoze4u42kka7qd7a4e

this is chat gpt

https://writings.stephenwolfram.com/2023/02/what-is-chatgpt-doing-and-why-does-it-work/#its-just-adding-one-word-at-a-time

1 adding one word each time

(1) ask for the following word

chatGPT is always asking given the text,whats the next word(token which could be part of word )

chatgpt 在做的是对文本合理的延续, 合理指的是 全网数据学习后,要能知道接下来应该是什么字词,

eg: The best thing about AI is its ability to …

chatgpt looks for meaningful things, and generate a ranked list of words that might follow, together with “probabilities”:

(2)随机选词

randomly choose a word in ranked list ,instead of the word with highest posibility;if gpt choose the best one everytime then it lose the creativity and generate massive repeated content

randomness means the same prompt produces different result

(3) “language model” neural net:

Image

i generate next word with probability

ii randomly choose a word for producing different result

2 Where Do the Probabilities Come From?

calculate how often every letter in a content text

Prompt:

1.要素: 指令、上下文、输入数据(用户问题)、输出指示(说明输出格式)

eg:

指令:提取文本中的公司输入:虽然这些发展对研究人员来说是令人鼓舞的,但仍有许多谜团百度的神经免疫学家Henrique Veiga-Fernandes说:“我们经常在大脑和我们在周围看到的效果之间有一个黑匣子。”“如果我们想在治疗背景下使用它,我们实际上需要了解机制,但是京东的同道不这么认为 输出格式: 地点: 逗号分割的公司名称 示例:新东方,支付宝 提示词示例: 指令: 判断输入问题所属的意图是哪一类,意图只能从上下文给定的分类中选择,如果未命中业务意图,则返回default意图 输入:我想查询下我的商品现在被快递在了哪里? 上下文:所有意图分类: goods_recommand,order_query,express_query,default 输出标准json格式:{"question":用户输入的问题,"intention":输入问题所属的意图} 角色prompt User 背景:你是个大学物理老师,现在正在进行大学物理知识科普,你面向的对象是大学物理专业学生,你的语言应该非常专业,严谨 指令:请根据用户输入的问题,进行解释 学生:您好,请问四维空间是什么样子的- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

2.提示是不断迭代的,最好版本控制

tips:

避免不精确: 提示词越具体、直接、简洁越好

尽量说做,而非不做

提示技术

0样本提示

少量样本提示:示例:"This is awesome!" - Positive "This is bad!" - Negative "Wow, that movie was rad!" - Positive 指令:参考示例直接给出输入句子的标签,不需要多说其他 输入:What a horrible show!- 1

- 2

- 3

- 4

- 5

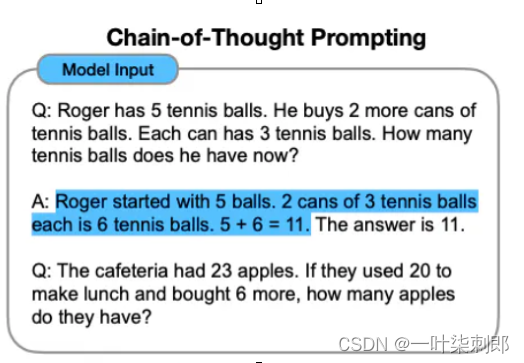

链式思考prompt

Prompt chaining

将任务拆成子任务,上一个任务的response可以作为下一步的prompt,如果任务比较复杂

https://docs.anthropic.com/claude/docs/prompt-chaining#response-validation–extra-diligence

解释某个概念时 可先得出大纲,第二部再expand 大纲

tips: 一般最好能够将提示和内容用标签分割: 如 -

相关阅读:

Debian利用现有软件包或者光盘镜像搭建本地软件源

Oracle SQL执行计划操作(6)——并行相关操作

实战计算机网络02——物理层

【Luogu】 P5642 人造情感(emotion)

数据库MySQL(二):DDL数据定义语言

flex布局(弹性盒子三)

java.sql.SQLException: Value ‘xxx‘ can not be represented as java.sql.Timestamp

数说故事香氛品类分析及行业新趋势、消费者需求洞察

Java版本+企业电子招投标系统源代码+支持二开+招投标系统+中小型企业采购供应商招投标平台

Stable Diffusion WebUI使用AnimateDiff插件生成动画

- 原文地址:https://blog.csdn.net/weixin_42410730/article/details/133278823