-

K8S-存储卷,pv,pvc

pv,pvc

一、emptyDir存储卷

1.概述

当Pod被分配给节点时,首先创建emptyDir卷,并且只要该Pod在该节点上运行,该卷就会存在。正如卷的名字所述,它最初是空的。Pod 中的容器可以读取和写入emptyDir卷中的相同文件,尽管该卷可以挂载到每个容器中的相同或不同路径上。当出于任何原因从节点中删除 Pod 时,emptyDir中的数据将被永久删除。

2.示例

mkdir /opt/volumes cd /opt/volumes vim pod-emptydir.yaml apiVersion: v1 kind: Pod metadata: name: pod-emptydir namespace: default labels: app: myapp tier: frontend spec: containers: - name: myapp image: ikubernetes/myapp:v1 imagePullPolicy: IfNotPresent ports: - name: http containerPort: 80 #定义容器挂载内容 volumeMounts: #使用的存储卷名称,如果跟下面volume字段name值相同,则表示使用volume的这个存储卷 - name: html #挂载至容器中哪个目录 mountPath: /usr/share/nginx/html/ - name: busybox image: busybox:latest imagePullPolicy: IfNotPresent volumeMounts: - name: html #在容器内定义挂载存储名称和挂载路径 mountPath: /data/ command: ['/bin/sh','-c','while true;do echo $(date) >> /data/index.html;sleep 2;done'] #定义存储卷 volumes: #定义存储卷名称 - name: html #定义存储卷类型 emptyDir: {} kubectl apply -f pod-emptydir.yaml kubectl get pods -o wide NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES pod-emptydir 2/2 Running 0 36s 10.244.2.18 node02- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

- 20

- 21

- 22

- 23

- 24

- 25

- 26

- 27

- 28

- 29

- 30

- 31

- 32

- 33

- 34

- 35

- 36

- 37

- 38

- 39

- 40

- 41

- 42

- 43

- 44

- 45

- 46

- 47

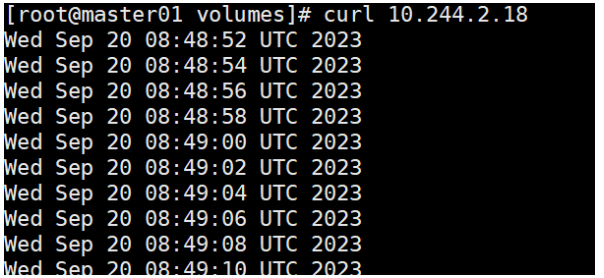

(1)在上面定义了2个容器,其中一个容器是输入日期到index.html中,然后验证访问nginx的html是否可以获取日期。以验证两个容器之间挂载的emptyDir实现共享。

curl 10.244.2.18- 1

二、hostPath存储卷

1.概述

hostPath卷将 node 节点的文件系统中的文件或目录挂载到集群中。

hostPath可以实现持久存储,但是在node节点故障时,也会导致数据的丢失。(1)在 node01 节点上创建挂载目录

mkdir -p /data/pod/volume1 echo 'node01.exo.com' > /data/pod/volume1/index.html- 1

- 2

(2)在 node02 节点上创建挂载目录

mkdir -p /data/pod/volume1 echo 'node02.exo.com' > /data/pod/volume1/index.html- 1

- 2

(3)创建 Pod 资源

vim pod-hostpath.yaml apiVersion: v1 kind: Pod metadata: name: pod-hostpath namespace: default spec: containers: - name: myapp image: ikubernetes/myapp:v1 #定义容器挂载内容 volumeMounts: #使用的存储卷名称,如果跟下面volume字段name值相同,则表示使用volume的这个存储卷 - name: html #挂载至容器中哪个目录 mountPath: /usr/share/nginx/html #读写挂载方式,默认为读写模式false readOnly: false #volumes字段定义了paues容器关联的宿主机或分布式文件系统存储卷 volumes: #存储卷名称 - name: html #路径,为宿主机存储路径 hostPath: #在宿主机上目录的路径 path: /data/pod/volume1 #定义类型,这表示如果宿主机没有此目录则会自动创建 type: DirectoryOrCreate kubectl apply -f pod-hostpath.yaml- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

- 20

- 21

- 22

- 23

- 24

- 25

- 26

- 27

- 28

- 29

- 30

- 31

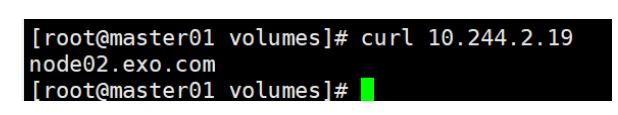

(4)访问测试

kubectl get pods -o wide NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES pod-hostpath 2/2 Running 0 37s 10.244.2.19 node02curl 10.244.2.19 node02.exo.com - 1

- 2

- 3

- 4

- 5

- 6

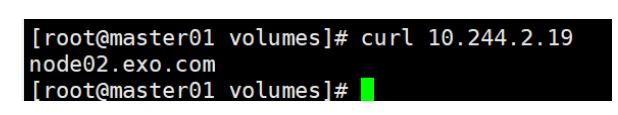

(5)删除pod,再重建,验证是否依旧可以访问原来的内容

kubectl delete -f pod-hostpath.yaml kubectl apply -f pod-hostpath.yaml kubectl get pods -o wide NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES pod-hostpath 2/2 Running 0 36s 10.244.2.20 node02curl 10.244.2.20 node02.exo.com - 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

三、nfs共享存储卷

1.在stor01节点上安装nfs,并配置nfs服务

rpm -q nfs-utils rpcbind yum -y install nfs-utils rpcbind mkdir /data/volumes -p chmod 777 /data/volumes vim /etc/hosts #做主机映射(所有节点) 192.168.174.16 stor01 vim /etc/exports /data/volumes 192.168.174.0/24(rw,no_root_squash) systemctl start rpcbind systemctl start nfs showmount -e Export list for stor01: /data/volumes 192.168.174.0/24- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

2.master节点操作

vim pod-nfs-vol.yaml apiVersion: v1 kind: Pod metadata: name: pod-vol-nfs namespace: default spec: containers: - name: myapp image: ikubernetes/myapp:v1 volumeMounts: - name: html mountPath: /usr/share/nginx/html volumes: - name: html nfs: path: /data/volumes server: stor01 kubectl apply -f pod-nfs-vol.yaml kubectl get pods -o wide NAME READY STATUS RESTARTS AGE IP NODE pod-vol-nfs 1/1 Running 0 21s 10.244.2.15 node02- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

- 20

- 21

- 22

- 23

- 24

- 25

3.在nfs服务器上创建index.html

cd /data/volumes vim index.htmlnfs stor01

- 1

- 2

- 3

4.master节点操作

curl 10.244.2.15nfs stor01

kubectl delete -f pod-nfs-vol.yaml #删除nfs相关pod,再重新创建,可以得到数据的持久化存储 kubectl apply -f pod-nfs-vol.yaml nas gfs ceph san- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

四、PVC 和 PV

1.概述

(1)PV 全称叫做 Persistent Volume,持久化存储卷。它是用来描述或者说用来定义一个存储卷的,这个通常都是由运维工程师来定义。

(2)PVC 的全称是 Persistent Volume Claim,是持久化存储的请求。它是用来描述希望使用什么样的或者说是满足什么条件的 PV 存储。

(3)PVC 的使用逻辑:在 Pod 中定义一个存储卷(该存储卷类型为 PVC),定义的时候直接指定大小,PVC 必须与对应的 PV 建立关系,PVC 会根据配置的定义去 PV 申请,而 PV 是由存储空间创建出来的。PV 和 PVC 是 Kubernetes 抽象出来的一种存储资源。

2.PV和PVC之间的相互作用遵循的生命周期

Provisioning(配置)—> Binding(绑定)—> Using(使用)—> Releasing(释放) —> Recycling(回收)

(1)Provisioning,即 PV 的创建,可以直接创建 PV(静态方式),也可以使用 StorageClass 动态创建

(2)Binding,将 PV 分配给 PVC

(3)Using,Pod 通过 PVC 使用该 Volume,并可以通过准入控制StorageProtection(1.9及以前版本为PVCProtection) 阻止删除正在使用的 PVC

(4)Releasing,Pod 释放 Volume 并删除 PVC

(5)Reclaiming,回收 PV,可以保留 PV 以便下次使用,也可以直接从云存储中删除根据这 5 个阶段,PV 的状态有以下 4 种:

- Available(可用):表示可用状态,还未被任何 PVC 绑定

- Bound(已绑定):表示 PV 已经绑定到 PVC

- Released(已释放):表示 PVC 被删掉,但是资源尚未被集群回收

- Failed(失败):表示该 PV 的自动回收失败

3.一个PV从创建到销毁的具体流程

(1)一个PV创建完后状态会变成Available,等待被PVC绑定。

(2)一旦被PVC邦定,PV的状态会变成Bound,就可以被定义了相应PVC的Pod使用。

(3)Pod使用完后会释放PV,PV的状态变成Released。

(4)变成Released的PV会根据定义的回收策略做相应的回收工作。有三种回收策略,Retain、Delete和Recycle。Retain就是保留现场,K8S集群什么也不做,等待用户手动去处理PV里的数据,处理完后,再手动删除PV。Delete策略,K8S会自动删除该PV及里面的数据。Recycle方式,K8S会将PV里的数据删除,然后把PV的状态变成Available,又可以被新的PVC绑定使用。4.NFS使用PV和PVC

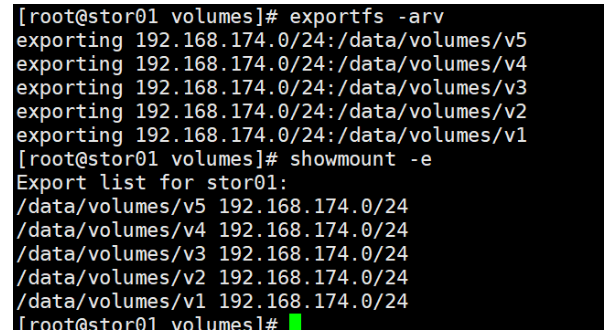

(1)配置nfs存储

mkdir v{1,2,3,4,5} vim /etc/exports /data/volumes/v1 192.168.174.0/24(rw,no_root_squash) /data/volumes/v2 192.168.174.0/24(rw,no_root_squash) /data/volumes/v3 192.168.174.0/24(rw,no_root_squash) /data/volumes/v4 192.168.174.0/24(rw,no_root_squash) /data/volumes/v5 192.168.174.0/24(rw,no_root_squash) exportfs -arv showmount -e- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

官方文档:https://kubernetes.io/zh-cn/docs/tasks/configure-pod-container/configure-persistent-volume-storage/#create-a-persistentvolume

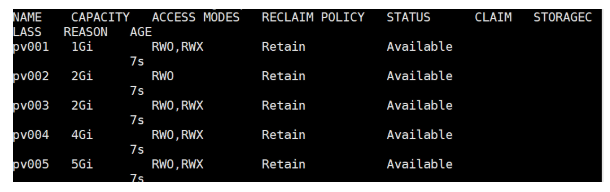

(2)定义PV,这里定义5个PV,并且定义挂载的路径以及访问模式,还有PV划分的大小。

vim pv-demo.yaml apiVersion: v1 kind: PersistentVolume metadata: name: pv001 labels: name: pv001 spec: nfs: path: /data/volumes/v1 server: stor01 accessModes: ["ReadWriteMany","ReadWriteOnce"] capacity: storage: 1Gi --- apiVersion: v1 kind: PersistentVolume metadata: name: pv002 labels: name: pv002 spec: nfs: path: /data/volumes/v2 server: stor01 accessModes: ["ReadWriteOnce"] capacity: storage: 2Gi --- apiVersion: v1 kind: PersistentVolume metadata: name: pv003 labels: name: pv003 spec: nfs: path: /data/volumes/v3 server: stor01 accessModes: ["ReadWriteMany","ReadWriteOnce"] capacity: storage: 2Gi --- apiVersion: v1 kind: PersistentVolume metadata: name: pv004 labels: name: pv004 spec: nfs: path: /data/volumes/v4 server: stor01 accessModes: ["ReadWriteMany","ReadWriteOnce"] capacity: storage: 4Gi --- apiVersion: v1 kind: PersistentVolume metadata: name: pv005 labels: name: pv005 spec: nfs: path: /data/volumes/v5 server: stor01 accessModes: ["ReadWriteMany","ReadWriteOnce"] capacity: storage: 5Gi kubectl apply -f pv-demo.yaml kubectl get pv- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

- 20

- 21

- 22

- 23

- 24

- 25

- 26

- 27

- 28

- 29

- 30

- 31

- 32

- 33

- 34

- 35

- 36

- 37

- 38

- 39

- 40

- 41

- 42

- 43

- 44

- 45

- 46

- 47

- 48

- 49

- 50

- 51

- 52

- 53

- 54

- 55

- 56

- 57

- 58

- 59

- 60

- 61

- 62

- 63

- 64

- 65

- 66

- 67

- 68

- 69

- 70

- 71

- 72

- 73

- 74

- 75

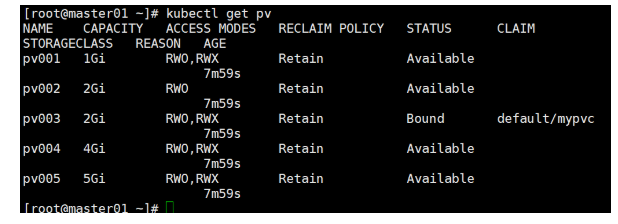

(3)定义PVC,这里定义了pvc的访问模式为多路读写,该访问模式必须在前面pv定义的访问模式之中。定义PVC申请的大小为2Gi,此时PVC会自动去匹配多路读写且大小为2Gi的PV,匹配成功获取PVC的状态即为Bound

vim pod-vol-pvc.yaml apiVersion: v1 kind: PersistentVolumeClaim metadata: name: mypvc namespace: default spec: accessModes: ["ReadWriteMany"] resources: requests: storage: 2Gi --- apiVersion: v1 kind: Pod metadata: name: pod-vol-pvc namespace: default spec: containers: - name: myapp image: ikubernetes/myapp:v1 volumeMounts: - name: html mountPath: /usr/share/nginx/html volumes: - name: html persistentVolumeClaim: claimName: mypvc kubectl apply -f pod-vol-pvc.yaml kubectl get pv- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

- 20

- 21

- 22

- 23

- 24

- 25

- 26

- 27

- 28

- 29

- 30

- 31

- 32

- 33

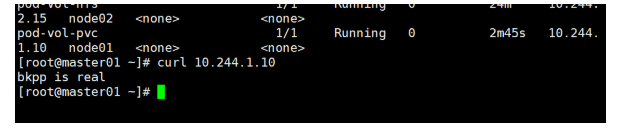

(4)测试访问,在存储服务器上创建index.html,并写入数据,通过访问Pod进行查看,可以获取到相应的页面。

cd /data/volumes/v3/ echo "bkpp is real" > index.html kubectl get pods -o wide pod-vol-pvc 1/1 Running 0 3m 10.244.1.10 k8s-node01 curl 10.244.1.10 bkpp is real- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

五、搭建 StorageClass + NFS,实现 NFS 的动态 PV 创建

1.概述

Kubernetes 本身支持的动态 PV 创建不包括 NFS,所以需要使用外部存储卷插件分配PV。

详见:https://kubernetes.io/zh/docs/concepts/storage/storage-classes/

卷插件称为 Provisioner(存储分配器),NFS 使用的是 nfs-client,这个外部卷插件会使用已经配置好的 NFS 服务器自动创建 PV。

Provisioner:用于指定 Volume 插件的类型,包括内置插件(如 kubernetes.io/aws-ebs)和外部插件(如 external-storage 提供的 ceph.com/cephfs)。2.在stor01节点上安装nfs,并配置nfs服务

mkdir /opt/k8s chmod 777 /opt/k8s/ vim /etc/exports /opt/k8s 192.168.174.0/24(rw,no_root_squash,sync) systemctl restart nfs- 1

- 2

- 3

- 4

- 5

- 6

- 7

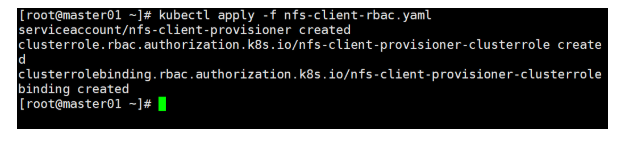

3.创建 Service Account,用来管理 NFS Provisioner 在 k8s 集群中运行的权限,设置 nfs-client 对 PV,PVC,StorageClass 等的规则

vim nfs-client-rbac.yaml #创建 Service Account 账户,用来管理 NFS Provisioner 在 k8s 集群中运行的权限 apiVersion: v1 kind: ServiceAccount metadata: name: nfs-client-provisioner --- #创建集群角色 apiVersion: rbac.authorization.k8s.io/v1 kind: ClusterRole metadata: name: nfs-client-provisioner-clusterrole rules: - apiGroups: [""] resources: ["persistentvolumes"] verbs: ["get", "list", "watch", "create", "delete"] - apiGroups: [""] resources: ["persistentvolumeclaims"] verbs: ["get", "list", "watch", "update"] - apiGroups: ["storage.k8s.io"] resources: ["storageclasses"] verbs: ["get", "list", "watch"] - apiGroups: [""] resources: ["events"] verbs: ["list", "watch", "create", "update", "patch"] - apiGroups: [""] resources: ["endpoints"] verbs: ["create", "delete", "get", "list", "watch", "patch", "update"] --- #集群角色绑定 apiVersion: rbac.authorization.k8s.io/v1 kind: ClusterRoleBinding metadata: name: nfs-client-provisioner-clusterrolebinding subjects: - kind: ServiceAccount name: nfs-client-provisioner namespace: default roleRef: kind: ClusterRole name: nfs-client-provisioner-clusterrole apiGroup: rbac.authorization.k8s.io kubectl apply -f nfs-client-rbac.yaml- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

- 20

- 21

- 22

- 23

- 24

- 25

- 26

- 27

- 28

- 29

- 30

- 31

- 32

- 33

- 34

- 35

- 36

- 37

- 38

- 39

- 40

- 41

- 42

- 43

- 44

- 45

4.使用 Deployment 来创建 NFS Provisioner

(1)NFS Provisione(即 nfs-client),有两个功能:一个是在 NFS 共享目录下创建挂载点(volume),另一个则是将 PV 与 NFS 的挂载点建立关联。

(2)由于 1.20 版本启用了 selfLink,所以 k8s 1.20+ 版本通过 nfs provisioner 动态生成pv会报错,解决方法如下

vim /etc/kubernetes/manifests/kube-apiserver.yaml spec: containers: - command: - kube-apiserver - --feature-gates=RemoveSelfLink=false #添加这一行 - --advertise-address=192.168.174.15 ...... kubectl apply -f /etc/kubernetes/manifests/kube-apiserver.yaml kubectl delete pods kube-apiserver -n kube-system kubectl get pods -n kube-system | grep apiserver- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

5.创建 NFS Provisioner

vim nfs-client-provisioner.yaml kind: Deployment apiVersion: apps/v1 metadata: name: nfs-client-provisioner spec: replicas: 1 selector: matchLabels: app: nfs-client-provisioner strategy: type: Recreate template: metadata: labels: app: nfs-client-provisioner spec: serviceAccountName: nfs-client-provisioner #指定Service Account账户 containers: - name: nfs-client-provisioner image: quay.io/external_storage/nfs-client-provisioner:latest imagePullPolicy: IfNotPresent volumeMounts: - name: nfs-client-root mountPath: /persistentvolumes env: - name: PROVISIONER_NAME value: nfs-storage #配置provisioner的Name,确保该名称与StorageClass资源中的provisioner名称保持一致 - name: NFS_SERVER value: stor01 #配置绑定的nfs服务器 - name: NFS_PATH value: /opt/k8s #配置绑定的nfs服务器目录 volumes: #申明nfs数据卷 - name: nfs-client-root nfs: server: stor01 path: /opt/k8s kubectl apply -f nfs-client-provisioner.yaml kubectl get pod NAME READY STATUS RESTARTS AGE nfs-client-provisioner-5d7df8dcc8-zxd4h 1/1 Running 0 14s- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

- 20

- 21

- 22

- 23

- 24

- 25

- 26

- 27

- 28

- 29

- 30

- 31

- 32

- 33

- 34

- 35

- 36

- 37

- 38

- 39

- 40

- 41

- 42

- 43

- 44

6.创建 StorageClass,负责建立 PVC 并调用 NFS provisioner 进行预定的工作,并让 PV 与 PVC 建立关联

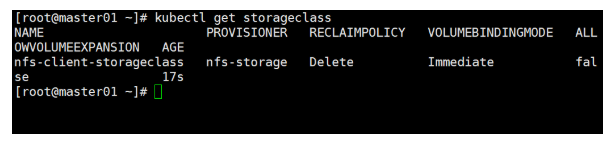

vim nfs-client-storageclass.yaml apiVersion: storage.k8s.io/v1 kind: StorageClass metadata: name: nfs-client-storageclass provisioner: nfs-storage #这里的名称要和provisioner配置文件中的环境变量PROVISIONER_NAME保持一致 parameters: archiveOnDelete: "false" #false表示在删除PVC时不会对数据进行存档,即删除数据 kubectl apply -f nfs-client-storageclass.yaml kubectl get storageclass NAME PROVISIONER RECLAIMPOLICY VOLUMEBINDINGMODE ALLOWVOLUMEEXPANSION AGE nfs-client-storageclass nfs-storage Delete Immediate false 43s- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

7.创建 PVC 和 Pod 测试

vim test-pvc-pod.yaml apiVersion: v1 kind: PersistentVolumeClaim metadata: name: test-nfs-pvc spec: accessModes: - ReadWriteMany storageClassName: nfs-client-storageclass #关联StorageClass对象 resources: requests: storage: 1Gi --- apiVersion: v1 kind: Pod metadata: name: test-storageclass-pod spec: containers: - name: busybox image: busybox:latest imagePullPolicy: IfNotPresent command: - "/bin/sh" - "-c" args: - "sleep 3600" volumeMounts: - name: nfs-pvc mountPath: /mnt restartPolicy: Never volumes: - name: nfs-pvc persistentVolumeClaim: claimName: test-nfs-pvc kubectl apply -f test-pvc-pod.yaml- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

- 20

- 21

- 22

- 23

- 24

- 25

- 26

- 27

- 28

- 29

- 30

- 31

- 32

- 33

- 34

- 35

- 36

- 37

- 38

(1)PVC 通过 StorageClass 自动申请到空间

kubectl get pvc NAME STATUS VOLUME CAPACITY ACCESS MODES STORAGECLASS AGE test-nfs-pvc Bound pvc-89c82b90-d486-4e2b-99a4-17efd3c96ba3 1Gi RWX nfs-client-storageclass 2s- 1

- 2

- 3

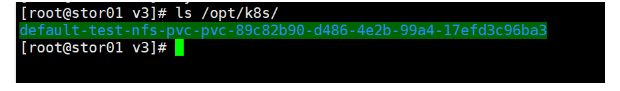

(2)查看 NFS 服务器上是否生成对应的目录,自动创建的 PV 会以 n a m e s p a c e − {namespace}- namespace−{pvcName}-${pvName} 的目录格式放到 NFS 服务器上

ls /opt/k8s/- 1

(3)进入 Pod 在挂载目录 /mnt 下写一个文件,然后查看 NFS 服务器上是否存在该文件

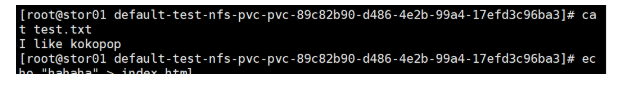

kubectl exec -it test-storageclass-pod sh / # cd /mnt/ /mnt # echo 'I like kokopop' > test.txt- 1

- 2

- 3

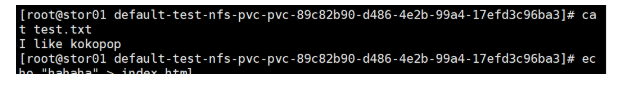

(4)发现 NFS 服务器上存在,说明验证成功

cat /opt/k8s/test.txt- 1

六、总结

1.动态资源

(1)概念自动动态创建PV,不同设备支持的插件不一样,以NFS为例

(2)storage Class:动态创建PV的过程

storage Class+nfs-client-provisioner- 准备NFS共享服务器和共享目录

- 创建sa服务账户,进行rbac资源的操作权限和授权

- 创建nfs-client-provisioner存储卷插件(以pod的方式运行的),在配置中关联sa服务账户,使得存储卷插件获得相关的操作权限

- 创建storageClass资源,配置中要关联存储的插件名称配置

————以上过程是必须创建的,以后只需要创建PVC就可以动态的生成相关的PV资源(只要空间足够可以无限创建) - 创建PVC资源,配置中关联StorageClass资源的名称,此时会在NFS服务器上生成相关PV的共享目录,目录名包含(namespace_name) (PVC_name) (PV_name)格式命名

- 创建pod资源存储卷类型设置成PVC名称,在容器配置中配置存储挂载

-

相关阅读:

ffmpeg+nginx-rtmp转发视频流

菜单栏-JS防抖

天宇优配|机构动向 港股强势上涨 机构看好反弹持续性

WebRTC 基础

new Vue的时候到底做了什么

Unity 动画知识点

金仓数据库 KingbaseES 插件参考手册 zhparser

博客积分上一万了

ros2机器人上位机与下位机连接方式(转载)

堆排序(数据结构)

- 原文地址:https://blog.csdn.net/Riky12/article/details/133145069