-

BERT 快速理解——思路简单描述

定义:

BERT(Bidirectional Encoder Representations from Transformers)是一种预训练的语言模型,它基于Transformer架构,通过在大规模的未标记文本上进行训练来学习通用的语言表示。

输入

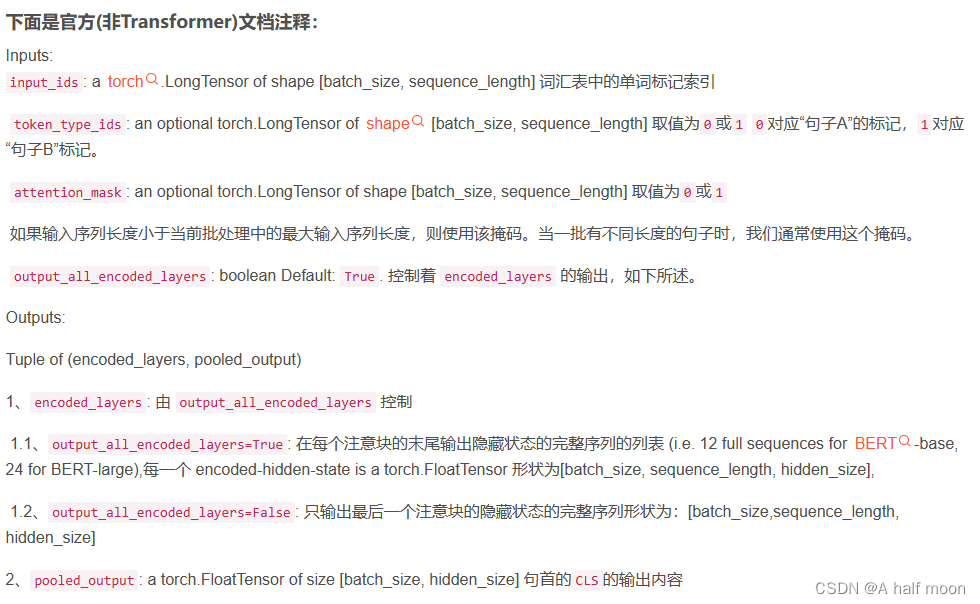

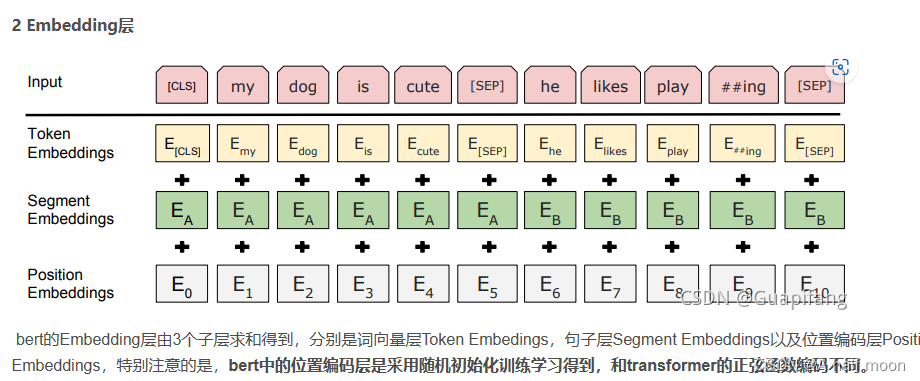

在BERT中,输入是一个文本序列,通常以单词或子词(如WordPiece)的形式表示。输入序列需要经过预处理步骤,包括分词、添加特殊标记(如起始标记[CLS]和分隔标记[SEP]),并转化为对应的词索引(input_ids)。此外,还需要创建一个注意力掩码(attention_mask),用于指示哪些位置是真实的单词,哪些位置是填充的。输入序列的长度通常会被填充或截断为固定长度。

BERT模型的第一层的输入的维度是 (batch_size, sequence_length, embedding_size),其中 batch_size 是输入文本的批次大小,sequence_length 是输入文本的序列长度,embedding_size 是词嵌入的维度(通常是模型的隐藏单元大小)。

对于BERT模型的后续层,每一层的输入是上一层的输出。具体来说,第二层的输入是第一层的输出,第三层的输入是第二层的输出,以此类推。每一层都通过自注意力机制(Self-Attention)和前馈神经网络(Feed-Forward Neural Network)对输入进行处理和转换,以获取更丰富的语义表示。这种层叠的结构使得BERT模型能够逐层地捕捉输入序列的复杂关系和语义信息。输出

BERT模型的输出包含以下部分:

- last_hidden_state(最后一层的隐藏状态):这是BERT模型最后一层的输出,它是一个三维张量,形状为[batch_size, sequence_length, hidden_size]。它包含了输入序列的每个位置的隐藏表示,其中hidden_size是BERT模型的隐藏单元大小。

- pooler_output(池化层输出):这是经过池化层处理后的输出,形状为[batch_size, hidden_size]。它是对最后一层隐藏状态进行汇总得到的整个句子的表示,通常用于句子级别的任务。

- hidden_states(所有层的隐藏状态):这是一个包含了每一层隐藏状态的张量。其中,hidden_states[0]对应输入的嵌入层,而hidden_states[i](其中1 <= i <= num_hidden_layers)对应BERT模型的第i层隐藏状态。

输出的含义:

- last_hidden_state中的每个位置表示了输入序列在语义和句法上的编码信息,可以用于下游任务的特征提取和表示学习。

- pooler_output是对整个句子进行汇总的表示,可以用于句子级别的分类或回归任务。

hidden_states提供了每一层的隐藏状态,可以用于进一步的分析、可视化或其他任务的需求。

关于层数:

Transformer模型中的编码器层和解码器层的数量可以根据具体的模型架构和任务需求进行设置。通常情况下,Transformer模型由多个编码器层和解码器层组成。在经典的Transformer模型中,如"Attention Is All You Need"论文所述,编码器和解码器都包含了6个层。这个设置是基于作者的经验和实验结果得出的,并且在许多自然语言处理任务中表现良好。

BERT模型引入了Transformer的编码器部分,因此,BERT的层数也是基于Transformer的6层编码器进行扩展的。BERT-Base模型具有12个编码器层,而BERT-Large模型具有24个编码器层。这样的设计选择是为了增加模型的表示能力和语义学习能力。

-

相关阅读:

kafka安装与相关配置详解

HMS Core助力宝宝巴士为全球开发者展现高品质儿童数字内容

FPGA通信—千兆网(UDP)软件设计

1.计算机系统概述-王道考研计算机组成原理

Linux 内核 6.5 发布,首次支持 Wi-Fi 7 和 USB4

.NET MAUI开源架构_2.什么是 .NET MAUI?

tokenizer添加token的详细demo

基于SpringBoot的在线商城系统设计与实现

systemverilog运行的时候调用系统函数运行python等

SpringBoot笔记

- 原文地址:https://blog.csdn.net/weixin_44064434/article/details/133049203