-

李宏毅《DLHLP》学习笔记6 - 语言模型

视频链接:https://www.youtube.com/watch?v=dymfkWtVUdo&list=PLJV_el3uVTsO07RpBYFsXg-bN5Lu0nhdG&index=8&ab_channel=Hung-yiLee

课件链接:https://speech.ee.ntu.edu.tw/~tlkagk/courses/DLHLP20/ASR3.pdf1. Language Model

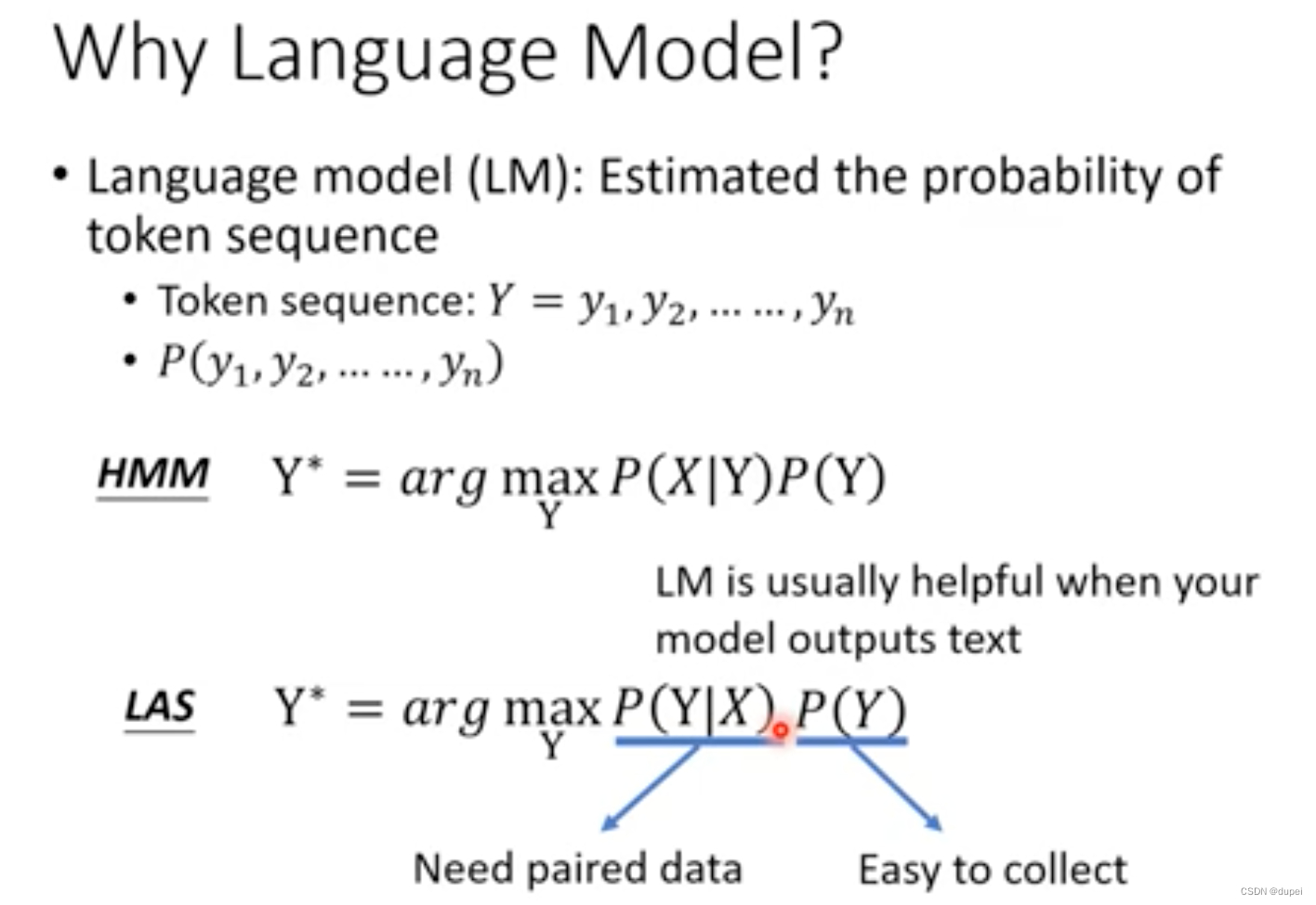

LM的作用是预测token sequence出现的概率。对于输出文本的模型,LM通常都是很有帮助的。

N-gram LM 有smooth的问题,然后,引出Continuous LM,再进一步扩展到Deep Learning based LM.2. N-gram LM

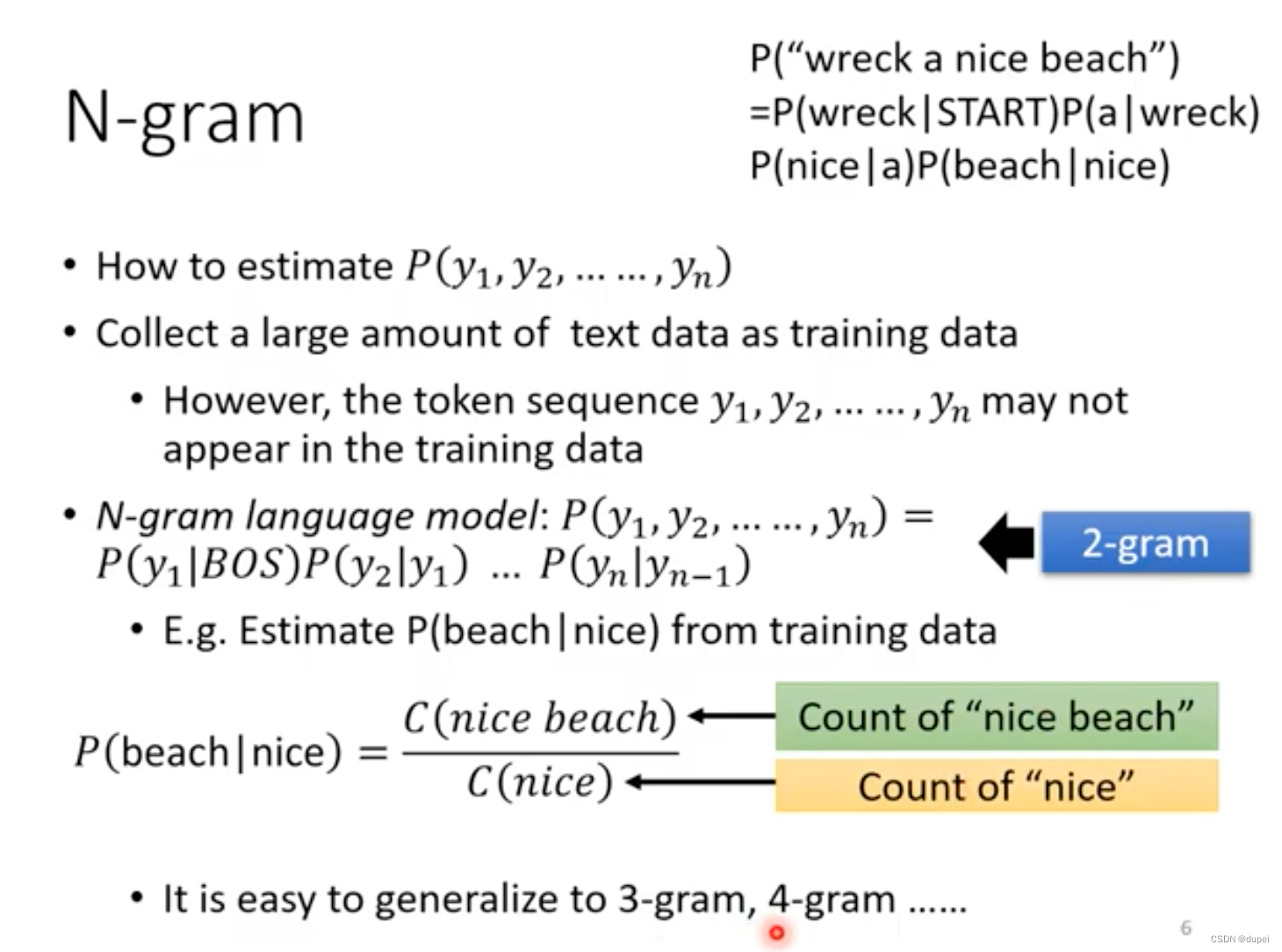

传统的LM是N-gram LM,下面介绍一下N-gram LM的技术细节。

2.1 N-gram细节

常见的N-gram有2-gram,3-gram,。。。

2.2 N-gram LM的局限

局限是什么?估计的概率可能并不准确。

- N越大,问题越明显;

- 在训练集中,n-grams并没有出现。

如何解决?使用的技术叫做language model smooth

-

相关阅读:

Angular 中declarations,imports,providers,exports的用法?

Ambari技术介绍-尚硅谷大数据培训

shell之sed

单点登录SSO

注意力评分函数 - Attention Scoring Function

构建器模式-C++实现

1204. 最后一个能进入电梯的人

基于C#实现字符串相似度

windows环境下安装logstash同步数据,注册系统服务

基于微信在线教育视频学习点播小程序系统设计与实现开题答辩PPT

- 原文地址:https://blog.csdn.net/dupei/article/details/128158555