-

ArtFlow: Unbiased Image Style Transfer via Reversible Neural Flows

ArtFlow: Unbiased Image Style Transfer via Reversible Neural Flows

1、基本信息

-

作者:Jie An, Siyu Huang等

-

会议:CVPR 2021

-

单位:罗切斯特大学、百度研究院、腾讯AI实验室、腾讯数据平台

2、主要框架

- 任务:Universal style transfer

- 问题:Content leak phenomenon

- 方法:ArtFlow

- 架构

- Reversible neural flows

- An unbiased feature transfer module

- 流程:Projection-Transfer-Reversion

- 架构

- 贡献

- 揭示SOTA风格迁移算法的

Content Leak现象,并分析证实其3大主要原因。 - 提出无偏的、无损失的、可逆的网络

PFN,并可以用其分析UST算法中Transfer模块自身会不会有偏,从而导致Content Leak。 - 提出新的风格迁移框架

ArtFlow(PFN+Transfer),不会内容泄露的同时,结果可与SOTA比肩。

- 揭示SOTA风格迁移算法的

3、Content Leak

3.1. What is Content Leak?

-

现象(Phenomena):Universal style transfer(AdaIN、WCT、Avatar-Net等)风格化时分解、重建图像内容的能力有限,在多风格迁移后不能保留图像内容。称此现象为内容泄露(Content Leak)。

-

证据(Evidence):做多轮实验,将前一轮的输出作为下一轮的内容图输入,实验结果如下图1。

3.2. Why Does Content Leak Happen?

-

分析(Analysis):UST方法(Encoder-Transfer-Decoder )

- 编码器【image embedding】

- 固定不变的

- 可学习的解码器【remap deep features back to images】

- 图像重建有误(如WCT)

- 解码器训练有偏(如AdaIN)

- 风格迁移的模块【based on deep feature】

- 迁移模块训练有偏(如Avatar-Net)

- 编码器【image embedding】

-

原因(Causes)

Reconstruction error:UST的解码器对内容图的重建有损失。- WCT论文中作者表示,由于编码器中的pooling operations导致的空间信息损失,就算用了image reconstruction loss 和 content loss,解码器也是不完美的。

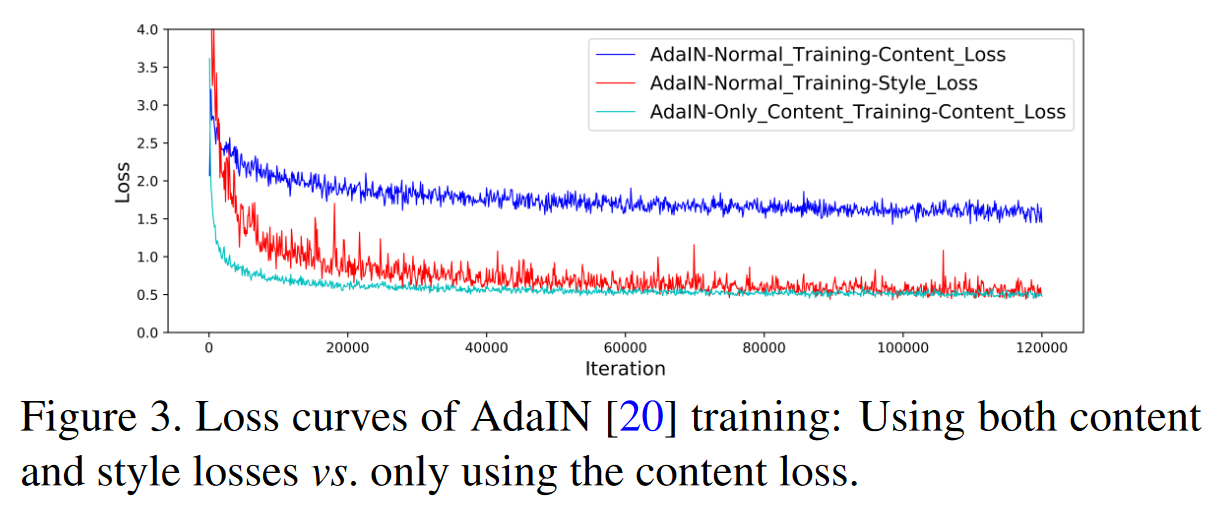

Biased decoder training:以AdaIN为例,其使用content loss和style loss作为损失函数。因为style loss的存在,解码器需要权衡内容损失和风格损失,自然不能完美地重建图像。- 从图3的实验结果可以看出,只用content loss作为损失函数的收敛值比结合版的更小。因此,AdaIN自编码器会偏向于更多的艺术效果,自此出现了内容泄露。【稍有疑惑?】

-

Biased style transfer module:以Avatar-Net中的Style Decorator为例- 其灵感来源于deep image analogy,分以下两步:

- 根据内容相似度,每个内容特征块fc 会找到一个对应的风格特征块 fs。

- fsc 把内容特征块替换为相应的风格特征块。【这不完全变成风格图了吗?】

- 以上替换是不可逆的,不能从fsc复原到fc ,因此结果更偏向于风格,导致内容泄露现象。

- 其灵感来源于deep image analogy,分以下两步:

-

总结如图5。

4、ArtFlow

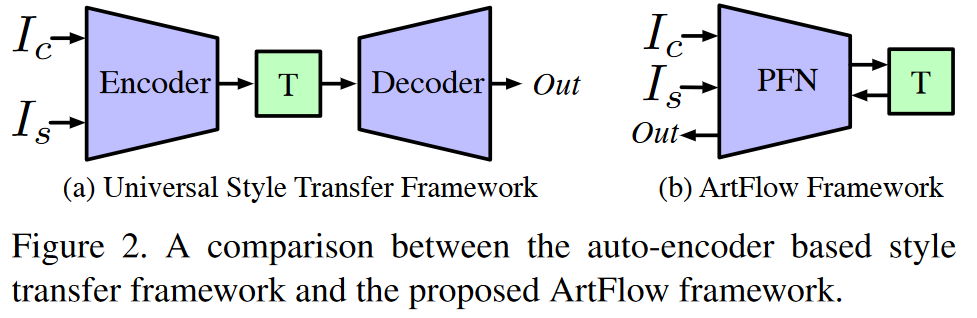

- 框架对比(Comparison):UST【Encoder-Transfer-Decoder】、ArtFlow【PFN(Projection Flow Network)+ Transfer】

4.1. Overview of the ArtFlow Framework

- Projection(PFN)-Transfer-Reversion(PFN-1)

4.2. Projection Flow Network(PFN)

- 作用:feature extractor、image synthesizer

- 模型:Glow

- Additive coupling

- 足以处理风格迁移任务;

- 比Affine coupling更有效且稳定。

- Invertible 1×1 convolution

- 因Additive coupling只变换固定的一半通道的特征值,以此重排序通道。

- Actnorm:activation normalization layer,作用相当于BN。

- 每个通道归一化。【可以将这个换成AdaIN或者其他?】

- Squeeze:减少特征图的空间大小(宽高)

- 沿着空间维度切割成小块

- 沿着通道维度拼接小块

- Additive coupling

4.3. Unbiased Content-Style Separation

Which style transfer module should ArtFlow use to achieve the unbiased style transfer?

- AdaIN、WCT

4.3.1 理论分析

-

UST方法机制可以认为是

bilinear model(Tenenbaum and Freeman,2000)的进化版。- 假定:能将图像分为内容因子C、风格因子S

- 风格迁移:将内容图像的风格Sc替换为目标图像的风格Ss。

-

UST方法同样是假定了

内容信息和风格信息在深度特征空间中是可以或明显或隐晦地分解开的。- AdaIN:内容因子C是特征的归一化值、风格因子S是特征的均值/标准差向量

Definition 1 Suppose we have a bilinear style transfer module fcs = C(fc)S(fs), where C, S denote the content factor and the style factor in the bilinear model, respectively. fcs is an unbiased style transfer module if C(fcs) = C(fc) and S(fcs) = S(fs).

Theorem 1 The adaptive instance normalization in AdaIN is an unbiased style transfer module.

Theorem 2 The whitening and coloring transform in WCT is an unbiased style transfer module.

4.3.2 实验证明

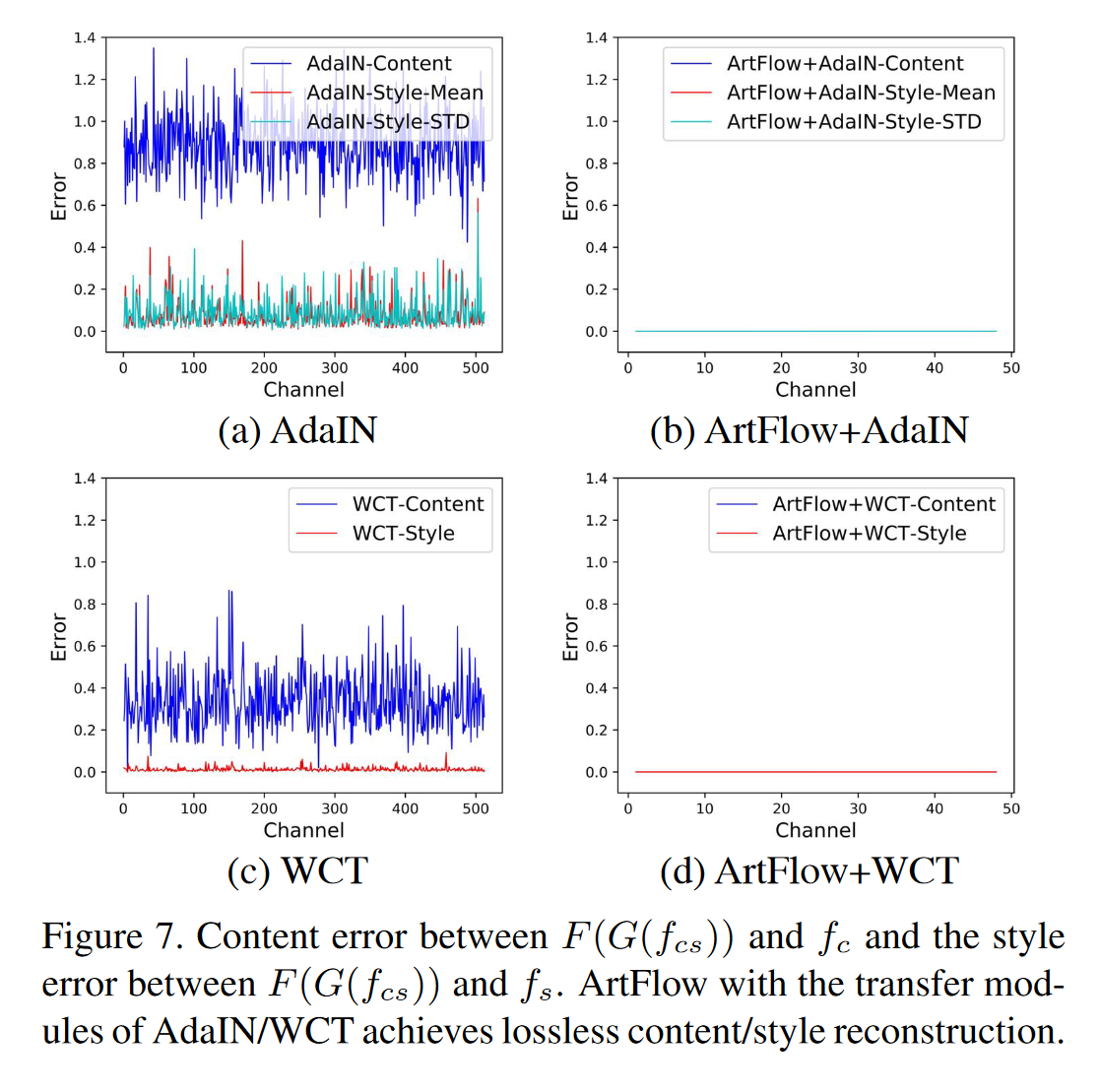

控制变量法:使用PFN替换UST的编码解码器,排除解码器带来的原因1、图像重建错误;2、有偏的图像复原。

- 发现(findings)

- 从(a) vs. (b)和 © vs. (d) 看出,PFN确实可以无损失、无偏差地重建内容和风格信息。

- 从(b) vs. (d)看出,AdaIN和WCT的迁移模块是无偏的。

5、实验

- Comparison(in terms of stylization effect, computing time, content leak, content factor visualization)

- 新的有趣的应用:reverse style transfer

5.1. Experimental Settings

Dataset

内容图:MS-COCO

风格图:WikiArt

5.2. Style Transfer Results

Visual comparison

-

WCT、OptimalWCT:艺术效果;

-

LinearWCT、AdaIN、ArtFlow:保留更多内容细节;ArtFlow的细节内容更多,且没有内容泄露。

-

Avatar-Net:保留更精致的纹理信息。

- Portrait style transfer 的训练数据集

- 内容图:FFHQ

- 风格图:Metfaces

Quantitative comparison

- 评估标准:Structural Similarity Index(SSIM)、content loss(与源内容图)、mean square error of Gram matrics(与源风格图)

- SSIM:ArtFlow得分最高:保留内容信息能力最强

- Content loss:StyleSwap最高,但视觉效果没有ArtFlow好。

- Gram loss:ArtFlow的得分不理想,因为其主要解决内容泄露问题,纠正偏向风格图的倾向。

- ArtFlow+AdaIN的值比AdaIN要低、ArtFlow+WCT的值和WCT差不多。

- 证明ArtFlow在解决内容泄露的同时不损害原本的风格化能力。

- Computing time

- ArtFlow+AdaIN比AdaIN慢,因为没采用池化操作,需要计算更多层。

- ArtFlow+WCT比WCT快,因为不需要multi-level 风格化策略。

5.3. Content Leak

Avatar-Net 和ArtFlow+Avatar-Net相比得,ArtFlow可以缓解内容泄露。

5.4. Content-Style Separation

4.3章的理论分析表明过,图像的特征空间可以分离出内容因子和风格因子。图11通过逆转该内容因子,将其可视化成图像。

ArtFlow逆转图中带有很少的风格效果(如色彩),且保留更锋利的图像结构。这表明其可以无偏地分离内容和风格。

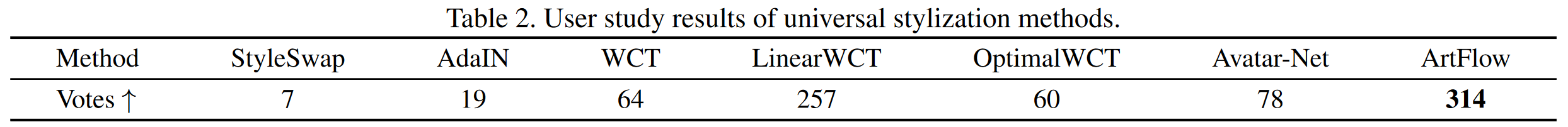

5.5. User Study

-

-

相关阅读:

Mac显示隐藏文件目录

【强化学习论文合集 | 2020年合集】四. ICLR-2020 强化学习论文

kubernetes之常用核心资源对象

【YashanDB知识库】数据变化率超过阈值统计信息失效

zookeeper动态扩缩容(无需重启)

【马士兵】Python基础--13

记一次弱口令之后引发的获取服务器权限

Helm upgrade 时 no matches for kind “xxxx“ in version “xxxx“ 问题处理

getline的使用详解

互联网摸鱼日报(2023-05-27)

- 原文地址:https://blog.csdn.net/weixin_44019018/article/details/127766339