-

Hadoop(HDFS)

文章目录

一、HDFS概述

1.1 HDFS 产出背景及定义

(1)HDFS 产生背景

随着数据量越来越大,在一个操作系统存不下所有的数据,那么就分配到更多的操作系统管理的磁盘中,但是不方便管理和维护,迫切需要一种系统来管理多台机器上的文件,这就是分布式文件管理系统。HDFS 只是分布式文件管理系统中的一种。

(2)HDFS 定义

HDFS(Hadoop Distributed File System),它是一个文件系统,用于存储文件,通过目录树来定位文件;其次,它是分布式的,由很多服务器联合起来实现其功能,集群中的服务器有各自的角色。

HDFS 的使用场景:适合一次写入,多次读出的场景。一个文件经过创建、写入和关闭之后就不需要改变。

1.2 HDFS 优缺点

1.3 HDFS 组成架构

1.4 HDFS 文件块大小(面试重点)

二、HDFS的Shell相关操作

2.1 基本语法

hadoop fs 具体命令 OR hdfs dfs 具体命令

两个是完全相同的。

2.2 命令大全

2.3 常用命令操作

2.3.1 准备工作

2.3.2 上传

2.3.3 下载

2.4 HDFS 直接操作

这里设置的副本数只是记录在 NameNode 的元数据中,是否真的会有这么多副本,还得

看 DataNode 的数量。因为目前只有 3 台设备,最多也就 3 个副本,只有节点数的增加到 10

台时,副本数才能达到 10。三、HDFS的API操作

3.1 客户端环境准备

验证 Hadoop 环境变量是否正常。双击 winutils.exe,如果报如下错误。说明缺少微软运行库(正版系统往往有这个问题)。再资料包里面有对应的微软运行库安装包双击安装即可。

4)在 IDEA 中创建一个 Maven 工程 HdfsClientDemo,并导入相应的依赖坐标+日志添加

<dependencies> <dependency> <groupId>org.apache.hadoopgroupId> <artifactId>hadoop-clientartifactId> <version>3.1.3version> dependency> <dependency> <groupId>junitgroupId> <artifactId>junitartifactId> <version>4.12version> dependency> <dependency> <groupId>org.slf4jgroupId> <artifactId>slf4j-log4j12artifactId> <version>1.7.30version> dependency> dependencies>- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

在项目的 src/main/resources 目录下,新建一个文件,命名为“log4j.properties”,在文件中填入

log4j.rootLogger=INFO, stdout log4j.appender.stdout=org.apache.log4j.ConsoleAppender log4j.appender.stdout.layout=org.apache.log4j.PatternLayout log4j.appender.stdout.layout.ConversionPattern=%d %p [%c] - %m%n log4j.appender.logfile=org.apache.log4j.FileAppender log4j.appender.logfile.File=target/spring.log log4j.appender.logfile.layout=org.apache.log4j.PatternLayout log4j.appender.logfile.layout.ConversionPattern=%d %p [%c] - %m%n- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

5)创建包名:com.xxxx.hdfs

6)创建 HdfsClient 类package com.xxxx.hdfs; import org.apache.hadoop.conf.Configuration; import org.apache.hadoop.fs.FileSystem; import org.apache.hadoop.fs.Path; import org.junit.Test; import java.io.IOException; import java.net.URI; import java.net.URISyntaxException; /** * 客户端代码常用套路: * 1、获取一个客户端对象 * 2、执行相关的操作命令 * 3、关闭资源 */ public class HdfsClient { @Test public void testMkdirs() throws IOException, URISyntaxException, InterruptedException { //创建一个配置文件 Configuration configuration = new Configuration(); //获取文件系统,url:连接的集群nn地址 //FileSystem fs = FileSystem.get(new URI("hdfs://hadoop102:8020"), configuration); FileSystem fs = FileSystem.get(new URI("hdfs://hadoop102:8020"), configuration,"lln"); //创建目录 fs.mkdirs(new Path("/xiyou/huaguoshan/")); //关闭资源 fs.close(); } }- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

- 20

- 21

- 22

- 23

- 24

- 25

- 26

- 27

- 28

- 29

- 30

- 31

- 32

- 33

- 34

- 35

- 36

- 37

- 38

优化

package com.xxxx.hdfs; import org.apache.hadoop.conf.Configuration; import org.apache.hadoop.fs.FileSystem; import org.apache.hadoop.fs.Path; import org.junit.After; import org.junit.Before; import org.junit.Test; import java.io.IOException; import java.net.URI; import java.net.URISyntaxException; /** * 客户端代码常用套路: * 1、获取一个客户端对象 * 2、执行相关的操作命令 * 3、关闭资源 */ public class HdfsClient { private FileSystem fs; //初始化 @Before public void init() throws URISyntaxException, IOException, InterruptedException { //创建一个配置文件 Configuration configuration = new Configuration(); //获取文件系统,url:连接的集群nn地址 fs = FileSystem.get(new URI("hdfs://hadoop102:8020"), configuration,"lln"); } //关闭资源 @After public void close() throws IOException { fs.close(); } @Test public void testMkdirs() throws IOException { //创建目录 fs.mkdirs(new Path("/xiyou/huaguoshan1/")); } }- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

- 20

- 21

- 22

- 23

- 24

- 25

- 26

- 27

- 28

- 29

- 30

- 31

- 32

- 33

- 34

- 35

- 36

- 37

- 38

- 39

- 40

- 41

- 42

- 43

- 44

- 45

- 46

- 47

- 48

- 49

- 50

- 51

3.2 HDFS 的API案例实操

3.2.1 HDFS 文件上传

(1)编写源代码

@Test public void testCopyFromLocalFile() throws IOException, InterruptedException, URISyntaxException { // 1 获取文件系统 Configuration configuration = new Configuration(); //configuration.set("dfs.replication", "2");//副本数量 FileSystem fs = FileSystem.get(new URI("hdfs://hadoop102:8020"), configuration, "lln"); // 2 上传文件 //参数解读:参数一:是否删除源数据,参数二:是否允许覆盖,参数三:原数据路径,参数四:目的地路径 fs.copyFromLocalFile(false, false, new Path("d:/sunwukong.txt"), new Path("/xiyou/huaguoshan1")); // 3 关闭资源 fs.close(); }- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

(2)将 hdfs-site.xml 拷贝到项目的 resources 资源目录下

<configuration> <property> <name>dfs.replicationname> <value>1value> property> configuration>- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

(3)参数优先级

参数优先级排序:

- 客户端代码中设置的值

- ClassPath 下的用户自定义配置文件

- 然后是服务器的自定义配置(xxx-site.xml)

- 服务器的默认配置(xxx-default.xml)

3.2.2 HDFS 文件下载

@Test public void testCopyToLocalFile() throws IOException{ //参数解读:参数一:是否删除源数据,参数二:源文件路径,参数三:目标地址路径win,参数四:是否开启文件校验 fs.copyToLocalFile(false,new Path("hdfs://hadoop102/xiyou/huaguoshan"),new Path("D:\\"),true); }- 1

- 2

- 3

- 4

- 5

3.2.3 HDFS 删除文件和目录

@Test public void testDelete() throws IOException{ //参数解读:参数一:要删除的路径,参数二:是否递归删除 //删除文件 //fs.delete(new Path("/jdk-8u212-linux-x64.tar.gz"),false); //删除空目录 //fs.delete(new Path("/sanguo"),false); //删除非空目录 fs.delete(new Path("/xiyou"),true); }- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

3.2.4 HDFS 文件更名和移动

@Test public void testMv() throws IOException { //对文件名称的修改 //参数解读:参数一:源文件路径,参数二:目标文件路径 //fs.rename(new Path("/input/word.txt"),new Path("/input/lln.txt")); //文件个更名和修改 //fs.rename(new Path("/input/lln.txt"),new Path("/word.txt")); //目录的更名 fs.rename(new Path("/input"),new Path("/output")); }- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

3.2.5 HDFS 查看文件详情

@Test public void testDetail() throws IOException { //获取所有文件信息 RemoteIterator<LocatedFileStatus> listFiles = fs.listFiles(new Path("/"), true); //遍历文件 while (listFiles.hasNext()) { LocatedFileStatus fileStatus = listFiles.next(); System.out.println("========" + fileStatus.getPath() + "========="); System.out.println(fileStatus.getPermission()); System.out.println(fileStatus.getOwner()); System.out.println(fileStatus.getGroup()); System.out.println(fileStatus.getLen()); System.out.println(fileStatus.getModificationTime()); System.out.println(fileStatus.getReplication()); System.out.println(fileStatus.getBlockSize()); System.out.println(fileStatus.getPath().getName()); // 获取块信息 BlockLocation[] blockLocations = fileStatus.getBlockLocations(); System.out.println(Arrays.toString(blockLocations)); } }- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

- 15

- 16

- 17

- 18

- 19

- 20

- 21

- 22

- 23

- 24

3.2.6 HDFS 文件和文件夹判断

@Test public void testListStatus() throws IOException { //判断是文件还是文件夹 FileStatus[] listStatus = fs.listStatus(new Path("/")); for(FileStatus fileStatus :listStatus){ // 如果是文件 if (fileStatus.isFile()) { System.out.println("f:"+fileStatus.getPath().getName()); }else { System.out.println("d:"+fileStatus.getPath().getName()); } } }- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- 14

四、HDFS的读写流程

4.1 HDFS 写数据流程

4.1.1 剖析文件写入

(1)客户端通过 Distributed FileSystem 模块向 NameNode 请求上传文件,NameNode 检查目标文件是否已存在,父目录是否存在。

(2)NameNode 返回是否可以上传。

(3)客户端请求第一个 Block 上传到哪几个 DataNode 服务器上。

(4)NameNode 返回 3 个 DataNode 节点,分别为 dn1、dn2、dn3。

(5)客户端通过FSDataOutputStream模块请求dn1上传数据,dn1收到请求继续调用dn2,然后dn2调用dn3,将这个通信管道建立完成。

(6)dn1、dn2、dn3 逐级应答客户端。

(7)客户端开始往 dn1 上传第一个 Block(先从磁盘读取数据放到一个本地内存缓存),以 Packet 为单位,dn1 收到一个 Packet 就会传给 dn2,dn2 传给 dn3;dn1 每传一个 packet会放入一个应答队列等待应答。

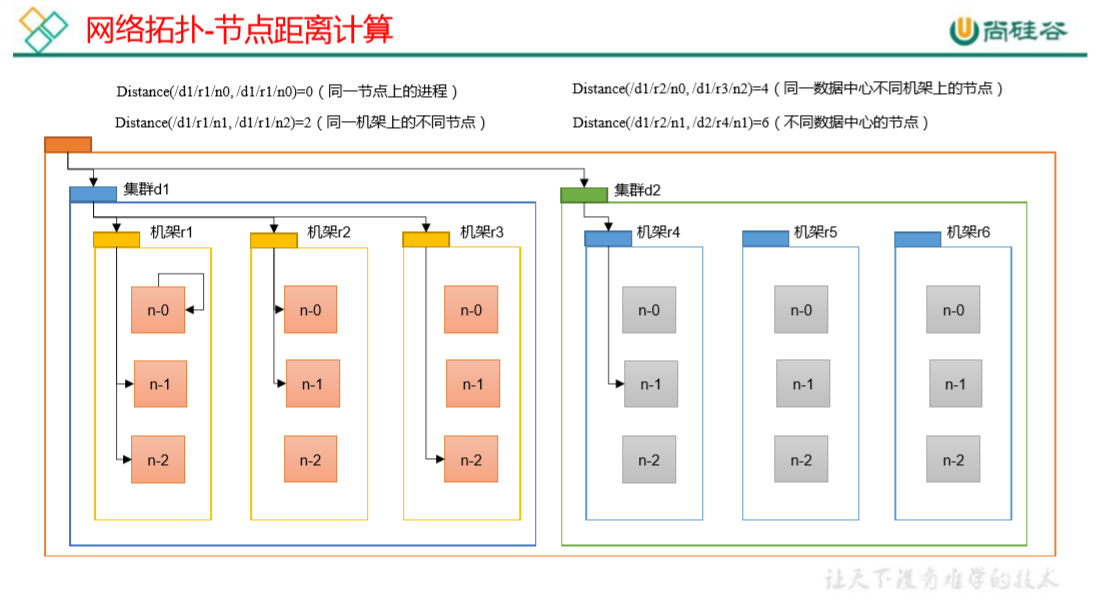

(8)当一个 Block 传输完成之后,客户端再次请求 NameNode 上传第二个 Block 的服务器。(重复执行 3-7 步)。4.1.2 网络拓扑-节点距离计算

在 HDFS 写数据的过程中,NameNode 会选择距离待上传数据最近距离的 DataNode 接

收数据。那么这个最近距离怎么计算呢?节点距离:两个节点到达最近的共同祖先的距离总和。

4.1.3 机架感知(副本存储节点选择)

(1)机架感知说明

http://hadoop.apache.org/docs/r3.1.3/hadoop-project-dist/hadoop-hdfs/HdfsDesign.html#Data_Replication

(2)源码说明

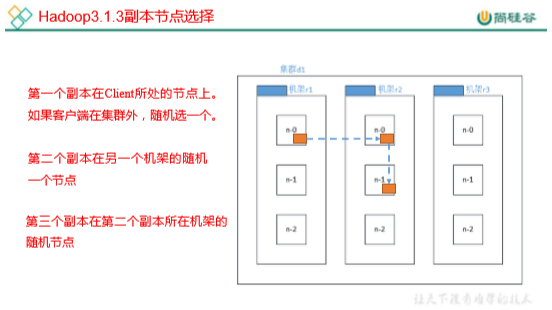

Crtl + n 查找 BlockPlacementPolicyDefault,在该类中查找 chooseTargetInOrder 方法。(3)Hadoop3.1.3 副本节点选择

4.2 HDFS 读数据流程

(1)客户端通过 DistributedFileSystem 向 NameNode 请求下载文件,NameNode 通过查询元数据,找到文件块所在的 DataNode 地址。

(2)挑选一台 DataNode(就近原则,然后随机)服务器,请求读取数据。

(3)DataNode 开始传输数据给客户端(从磁盘里面读取数据输入流,以 Packet 为单位来做校验)。

(4)客户端以 Packet 为单位接收,先在本地缓存,然后写入目标文件。

注:串行读

五、NameNode 和 SecondaryNameNode

5.1 NN和2NN工作机制

第一阶段:NameNode 启动

(1)第一次启动 NameNode 格式化后,创建 Fsimage 和 Edits 文件。如果不是第一次启动,直接加载编辑日志和镜像文件到内存。

(2)客户端对元数据进行增删改的请求。

(3)NameNode 记录操作日志,更新滚动日志。

(4)NameNode 在内存中对元数据进行增删改。

第二阶段:Secondary NameNode 工作

(1)Secondary NameNode 询问 NameNode 是否需要 CheckPoint。直接带回 NameNode是否检查结果。

(2)Secondary NameNode 请求执行 CheckPoint。

(3)NameNode 滚动正在写的 Edits 日志。

(4)将滚动前的编辑日志和镜像文件拷贝到 Secondary NameNode。

(5)Secondary NameNode 加载编辑日志和镜像文件到内存,并合并。

(6)生成新的镜像文件 fsimage.chkpoint。

(7)拷贝 fsimage.chkpoint 到 NameNode。

(8)NameNode 将 fsimage.chkpoint 重新命名成 fsimage。5.2 Fsimage 和 Edits 解析

CheckPoint时间设置

1)通常情况下,SecondaryNameNode 每隔一小时执行一次。 [hdfs-default.xml] dfs.namenode.checkpoint.period 3600s

2)一分钟检查一次操作次数,当操作次数达到 1 百万时,SecondaryNameNode 执行一次

dfs.namenode.checkpoint.txns</name> 1000000</value> 操作动作次数</description> </property> dfs.namenode.checkpoint.check.period</name> 60s</value> 1 分钟检查一次操作次数</description> </property> - 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

- 10

- 11

六、DataNode

6.1 DataNode工作机制

6.2 数据完整性

6.3 掉线时限参数设置

需要注意的是 hdfs-site.xml 配置文件中的 heartbeat.recheck.interval 的单位为毫秒,dfs.heartbeat.interval 的单位为秒。dfs.namenode.heartbeat.recheck-interval</name> 300000</value> </property> dfs.heartbeat.interval</name> 3</value> </property> - 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

单启动

-

相关阅读:

git clone后修改文件然后再上传覆盖

【算能】麒麟系统reboot后报错:

算法|图论 3

.gitignore 不生效的解决方案

数据治理:数据治理框架(第一篇)

我的docker随笔38:用 registry 搭建私有仓库

不允许你还没有了解哈希表、哈希桶、哈希冲突的解决,如何避免冲突

3.vue3.2的父传子defineProps,子传父emits以及ref

二进制安装Kubernetes(k8s)v1.29.2

神经系统肿瘤治疗包括,神经系统肿瘤治疗费用

- 原文地址:https://blog.csdn.net/lln1540295459/article/details/126497389