-

高级计量经济学(part2)--小样本OLS

学习笔记,仅供参考,有错必纠

参考自:陈强. 高级计量经济学[M].

古典线性回归模型的假定

“最小二乘法" (Ordjnary Least Square, 简记OLS) 是单一方程线性回归模型最常见、最基本的估计方法. “古典线性回归模型" (Class ical Linear Regression Model, 简记CLRM) 的假定如下.

- 假设1 线性假定(linearity).

总体(population)模型为:

y i = β 1 x i 1 + β 2 x i 2 + ⋯ + β k x i K + ϵ i (1) y_i = \beta_1 x_{i1} + \beta_2 x_{i2} + \cdots + \beta_k x_{iK} + \epsilon_i \tag{1} yi=β1xi1+β2xi2+⋯+βkxiK+ϵi(1)

其中, n n n为样本容量,解释变量 x i x_i xi, 的第一个下标表示第 i i i个“观测值" (observation) , 而第2个下标则表示第 k k k个解释变量( k = 1 , ⋯ , K k=1,\cdots, K k=1,⋯,K) , 共有 K K K个解释变量. 如果有常数项,则通常令第一个解释变量为单位向量,即 x i 1 ≡ 1 , ∀ i x_{i1} \equiv 1, \forall i xi1≡1,∀i.

β 1 , β 2 , ⋯ , β K \beta_1, \beta_2, \cdots, \beta_K β1,β2,⋯,βK均为待估参数,被称为“回归系数"(regression coefficients). 线性假设的含义是每个解释变量 x i k x_{ik} xik对被解释变量 y i y_i yi, 的边际效应均为常数,比如 ∂ E ( y i ) ∂ x i 1 = β 1 \frac{\partial E(y_i)}{\partial x_{i1}} = \beta_1 ∂xi1∂E(yi)=β1. 如果认为某解释变量的边际效应是可变的,则可以加入平方项( x i k 2 x_{ik}^2 xik2) 、三次方项( x i k 3 x_{ik}^3 xik3),或交互项( x i k x i m x_{ik} x_{im} xikxim). 此时,只要把高次项也作为解释变量来看待, 则依然满足线性假定.

总体模型也称为“数据生成过程" ( Data Generating Process, 简记DGP) . 为了更简洁地表达,下面引入矩阵符号. 把公式(1)的所有解释变量和参数都写成向量,记第 i i i个观测数据为 x i ≡ ( x i 1 x i 2 ⋯ x i K ) ′ , β ≡ ( β 1 β 2 ⋯ β K ) ′ x_i \equiv (x_{i1} \; x_{i2} \cdots x_{iK})', \beta \equiv (\beta_1 \; \beta_2 \cdots \beta_K)' xi≡(xi1xi2⋯xiK)′,β≡(β1β2⋯βK)′, 则公式(1)可写为:

- 假设2 严格外生性(strict exogeneity)

E ( ϵ i ∣ X ) = E ( ϵ i ∣ x 1 , ⋯ , x n ) = 0 , ( i = 1 , ⋯ , n ) (5) E(\epsilon_i | X) = E(\epsilon_i | x_1, \cdots, x_n) = 0, (i = 1, \cdots, n) \tag{5} E(ϵi∣X)=E(ϵi∣x1,⋯,xn)=0,(i=1,⋯,n)(5)

即在给定数据矩阵 X X X的情况下,扰动项 ϵ i \epsilon_i ϵi的条件期望为0. 这意味着, ϵ i \epsilon_i ϵi必须均值独立于( mean - independent) 所有解释变量的观测数据,而不仅仅是同一解释变量 x i x_i xi 中的观测数据. 根据均值独立的性质, ϵ i \epsilon_i ϵi与所有解释变量都不相关,即 C o v ( ϵ i , x j k ) = 0 , ∀ j , k Cov(\epsilon_i, x_{jk}) = 0, \forall \; j,k Cov(ϵi,xjk)=0,∀j,k. 这是一个很强的假定,但在大样本OLS 理论中可以减弱.

事实上,均值独立仅要求 E ( ϵ ∣ X ) = c E(\epsilon|X) = c E(ϵ∣X)=c, 其中 c c c为某常数,但不一定为0. 但当回归方程中有常数项时,要求 E ( ϵ i ∣ X ) = 0 E(\epsilon_i|X) = 0 E(ϵi∣X)=0并不会带来过多限制,因为如果 E ( ϵ i ∣ X ) = c ≠ 0 E(\epsilon_i|X) = c \not=0 E(ϵi∣X)=c=0, 总可以把扰动项的非零期望 c c c归入常数项中,即只要定义新的扰动项为 ( ϵ i − c ) (\epsilon_i - c) (ϵi−c)就可以满足严格外生性.

- 假设3 不存在“严格多重共线性" (strict multicolinearity) , 即数据矩阵 X X X满列秩, r a n k ( X ) = K rank(X)= K rank(X)=K

如果不满足此条件,则 β \beta β" 不可识别" ( unidentified) , 因为 X X X中某个或多个变最为多余. 在后面将看到,根据OLS 估计, b = ( X ′ X ) − 1 X ′ y b = (X'X)^{-1}X'y b=(X′X)−1X′y. 如果X 满列秩,则对称矩阵 X ′ X X'X X′X为正定矩阵,故 ( X ′ X ) − 1 (X'X)^{-1} (X′X)−1存在;反之,则 ( X ′ X ) − 1 (X'X)^{-1} (X′X)−1不存在. 在实际数据中, 一般不容易出现严格多重共线性的问题,除非你设了过多的“虚拟变量",同时在回归方程中又包括常数项.

- 假设4 球型扰动项(spherica l disturbance) , 即扰动项满足”同方差”、“无自相关”的性质

OLS 的几何解释

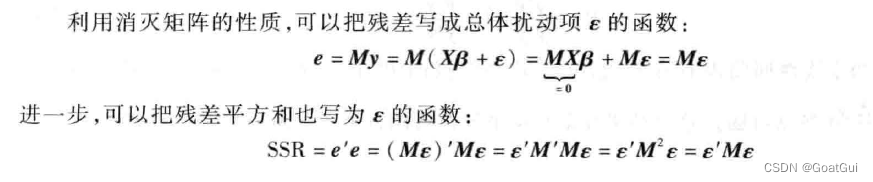

利用OLS 的正交性,可以给予OLS 估计量直观的几何解释, 参见图3. 2 . 其中, y ^ \hat{y} y^是 y y y向超平面 X X X的投影(projection) , 因为 ϵ \epsilon ϵ与 X X X正交. 由于 y ^ ≡ X b = X ( X ′ X ) − 1 X ′ y ≡ P y \hat{y} \equiv Xb=X(X'X)^{-1}X' y \equiv Py y^≡Xb=X(X′X)−1X′y≡Py, 故 X ( X ′ X ) − 1 X ′ X(X'X)^{-1}X' X(X′X)−1X′被称为“投影矩阵" (projection matrix),因为用 P P P左乘任何向量就可得到该向量在超平面 X X X上的投影. 另一方面, e = y − y ^ = y − P y = ( I n − P ) y ≡ M y e=y-\hat{y}=y-Py = (I_n - P)y \equiv My e=y−y^=y−Py=(In−P)y≡My, 其中 M ≡ I n − P M \equiv I_n -P M≡In−P被称为“消灭矩阵" (annihilator matrix) , 因为用消灭矩阵 M M M左乘任何向量, 则得到该向量对超平面 X X X 投影后的残差向量.

对于矩阵P 与M, 可以证明以下性质:

- P X = X PX= X PX=X ( 自己的投影还是自己)

- P e = 0 Pe = 0 Pe=0 (垂直于X 的向量 e e e投影于 X X X则退化为一个点)

- M X = 0 MX = 0 MX=0 (自己对自己投影,其残差为0 )

- P P P与 M M M 都是对称阵

- P 2 = P P^2 = P P2=P (再次投影的效果等于一次投影)

- M 2 = M M^2 = M M2=M(再次消灭的效果等于一次消灭)

OLS 的小样本性质

- 线性性: OLS 估计量 b = ( X ′ X ) − 1 X ′ y b = (X'X)^{-1}X'y b=(X′X)−1X′y为 y y y的线性组合.

- 无偏性: E ( b ∣ X ) = β E(b|X)=\beta E(b∣X)=β, 即 b b b不会系统地高估或低估 β \beta β.

- 估计量 b b b的方差为 V a r ( b ∣ X ) = σ 2 ( X ′ X ) − 1 Var(b|X) = \sigma^2 (X'X)^{-1} Var(b∣X)=σ2(X′X)−1.

- "高斯-马尔可夫定理’'(Gauss-Markov Theorem) : 最小二乘法是最佳线性无偏估计(Best Linear Unbiased Estimator, 简记BLUE ), 即在所有线性无偏估计中,最小二乘法的方差最小.

- 方差的无偏估计: E ( s 2 ∣ X ) = σ 2 E(s^2|X)=\sigma^2 E(s2∣X)=σ2.

拟合优度

- 拟合优度

拟合优度 R 2 R^2 R2为:

拟合优度 R 2 R^2 R2也称为“可决系数". 可以证明,在有常数项的情况下,拟合优度就等于被解释变最 y i y_i yi, 与拟合值 y ^ i \hat{y}_i y^i之间相关系数的平方,即 R 2 = [ C o r r ( y i , y ^ i ) ] 2 R^2 = [Corr(y_i, \hat{y}_i)]^2 R2=[Corr(yi,y^i)]2. 显然, R 2 R^2 R2越高,则说明拟合程度越好. 如果向回归方程中增加解释变最,则 R 2 R^2 R2必然只增不减,因为至少可以让新增解释变量的系数为0. 从而保持 R 2 R^2 R2不变. 为此,可以通过调整自由度对解释变掀过多(模型不够简洁)进行惩罚.- 校正拟合优度

校正拟合优度 R 2 ‾ \overline{R^2} R2为:

R 2 ‾ \overline{R^2} R2的一个缺点是它可能为负数. 无论 R 2 R^2 R2还是 R 2 ‾ \overline{R^2} R2, 只是反映了拟合程度的好坏(即观测值距离回归超平面的远近),除此以外没有太多意义. 我们并不知道它们的统计分布. 评估一个回归方程是否显著,更多地应该看 F F F检验(尽管 R 2 R^2 R2与 F F F统计据也有联系).预测

有时,建立计量模型的目的并不仅仅是参数估计与假设检验. 在某些情形下(特别对于时间序列数据而言) ,还常常进行预测(prediction or forecasting) , 即给定解释向量 x 0 x_0 x0的(未来)取值,预测被解释变量 y 0 y_0 y0的取值.

假设以上计量模型对所有观测值都成立(包括外推到未来的观测值),则:

y 0 = x 0 ′ β + ϵ 0 y_0 = x_0' \beta + \epsilon_0 y0=x0′β+ϵ0显然,我们可以用 y 0 ^ ≡ x 0 ′ b \hat{y_0} \equiv x_0' b y0^≡x0′b来对 y 0 y_0 y0作点预测,其中 b b b是 β \beta β的最小二乘估计量. “预测误差”(prediction error) ( y 0 ^ − y 0 ) (\hat{y_0}-y_0) (y0^−y0)可以写为:

y ^ 0 − y 0 = x 0 ′ b − ( x 0 ′ β + ϵ 0 ) = x 0 ′ ( b − β ) − ϵ 0 \hat{y}_0 -y_0 = x_0'b - (x_0' \beta + \epsilon_0) = x_0'(b - \beta) - \epsilon_0 y^0−y0=x0′b−(x0′β+ϵ0)=x0′(b−β)−ϵ0

-

相关阅读:

ES6模块

linux升级python3

如何在linux上直接运行python程序

antdpro使用AbortController取消请求

在VMcentos7上用docker部署SELKS(IDS系统)

CSS3盒子模型

mybatis-plus下_databaseId的使用

04【保姆级】-GO语言指针

第十九节——vue内置组件

c#检查两个时间段是否重叠

- 原文地址:https://blog.csdn.net/m0_37422217/article/details/126473987