-

神经网络(二)回归与线性模型

一、线性回归

需要通过训练集

和

和 求解x,y之间的映射关系

求解x,y之间的映射关系

1.线性回归

①模型

增广权重向量&增广特征向量:在x和

上添加一个b,可将模型中原有的b消除。

上添加一个b,可将模型中原有的b消除。

模型转换为:

②训练集D上的经验风险

X矩阵:其中每行为一个样本

Y向量:列向量,每一列为一个结果

③经验风险最小化

以此公式求解w

以此公式求解w推导:

条件:

条件: 必须存在

必须存在若

不存在(特征之间存在共线性),可以采用以下两种方法求解

不存在(特征之间存在共线性),可以采用以下两种方法求解①SGD(随机数下降) ②降维

结构风险:

,其中

,其中 被称为正则化项,

被称为正则化项, 为正则化参数。

为正则化参数。使其最小化:

!!!Attention矩阵微积分

2.多项式回归

①模型

多项式曲线拟合

多项式曲线拟合②损失函数

③经验风险最小化

求解过程与线性回归类似

④选择合适的多项式次数

控制过拟合:正则化

惩罚大的系数:

其中

为正则化项,

为正则化项, 为正则化系数

为正则化系数控制过拟合:增加训练样本数量

3.从概率视角来看线性回归

①似然函数

参数w固定时,描述随机变量x的分布情况,称p(x;w)为概率

已知随机变量x时,不同参数w对其分布的影响,称p(x;w)为似然

线性回归中的似然函数:

②最大似然估计

求一组参数w,使

取最大值(求导)

取最大值(求导)

③贝叶斯学习

将参数w也视为随机变量;给定一组数据X,求参数w的分布p(w|X),也称后验分布

贝叶斯公式:

先验:

后验 正比于 似然 X 先验

后验 正比于 似然 X 先验

最大后验估计:

正则化系数

正则化系数

⑤四种准则

平方误差 经验风险最小化

结构风险最小化

概率 最大似然估计 (XX^T)^{-1}Xy 最大后验估计

4.模型选择

模型越复杂,训练错误越低;

但不能以训练错误高低来选择模型;

选择模型时,测试集不可见。

①引入验证集

可将训练集分为两部分训练集和验证集,在验证集上挑选一个错误最小的模型。

解决数据稀疏问题(样本过少):交叉验证,将训练集分为S组,每次使用S-1组作为训练集,剩下一组作验证集;取验证集平均性能最好的一组。

②使用准则

赤池信息量准则、贝叶斯信息准则

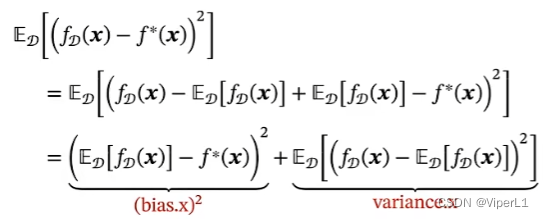

③偏差-方差分解

平衡模型复杂度和期望风险

期望风险:

![R(f)=E_{(x,y)~p_r(x,y)}[(y-f(x))^2]=E_{x~p(x)}[E_{y~p(y|x)}[(y-f(x))^2]]](https://1000bd.com/contentImg/2022/08/18/060428216.gif)

最优模型:

![f^*(x)=E_{y~p_r(y|x)}[y]](https://1000bd.com/contentImg/2022/08/18/060429092.gif)

期望风险可以分解为:

![R(f)=E_{(x,y)~p_y(x,y)}[(y-f*(x)-f(x))^2]](https://1000bd.com/contentImg/2022/08/18/060430149.gif)

![=E_{x~p_r(x)}[(f(x)-f^*(x))^2]+\varepsilon](https://1000bd.com/contentImg/2022/08/18/060430955.gif)

![\varepsilon =E_{(x,y~p_r(x,y))}[(y-f^*(x))^2]](https://1000bd.com/contentImg/2022/08/18/060431834.gif) 通常由样本分布及噪声引起,无法通过优化模型消除。

通常由样本分布及噪声引起,无法通过优化模型消除。目的:模型

与最优模型

与最优模型 尽可能贴近

尽可能贴近

由偏差与方差进行模型选择

随着模型复杂度↑,方差↑,偏差↓

5.常用定理

①没有免费午餐定理

不存在某种算法对所有问题都有效

②丑小鸭定理

丑小鸭与白天鹅之间的区别和两只白天鹅之间的区别一样大(未给定具体条件的情况下)

③奥卡姆剃刀定理

若无必要,勿增实体

④归纳偏置

做出的假设称为归纳偏置,在贝叶斯学习中称为先验

⑤PAC学习

由大数定律,训练集趋于无穷大时,泛化误差趋近于0

-

相关阅读:

Gzip压缩

Go语言笔记-基础篇

以报时机器人为例详细介绍tracker_store和event_broker

Numpy学习笔记

【C++】类型转换(dynamic_cast,const_cast,static_cast,reinterpret_cast)

实验四、零比特插入《计算机网络》

基础课24——开放域QA问答

为什么ArcGIS添加的TIFF栅格数据是一片纯色

【SpringBoot实战】数据访问整合Mybatis和Redis

linux上部署python环境

- 原文地址:https://blog.csdn.net/weixin_37878740/article/details/126358514