-

Webrtc音频技术(未完)

一、概述

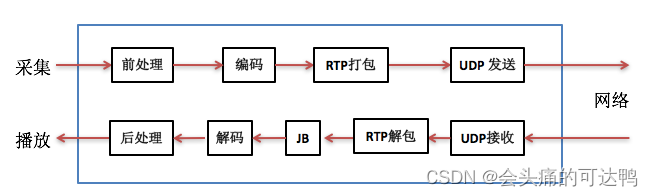

1、架构

上图中发送方(或叫上行、TX)将从MIC采集到的语音数据先做前处理,然后编码得到码流,再用RTP打包通过UDP socket发送到网络中给对方。接收方(或叫下行、RX)通过UDP socket收语音包,解析RTP包后放入jitter buffer中,要播放时每隔一定时间从jitter buffer中取出包并解码得到PCM数据,做后处理后送给播放器播放出来。

二、NetEQ

1、简介

netEQ是webRTC中音频技术方面的两大核心技术之一,webRTC是Google收购GIPS重新包装后开源出来的,netEQ有两大模块,MCU(micro control unit, 微控制单元)和DSP(digital signal processing, 信号处理单元,

netEQ有两大核心技术点,一、解决时延、抖动,二、信号处理(加速(accelerate)、减速(preemptive expand)、丢包补偿(PLC)、融合(merge)和背景噪声生成(BNG))

MCU负责控制从网络收到的语音包在jitter buffer里的插入和提取,同时控制DSP模块用哪种算法处理解码后的PCM数据,

-

相关阅读:

web前端期末大作业 基于HTML+CSS+JavaScript绿色的在线教育平台网站响应式企业网站模板

ClickHouse相关SQL总结:创建表、分区主键排序设置、删除表、删除分区、修改表字段

期权怎样的加仓才是合理的加仓?

全网最全的知识库管理工具综合评测和推荐:FlowUs、Baklib、简道云

Transformer(一)—— Attention & Batch Normalization

c++中利用指针或应用如何安全的获取数据

转行网络安全是否可行?

制药企业固体制剂设备管理及维护要点

BIM设计 | 学会CAD这5个隐藏操作,让你受益无穷

wm命令详解

- 原文地址:https://blog.csdn.net/qq_15821883/article/details/126016688