-

【推理框架】MNN框架 C++、Python、Java使用例子 Demo

背景

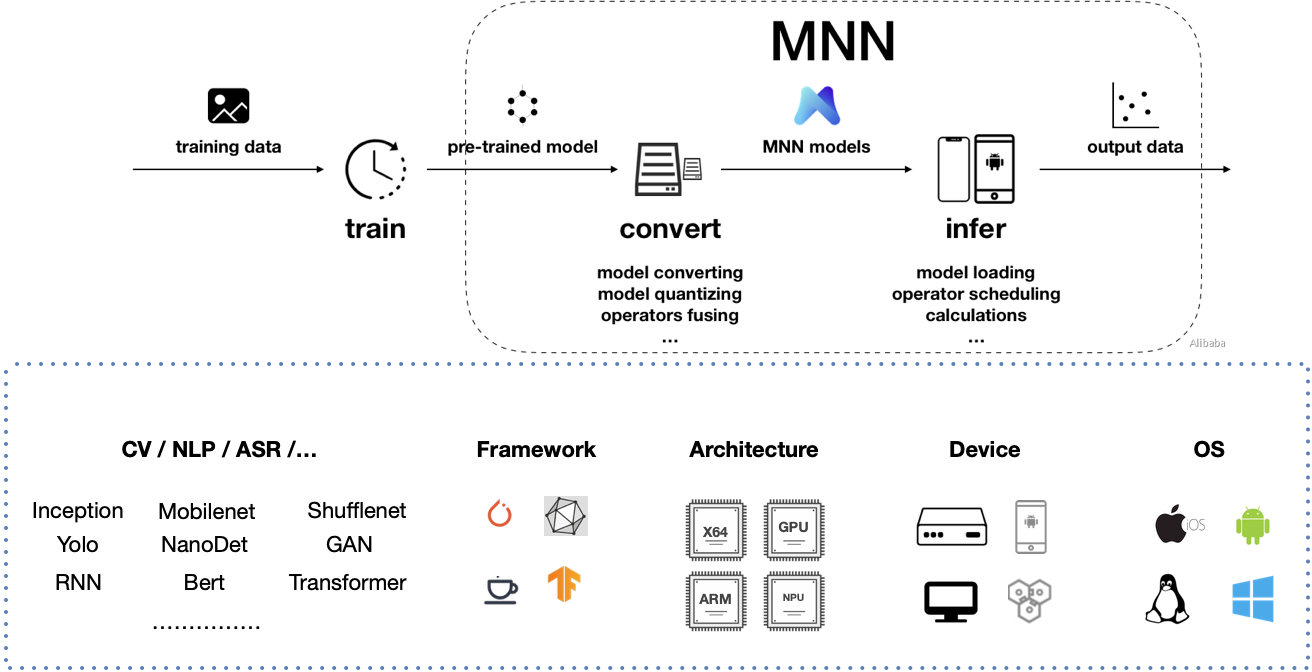

背景:手机端需要调用深度学习模型的计算。

方案:python训练模型–>转到MNN框架模型–>放入C++调用(SDK)–>Java调用SDK(JNI).系统环境

CentOS Linux release 7.9.2009 (Core)

Linux iZuf627r0ggzf84xn57fuvZ 3.10.0-1160.62.1.el7.x86_64

Tesla V100 32G CUDA11

Miniconda3推荐Linux系统,不推荐Windows系统。

安装:

sudo yum install cmake3 protobuf -y- 1

注意: CMake 3.0 or higher is required, 所以:

sudo ln -s /usr/bin/cmake3 /usr/bin/cmake- 1

MNN介绍

直接查看文档:https://github.com/alibaba/MNN/blob/master/README_CN.md

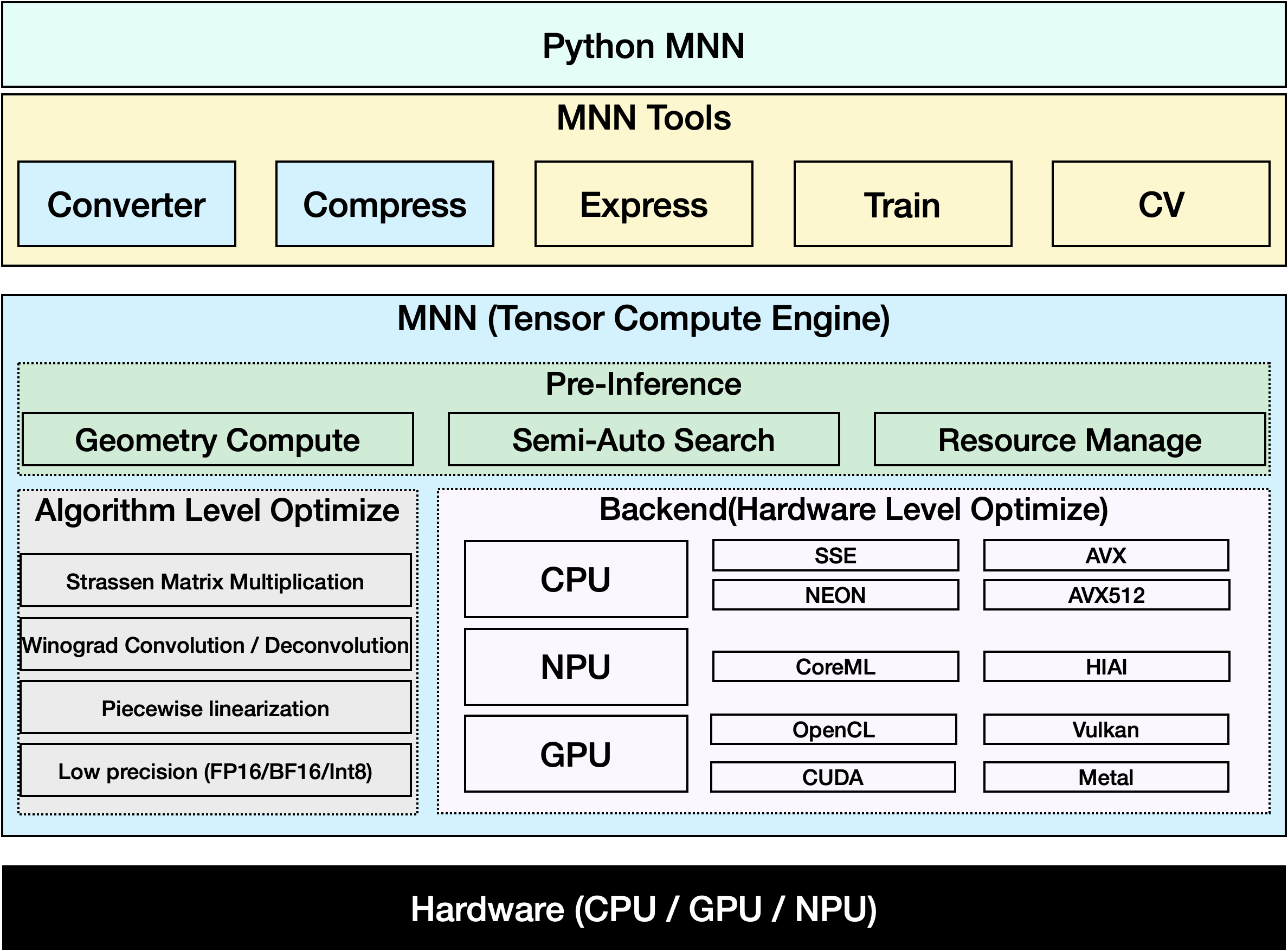

工具

MNN-Converter:模型转换工具,由Frontends和Graph Optimize构成。前者负责支持不同的训练框架,MNN当前支持Tensorflow(Lite)、Caffe、ONNX(PyTorch/MXNet的模型可先转为ONNX模型再转到MNN)和Torchscripts;后者通过算子融合、算子替代、布局调整等方式优化图,一般离线运行。

MNN-Compress: 模型压缩工具,在一定的精度误差许可下,对MNN模型进行压缩,减少模型体积,提升运行性能。

MNN-Express :支持带控制流的模型运行,支持调用 MNN 的算子进行自定义的计算。

MNN-CV :类似 OpenCV ,但核心计算功能基于 MNN 实现的图像处理算法库

MNN-Train :MNN 训练模块,支持各平台训练MNN环境

参考:https://www.yuque.com/mnn/cn/demo_projectprotobuf

下载MNN工程:

git clone https://github.com/alibaba/MNN.git- 1

编译:

cd path/to/MNN # 生成 schema ,可选 cd schema && ./generate.sh # 进行编译 cd path/to/MNN # 注意回到根目录 mkdir build && cd build cmake -DMNN_BUILD_DEMO=ON .. make -j8- 1

- 2

- 3

- 4

- 5

- 6

- 7

- 8

- 9

参考文章

https://blog.csdn.net/wl1710582732/article/details/107731147

-

相关阅读:

【SpringBoot从入门到精通】第三章 Springboot启动器、容器、常用注解解析

Redis 19 事务

【yolo系列:YOLOV7改进-添加EIOU,SIOU,AlphaIOU,FocalEIOU.】

微信小程序怎么隐藏顶部导航栏(navigationBar)变透明的解决方案

redis 分布式锁

异地远程访问本地SQL Server数据库【无公网IP内网穿透】

第十七章 条件随机场

[Python从零到壹] 七十一.图像识别及经典案例篇之图像特效(滤镜和均衡化特效)

Automation Anywhere推出新的生成式AI自动化平台,加速提高企业生产力

【论文阅读】基于强化学习框架的A/B测试中的动态因果效应评估

- 原文地址:https://blog.csdn.net/x1131230123/article/details/125536750