-

寻找更好的分类模型loss

1.CE loss并不完美

最常用于深度学习分类模型的损失函数可以说就是CE(交叉熵) loss了。正如CC-LOSS paper中所述,该loss更关注各类是否separated,而非不同类之间距离远/相同类聚类更近这样的模式识别分类基本要求。这样可能导致过拟合或者泛化能力弱等缺点。

CE-Loss has two main issues that limit the performance of a CNN model for classification.

- Firstly, the high level features extracted by CNNs with the CE-Loss are only separable with each other but not discriminative enough, which can easily lead to over-fitting of the model and thus weak generalization performance.

- Secondly, the parameters of the deep CNN model are trained jointly with all the classes, which makes the high level features extracted by CNNs to be confused with each other and increases the difficulty of optimization.

2.可能更好的loss函数

2.1 CC-LOSS

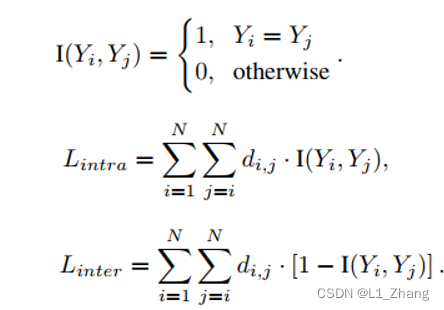

其损失函数为交叉熵损失,再额外加上一部分,即类内距离之和/类间距离之和:

其在MNIST数据集上表现如下,感觉不够惊喜,与CE-LOSS相差不大,并没有达到所提出的类内compact,类间dispense这样的程度。

2.2 Center-LOSS

paper 见A Discriminative Feature Learning Approachfor Deep Face Recognition。整体来说它的策略也很简单,即除了CE,再额外一部分损失,该损失是为了使得某一层学习到的特征及学习到center之间距离尽可能接近。

它的pytorch实现可参考https://github.com/KaiyangZhou/pytorch-center-loss,git中也展示了mnist数据集上,使用center-loss前后的效果。参考文献

[1] CC-LOSS: CHANNEL CORRELATION LOSS FOR IMAGE CLASSIFICATION

[2] Wen et al. A Discriminative Feature Learning Approach for Deep Face Recognition. ECCV 2016

[3] https://github.com/KaiyangZhou/pytorch-center-loss -

相关阅读:

【用户画像】ClickHouse简介、特点、安装和部署

基于场景分析法的电动车优化调度(Matlab代码实现)

GRU门控循环单元

Java学习笔记4.2.1 系统类 - System类

JVM诊断及工具笔记(4) 使用visualvm分析JVM堆内存泄漏

Total derivative

Docker笔记-10 Swarm mode

【os-tutorial】四,电脑存储的组织形式

机器学习深度学习服务器推荐

凌恩客户文献|《ISME》解析土壤侵蚀对微生物群落结构以及网络功能复杂性影响

- 原文地址:https://blog.csdn.net/WANGWUSHAN/article/details/127970143